A equipe Meta FAIR lançou um novo modelo Transformer, Dualformer, que simula sistemas cognitivos duais humanos (Sistema 1 e Sistema 2) e alcança melhorias significativas nas capacidades de raciocínio e eficiência computacional. Ao contrário dos modelos tradicionais de Transformer que simulam apenas o Sistema 1 ou Sistema 2, o Dualformer pode alternar com flexibilidade entre os modos de raciocínio rápido e lento para se adaptar à complexidade de diferentes tarefas. Esta inovação decorre do seu método de treino único – utilizando trajetórias de raciocínio aleatório para treino e descartando aleatoriamente diferentes partes das trajetórias para simular atalhos no processo de pensamento humano.

A equipe FAIR da Meta lançou recentemente um novo modelo de Transformer chamado Dualformer, que imita o sistema cognitivo duplo humano e pode integrar perfeitamente os modos de raciocínio rápido e lento, alcançando avanços significativos nas capacidades de raciocínio e eficiência computacional.

Geralmente, acredita-se que os processos de pensamento humano sejam controlados por dois sistemas: o Sistema 1, que é rápido e intuitivo, e o Sistema 2, que é mais lento e mais lógico.

Os modelos tradicionais de Transformer geralmente simulam apenas um do Sistema 1 ou Sistema 2, resultando em um modelo que é rápido, mas tem capacidades de raciocínio fracas, ou tem capacidades de raciocínio fortes, mas é lento e tem altos custos computacionais.

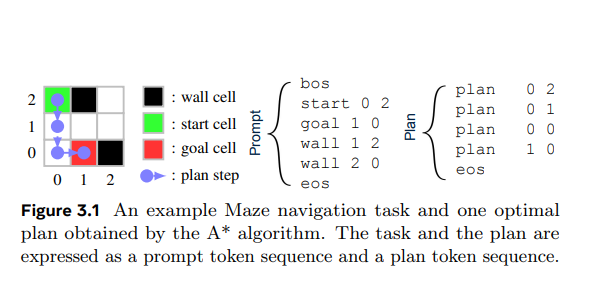

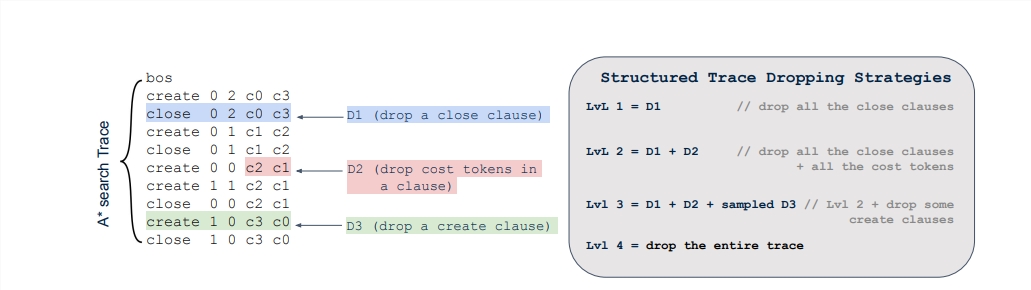

O que há de inovador no Dualformer é a forma como ele é treinado. Os pesquisadores treinaram o modelo usando trajetórias de inferência aleatória, descartando aleatoriamente diferentes partes das trajetórias durante o treinamento, semelhante à análise dos processos de pensamento humano e à criação de atalhos. Esta estratégia de treinamento permite que o Dualformer alterne com flexibilidade entre diferentes modos durante a inferência:

Modo rápido: Dualformer produz apenas a solução final, que é extremamente rápida.

Modo lento: Dualformer produzirá uma cadeia de raciocínio completa e uma solução final, com capacidades de raciocínio mais fortes.

Modo automático: Dualformer pode selecionar automaticamente o modo apropriado com base na complexidade da tarefa.

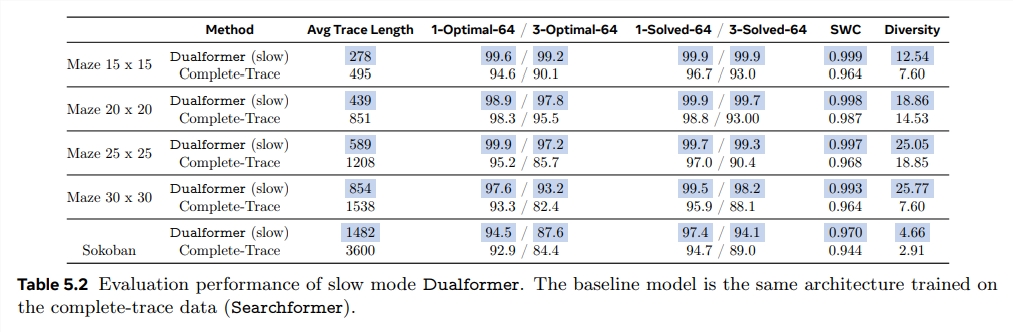

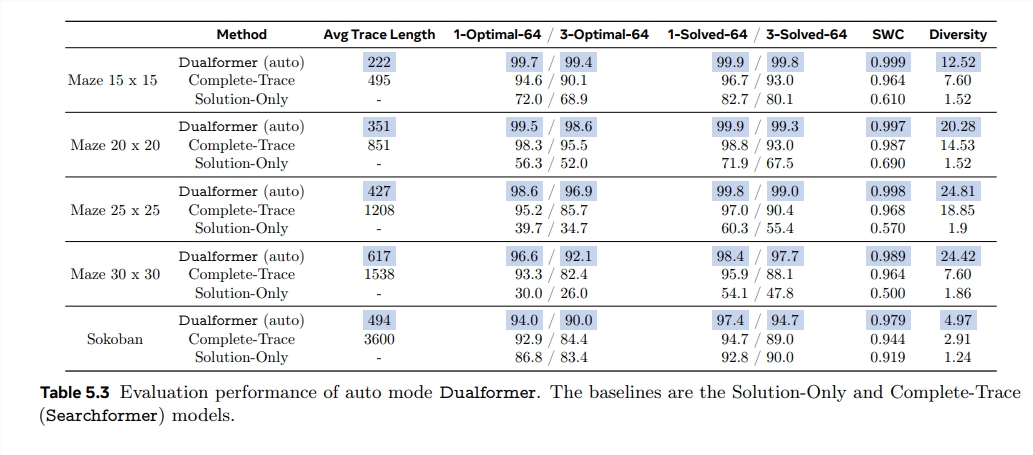

Resultados experimentais mostram que o Dualformer tem um bom desempenho em tarefas como navegação em labirintos e resolução de problemas matemáticos. No modo lento, o Dualformer pode resolver a tarefa de navegação em labirinto 30x30 com uma taxa de sucesso de 97,6%, superando o modelo Searchformer treinado usando apenas trajetórias de inferência completas, enquanto reduz as etapas de inferência em 45,5%.

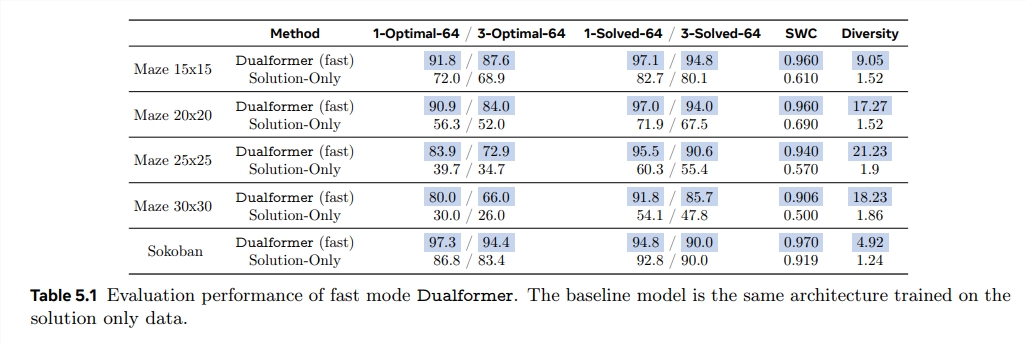

No modo rápido, a taxa de sucesso do Dualformer também chega a 80%, o que é muito maior do que o modelo Solution-Only treinado usando apenas a solução final. No modo automático, o Dualformer pode reduzir significativamente as etapas de inferência, mantendo uma alta taxa de sucesso.

O sucesso do Dualformer mostra que a aplicação da teoria cognitiva humana ao design de modelos de inteligência artificial pode efetivamente melhorar o desempenho do modelo. Este modelo de integração do pensamento rápido e lento fornece novas ideias para a construção de sistemas de IA mais poderosos e eficientes.

Endereço do artigo: https://arxiv.org/pdf/2410.09918

O editor do Downcodes concluiu: O surgimento do Dualformer marca um grande avanço no design de modelos de inteligência artificial mais próximos dos padrões de pensamento humano. Seus avanços na eficiência e precisão do raciocínio fornecem novas direções e desenvolvimento futuro da tecnologia de IA.