Hoje, com o rápido desenvolvimento da tecnologia de IA, a tecnologia de geração de vídeo também fez progressos significativos. O editor de Downcodes apresentará o Snap Video, um modelo inovador que pode gerar automaticamente vídeos de alta qualidade por meio de descrições de texto. Ele rompe o gargalo da tecnologia tradicional de geração de vídeo e proporciona uma experiência de criação de vídeo mais eficiente, realista e escalável. O Snap Video não apenas traz avanços tecnológicos, mas também otimiza a experiência do usuário, trazendo aos usuários uma conveniência sem precedentes na criação de vídeos.

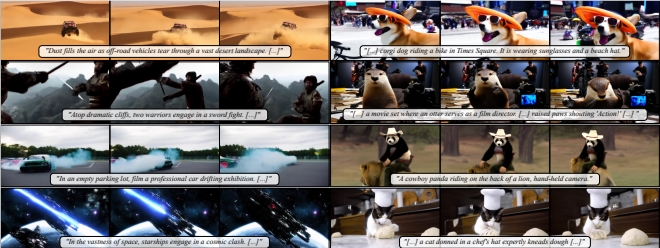

Na era da mídia digital, o vídeo se tornou a principal forma de nos expressarmos e compartilharmos nossas histórias. Mas a criação de vídeos de alta qualidade muitas vezes requer habilidades especializadas e equipamentos caros. Agora, com o Snap Video, você só precisa descrever a cena desejada com texto, e o vídeo será gerado automaticamente.

Os modelos atuais de geração de imagens demonstraram qualidade e diversidade notáveis. Inspirados por isso, os pesquisadores começaram a aplicar esses modelos à geração de vídeos. Porém, a alta redundância do conteúdo de vídeo torna a aplicação direta de modelos de imagem ao campo de geração de vídeo, o que reduzirá a autenticidade, a qualidade visual e a escalabilidade das ações.

Snap Video é um modelo centrado em vídeo que aborda sistematicamente esses desafios. Primeiro, estende a estrutura EDM para considerar pixels redundantes no espaço e no tempo, suportando naturalmente a geração de vídeo. Em segundo lugar, propõe uma nova arquitetura baseada em transformador que é 3,31 vezes mais rápida em treinamento e 4,5 vezes mais rápida em inferência do que a U-Net. Isso permite que o Snap Video treine com eficiência modelos de texto para vídeo com bilhões de parâmetros, alcance resultados de última geração pela primeira vez e gere vídeos com maior qualidade, consistência temporal e complexidade de movimento significativa.

Destaques técnicos:

Modelagem espaço-temporal conjunta: o Snap Video é capaz de sintetizar vídeos coerentes com movimento em grande escala, mantendo o controle semântico de geradores de texto para vídeo em grande escala.

Geração de vídeo de alta resolução: Um modelo em cascata de dois estágios é usado para primeiro gerar vídeo de baixa resolução e, em seguida, realizar upsampling de alta resolução para evitar possíveis problemas de inconsistência temporal.

Arquitetura baseada em FIT: Snap Video utiliza a arquitetura FIT (Far-reaching Interleaved Transformers) para obter modelagem conjunta eficiente de computação espaço-temporal, aprendendo representações de vídeo compactadas.

O Snap Video é avaliado em conjuntos de dados amplamente adotados, como UCF101 e MSR-VTT, mostrando vantagens específicas na geração de qualidade de ação. Estudos de usuários também mostram que o Snap Video supera os métodos de última geração em termos de alinhamento de texto de vídeo, número de ações e qualidade.

O artigo também discute outros esforços de pesquisa na área de geração de vídeo, incluindo métodos baseados em treinamento adversário ou técnicas de geração autoregressiva, e avanços recentes no emprego de modelos de difusão em tarefas de geração de texto para vídeo.

O Snap Video resolve sistematicamente problemas comuns de processos de difusão e arquiteturas na geração de texto para vídeo, tratando os vídeos como cidadãos de primeira classe. Sua proposta de estrutura de difusão EDM modificada e arquitetura baseada em FIT melhoram significativamente a qualidade e escalabilidade da geração de vídeo.

Endereço do artigo: https://arxiv.org/pdf/2402.14797

Resumindo, o Snap Video alcançou conquistas notáveis no campo da geração de texto para vídeo, e sua arquitetura eficiente e excelente desempenho oferecem novas possibilidades para a criação futura de vídeos. O editor do Downcodes acredita que esta tecnologia terá um impacto profundo no campo da criação de vídeo.