O editor de Downcodes irá ajudá-lo a interpretar o relatório de pesquisa global divulgado pela Checkmarx, que revela o estado atual do uso generalizado de ferramentas de programação de IA na área de desenvolvimento de software e os riscos de segurança que isso traz. Os dados do relatório mostram que, embora algumas empresas tenham proibido explicitamente a utilização de ferramentas de programação de IA, as suas taxas de adoção permanecem elevadas, destacando os desafios que as empresas enfrentam na gestão da IA generativa. O relatório também fornece uma discussão aprofundada sobre a governança das ferramentas de IA das empresas, a avaliação de riscos de segurança e a confiança dos desenvolvedores nas ferramentas de IA, fornecendo uma referência importante para as empresas utilizarem efetivamente as ferramentas de IA.

De acordo com um estudo global divulgado pela empresa de segurança em nuvem Checkmarx, embora 15% das empresas proíbam explicitamente o uso de ferramentas de programação de IA, quase todas as equipes de desenvolvimento (99%) ainda utilizam essas ferramentas. Este fenómeno reflecte a dificuldade de controlar a utilização de IA generativa no próprio processo de desenvolvimento.

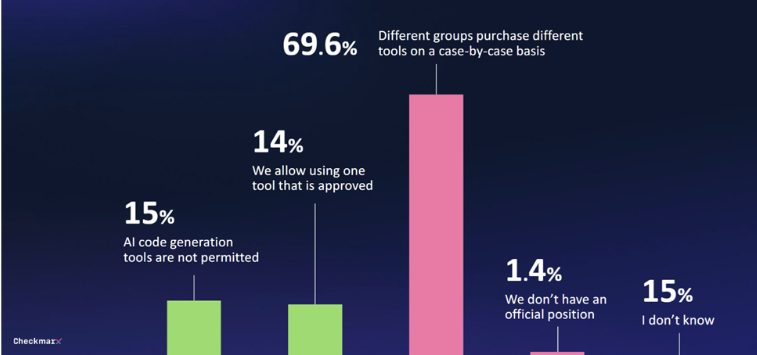

O estudo concluiu que apenas 29% das empresas estabeleceram qualquer forma de sistema de governação para ferramentas generativas de IA. 70% das empresas não têm uma estratégia central e as decisões de aquisição de vários departamentos são muitas vezes temporárias e carecem de gestão unificada.

À medida que mais e mais desenvolvedores usam ferramentas de programação de IA, as questões de segurança tornam-se uma preocupação crescente. 80% dos entrevistados estão preocupados com as ameaças potenciais que os desenvolvedores podem trazer ao usar a IA, e 60% deles estão particularmente preocupados com possíveis “alucinações” causadas pela IA.

Apesar destas preocupações, muitas pessoas continuam interessadas no potencial da IA. 47% dos entrevistados estão dispostos a permitir que a IA faça alterações no código sem supervisão, enquanto apenas 6% expressam total desconfiança nas medidas de segurança da IA em ambientes de software.

Kobi Tzruya, diretor de produtos da Checkmarx, observou: “As respostas dos CISOs de todo o mundo revelam que os desenvolvedores estão usando IA para o desenvolvimento de aplicativos, embora essas ferramentas de IA não possam criar códigos seguros de maneira confiável, o que significa que as equipes de segurança estão lidando com um grande número de código novo e potencialmente malicioso."

O relatório Work Trend Index da Microsoft também mostra que muitos funcionários utilizam as suas próprias ferramentas de IA sem as fornecer, e muitas vezes não discutem isso abertamente, o que dificulta a implementação sistemática de IA generativa nos processos de negócios.

Destaque:

1. ? **15% das empresas proíbem ferramentas de programação de IA, mas 99% das equipes de desenvolvimento ainda as utilizam**

2. **Apenas 29% das empresas estabeleceram um sistema de governança para ferramentas generativas de IA**

3. ? **47% dos entrevistados estão dispostos a permitir que a IA faça alterações de código não supervisionadas**

Em suma, o relatório destaca a necessidade de as empresas reforçarem as políticas de gestão e segurança das ferramentas de programação de IA e equilibrarem a conveniência trazida pela IA com os riscos potenciais. As empresas devem formular uma estratégia unificada e prestar atenção às vulnerabilidades de segurança que a IA pode trazer, para que possam utilizar melhor a tecnologia de IA para melhorar a eficiência do desenvolvimento. O editor do Downcodes recomenda prestar atenção aos relatórios de acompanhamento da Checkmarx para saber mais sobre os desenvolvimentos no campo da segurança de IA.