Com o rápido desenvolvimento da inteligência artificial, a tecnologia leve e eficiente de compreensão da interface do usuário tornou-se a chave para aplicações de IA. Em um artigo de pesquisa divulgado recentemente, a Apple apresentou uma nova arquitetura chamada UI-JEPA, que visa resolver o problema de compreensão eficiente da UI em dispositivos leves. Esta tecnologia não só mantém o alto desempenho, mas também reduz significativamente os requisitos de computação, proporcionando novas possibilidades para executar aplicações de IA em dispositivos com recursos limitados. Espera-se que o surgimento da UI-JEPA promova a ampla popularização de aplicações de IA mais convenientes e privadas.

À medida que a tecnologia de inteligência artificial continua a avançar, a compreensão da interface do usuário (IU) tornou-se um desafio importante na criação de aplicações de IA intuitivas e úteis. Recentemente, os pesquisadores da Apple introduziram o UI-JEPA em um novo artigo, uma arquitetura projetada para obter uma compreensão leve da UI no lado do dispositivo que não apenas mantém o alto desempenho, mas também reduz significativamente o custo dos requisitos de cálculo da UI.

O desafio da compreensão da UI reside na necessidade de processar recursos intermodais, incluindo imagens e linguagem natural, para capturar relações temporais em sequências de UI. Embora os modelos multimodais de linguagem grande (MLLM), como Anthropic Claude3.5Sonnet e OpenAI GPT-4Turbo, tenham feito progressos no planejamento personalizado, esses modelos exigem recursos de computação extensos, modelos de tamanhos enormes e apresentam alta latência. latência e privacidade aprimorada.

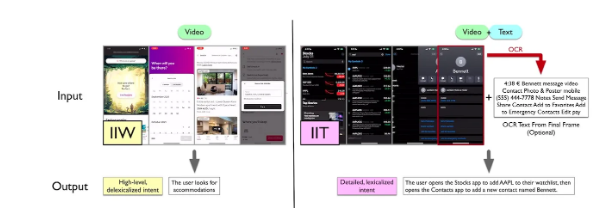

Fonte de imagem de exemplo de conjunto de dados IIT e IIW da UI-JEPA: arXiv

Para avançar ainda mais na pesquisa sobre a compreensão da IU, os pesquisadores apresentam dois novos conjuntos de dados e benchmarks multimodais: "Intentions in the Wild" (IIW) e "Intentions in the Tame" (IIT). IIW captura sequências de ação de UI abertas com intenção vaga do usuário, enquanto IIT se concentra em tarefas comuns com intenção mais clara.

A avaliação do desempenho do UI-JEPA em novos benchmarks mostra que ele supera outros modelos de codificadores de vídeo na configuração de poucas fotos e atinge desempenho comparável a modelos fechados maiores. Os pesquisadores descobriram que a mesclagem de texto extraído da UI usando reconhecimento óptico de caracteres (OCR) melhorou ainda mais o desempenho da UI-JEPA.

Os usos potenciais do modelo UI-JEPA incluem a criação de ciclos de feedback automatizados para agentes de IA, permitindo-lhes aprender continuamente com as interações sem intervenção humana e a integração do UI-JEPA em aplicativos projetados para rastrear a intenção do usuário em diferentes aplicativos e modos na estrutura da agência. .

O modelo UI-JEPA da Apple parece ser uma boa opção para o Apple Intelligence, um conjunto de ferramentas leves de IA generativa projetadas para tornar os dispositivos Apple mais inteligentes e eficientes. Dado o foco da Apple na privacidade, o baixo custo e a eficiência adicional do modelo UI-JEPA poderiam dar ao seu assistente de IA uma vantagem sobre outros assistentes que dependem de modelos de nuvem.

O surgimento da UI-JEPA trouxe novas possibilidades para aplicações leves de IA no lado do dispositivo. Suas vantagens em proteção de privacidade e computação eficiente proporcionam amplas perspectivas de aplicação no desenvolvimento futuro de IA e merecem atenção contínua.