O mais recente modelo grande multimodal de uso geral do Alibaba, mPLUG-Owl3, desencadeou uma tempestade no campo da inteligência artificial com seus poderosos recursos de compreensão multimodal e incrível eficiência de raciocínio. Ele pode compreender 2 horas de conteúdo de vídeo em 4 segundos e responder com precisão diversas dúvidas levantadas pelos usuários, demonstrando excelente desempenho na compreensão de imagens, vídeos e textos. Este avanço tecnológico não é apenas um marco na academia, mas também anuncia uma mudança futura na forma como a IA interage com os humanos.

Nesta era de explosão de informação, usamos fotos e vídeos para registrar nossas vidas e compartilhar nossa felicidade todos os dias. Mas você já pensou no que aconteceria se houvesse uma tecnologia que permitisse às máquinas não apenas entender essas fotos e vídeos como os humanos, mas também se comunicar conosco em profundidade?

O mais recente modelo grande multimodal de uso geral mPLUG-Owl3 lançado pela equipe do Alibaba, com sua incrível eficiência e capacidade de compreensão, nos permite assistir a um filme de 2 horas em 4 segundos. Este não é apenas um modelo, mas mais parecido! É um assistente de IA que pode ver, ouvir, falar e pensar.

mPLUG-Owl3, o nome soa como uma coruja de óculos, inteligente e alerta. Sua principal capacidade é a compreensão de longas sequências de imagens. Seja uma série de fotos ou um vídeo, ele consegue entender o conteúdo e até entender o enredo.

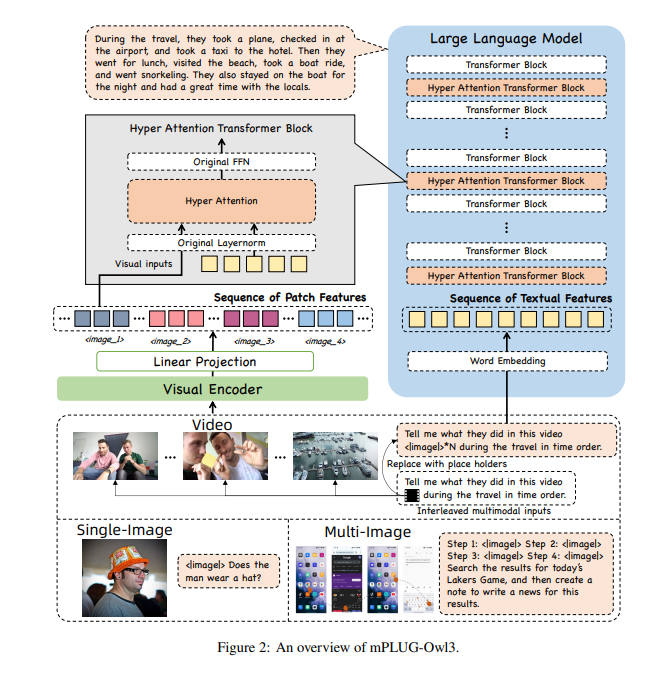

Para permitir que o mPLUG-Owl3 processasse tanta informação, os pesquisadores equiparam-no com um módulo de super-hiper-atenção cerebral. Este módulo é como um supercérebro para IA, capaz de processar informações visuais e de linguagem ao mesmo tempo, permitindo que a IA entenda imagens e informações de texto relacionadas.

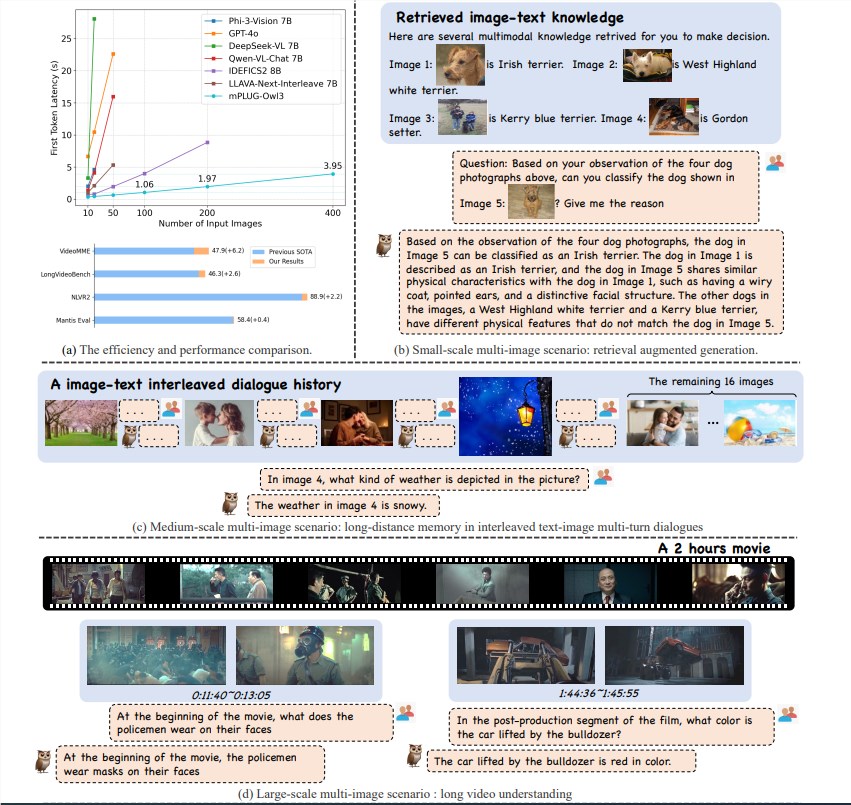

O modelo mPLUG-Owl3 fez um grande avanço no campo da compreensão multimodal com sua excelente eficiência de raciocínio. Ele não apenas atinge SOTA (State of the Art) em benchmarks multicenários, como imagem única, multiimagem, vídeo, etc., mas também reduz a latência do primeiro token em 6 vezes e o número de imagens que podem ser processadas por uma única placa gráfica A100 aumenta 8 vezes, chegando a 400 folhas.

mPLUG-Owl3 pode compreender com precisão o conhecimento multimodal recebido e usá-lo para responder perguntas. Pode até dizer em que conhecimento baseia o seu julgamento, bem como a base detalhada para o seu julgamento.

mPLUG-Owl3 pode compreender corretamente as relações de conteúdo em diferentes materiais e conduzir um raciocínio aprofundado. Quer se trate de diferenças estilísticas ou de reconhecimento de personagens, ele lida com tudo com facilidade.

mPLUG-Owl3 é capaz de assistir e compreender vídeos de até 2 horas de duração e pode começar a responder às perguntas dos usuários em 4 segundos, independentemente da parte do vídeo que a pergunta envolve.

mPLUG-Owl3 usa um módulo leve Hyper Attention para expandir o Transformer Block em um novo módulo capaz de interação de recursos gráficos e de texto e modelagem de texto. Este design reduz bastante o número de novos parâmetros adicionais introduzidos, tornando o modelo mais fácil de treinar, e a eficiência do treinamento e da inferência também é melhorada.

Experimentando uma ampla gama de conjuntos de dados, o mPLUG-Owl3 alcança resultados SOTA na maioria dos benchmarks multimodais de imagem única. Nas avaliações multiimagem, supera modelos especificamente otimizados para cenários multiimagem. No LongVideoBench superou os modelos existentes, mostrando sua excelente capacidade de compreensão de vídeos longos.

O lançamento do Alibaba mPLUG-Owl3 não é apenas um salto tecnológico, mas também oferece novas possibilidades para a aplicação de grandes modelos multimodais. À medida que a tecnologia continua a melhorar, esperamos que o mPLUG-Owl3 traga mais surpresas no futuro.

Endereço do artigo: https://arxiv.org/pdf/2408.04840

Código: https://github.com/X-PLUG/mPLUG-Owl/tree/main/mPLUG-Owl3

Experiência online: https://huggingface.co/spaces/mPLUG/mPLUG-Owl3

O surgimento do mPLUG-Owl3 marca uma nova etapa no desenvolvimento da tecnologia multimodal de grandes modelos. Suas capacidades de processamento eficientes e capacidades de compreensão precisa abrem amplas perspectivas para futuras aplicações de tecnologia de IA. Acredito que à medida que a tecnologia continua a amadurecer, o mPLUG-Owl3 trará mais comodidade e surpresas para a vida das pessoas. Ansioso por aplicações mais inovadoras baseadas em mPLUG-Owl3.