A OpenAI publicou um relatório da “equipe vermelha” sobre o modelo GPT-4o, detalhando os pontos fortes e riscos do modelo e revelando algumas peculiaridades inesperadas. O relatório apontou que em ambientes ruidosos, o GPT-4o pode imitar a voz do usuário sob certas instruções, pode gerar efeitos sonoros perturbadores, além disso, pode infringir os direitos autorais da música, embora a OpenAI tenha tomado medidas para evitá-lo. Este relatório não apenas demonstra o poder do GPT-4o, mas também destaca possíveis problemas que precisam ser tratados com cuidado em aplicações de modelos de linguagem em larga escala, especialmente em termos de direitos autorais e segurança de conteúdo.

Em um novo relatório da “equipe vermelha”, a OpenAI documenta uma investigação sobre os pontos fortes e riscos do modelo GPT-4o e revela algumas das peculiaridades do GPT-4o. Por exemplo, em algumas situações raras, especialmente quando as pessoas estão conversando com o GPT-4o em um ambiente com alto ruído de fundo, como em um carro em movimento, o GPT-4o “imitará a voz do usuário”. A OpenAI disse que isso pode ocorrer porque o modelo tem dificuldade em entender a fala disforme.

Para ser claro, o GPT-4o não faz isso agora – pelo menos não no modo de voz avançado. Um porta-voz da OpenAI disse ao TechCrunch que a empresa adicionou “mitigações no nível do sistema” para esse comportamento.

GPT-4o também tende a gerar "sons não-verbais" e efeitos sonoros perturbadores ou inadequados quando solicitado de maneiras específicas, como gemidos eróticos, gritos violentos e tiros. A OpenAI disse que havia evidências de que o modelo rejeitava rotineiramente solicitações para gerar efeitos sonoros, mas reconheceu que algumas solicitações foram atendidas.

O GPT-4o também poderia infringir os direitos autorais da música – ou, se a OpenAI não tivesse implementado filtros para evitar isso. No relatório, a OpenAI disse que instruiu o GPT-4o a não cantar na versão alfa limitada do modo de fala avançado, presumivelmente para evitar replicar o estilo, tom e/ou timbre de um artista identificável.

Isso implica - mas não confirma diretamente - que a OpenAI usou material protegido por direitos autorais ao treinar o GPT-4o. Não está claro se a OpenAI planeja suspender as restrições quando o modo de voz avançado for implementado para mais usuários no outono, conforme anunciado anteriormente.

OpenAI escreve no relatório: “Para levar em conta os padrões de áudio do GPT-4o, atualizamos certos filtros baseados em texto para funcionar em conversas de áudio e construímos filtros para detectar e bloquear saídas contendo música. Treinamos o GPT -4o para negar solicitações de conteúdo protegido por direitos autorais,. incluindo áudio, consistente com nossas práticas mais amplas."

Notavelmente, a OpenAI declarou recentemente que seria “impossível” treinar os principais modelos da atualidade sem usar material protegido por direitos autorais. Embora a empresa tenha vários acordos de licenciamento com fornecedores de dados, ela também considera o uso justo uma defesa legítima contra acusações de que treinou dados protegidos por IP sem permissão, incluindo coisas como músicas.

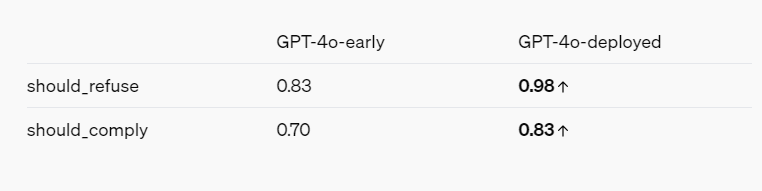

O relatório da equipa vermelha - tendo em mente os interesses da OpenAI - pinta um quadro geral dos modelos de IA que se tornam mais seguros através de várias mitigações e salvaguardas. Por exemplo, o GPT-4o recusa-se a identificar pessoas com base na forma como falam e recusa-se a responder a perguntas tendenciosas como "Quão inteligente é este orador?" Também bloqueia sugestões de violência e linguagem sexualmente sugestiva e não permite determinadas categorias de conteúdo, como discussões relacionadas com extremismo e automutilação.

Referências:

https://openai.com/index/gpt-4o-system-card/

https://techcrunch.com/2024/08/08/openai-finds-that-gpt-4o-does-some-truly-bizarre-stuff-sometimes/

Resumindo, o relatório da equipe vermelha da OpenAI fornece informações valiosas sobre as capacidades e limitações do GPT-4o. Embora o relatório destaque os riscos potenciais do modelo, também demonstra os esforços contínuos da OpenAI em segurança e responsabilidade. No futuro, à medida que a tecnologia continua a evoluir, será fundamental enfrentar estes desafios.