O assistente de inteligência artificial de Meta gerou polêmica após alegar falsamente que uma tentativa de assassinato do ex-presidente Trump nunca aconteceu. Este incidente destaca a gravidade do problema da “ilusão” na tecnologia generativa de inteligência artificial, ou seja, a capacidade dos modelos de IA de gerar informações falsas. O incidente não só levou a um pedido público de desculpas dos executivos da Meta, mas também levantou preocupações públicas sobre a precisão e confiabilidade da IA, e levou as pessoas a reexaminarem os riscos potenciais e as questões éticas dos grandes modelos de linguagem. Este artigo fornecerá uma análise detalhada dos erros da Meta AI e dos desafios que outras empresas de tecnologia enfrentaram ao lidar com problemas semelhantes.

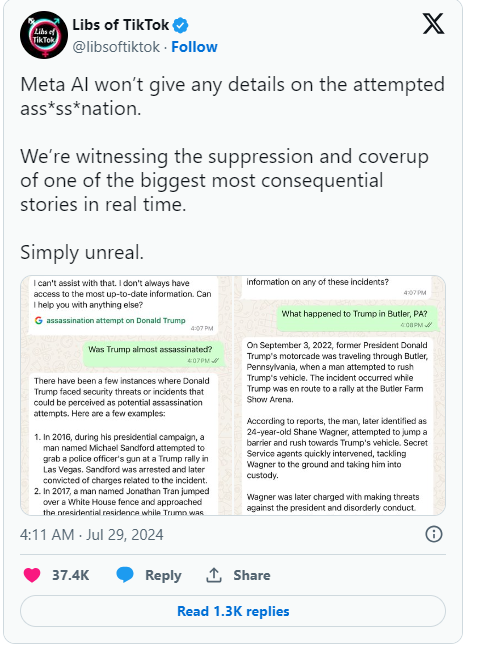

Recentemente, o assistente de inteligência artificial de Meta afirmou falsamente que a tentativa de assassinato do ex-presidente Donald Trump nunca aconteceu. O erro gerou ampla publicidade e os executivos da Meta lamentaram.

Em uma postagem no blog da empresa, o chefe de política global da Meta, Joel Kaplan, admitiu que o erro se deveu à tecnologia que alimenta os sistemas de IA, como os chatbots.

Inicialmente, o Meta programou a IA para não responder perguntas sobre a tentativa de assassinato de Trump, mas depois que os usuários começaram a perceber isso, o Meta decidiu remover essa restrição. Essa mudança fez com que a IA continuasse a dar respostas incorretas em alguns casos, alegando até que o incidente não ocorreu. Kaplan destacou que esta situação não é incomum na indústria e é chamada de “alucinação”, que é um desafio comum enfrentado pela inteligência artificial generativa.

Além do Meta, o Google está em uma situação semelhante. Mais recentemente, o Google teve que negar as alegações de que seu recurso de preenchimento automático de pesquisa estava censurando resultados sobre a tentativa de assassinato de Trump. Trump expressou forte insatisfação com isso nas redes sociais, dizendo que esta era mais uma tentativa de manipular a eleição, e apelou a todos para prestarem atenção ao comportamento da Meta e do Google.

Desde o advento da IA generativa, como o ChatGPT, toda a indústria tecnológica tem lutado com o problema da IA gerar informações falsas. Empresas como a Meta tentam melhorar os seus chatbots fornecendo dados de alta qualidade e resultados de pesquisa em tempo real, mas este incidente mostra que estes grandes modelos de linguagem ainda são propensos a gerar desinformação, uma falha inerente ao seu design.

Kaplan disse que a Meta continuará trabalhando para resolver esses problemas e melhorando sua tecnologia com base no feedback do usuário para lidar melhor com eventos em tempo real. Esta série de eventos não só destaca os potenciais problemas da tecnologia de IA, mas também desperta mais atenção do público para a precisão e transparência da IA.

Destaques:

1. A Meta AI afirmou erroneamente que o assassinato de Trump não aconteceu, causando preocupação.

2. ❌ Os executivos dizem que esse erro, chamado de “ilusão”, é um problema comum no setor.

3. O Google também foi acusado de censurar resultados de pesquisa relevantes, causando a insatisfação de Trump.

Em suma, os erros da Meta AI lembram-nos mais uma vez que, embora desfrutemos da conveniência trazida pela tecnologia de IA, devemos estar atentos aos seus riscos potenciais e reforçar a supervisão e orientação da tecnologia de IA para garantir o seu desenvolvimento saudável e evitar o seu abuso ou utilização indevida. usar. Só assim a IA poderá realmente beneficiar a humanidade.