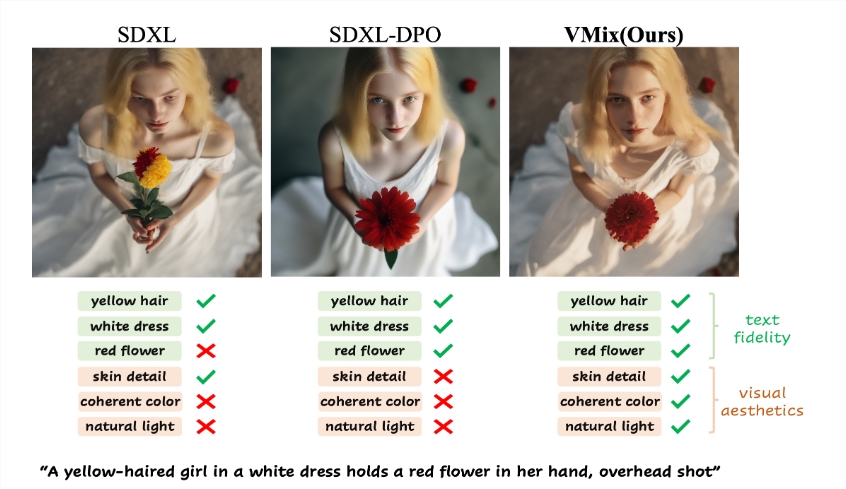

Este artigo apresenta o novo adaptador de modelo de difusão VMix proposto pela equipe de pesquisa da ByteDance e da Universidade de Ciência e Tecnologia da China, com o objetivo de melhorar a qualidade e o efeito estético da geração de texto para imagem. VMix usa um método inteligente de controle condicional para aprimorar o desempenho estético dos modelos de difusão existentes e manter a consistência entre imagens e descrições de texto sem retreinar o modelo. Ele decompõe dicas de texto em descrições estéticas e de conteúdo e integra informações estéticas no processo de geração de imagens por meio de um mecanismo híbrido de atenção cruzada para obter controle refinado sobre a estética da imagem. O adaptador é compatível com uma variedade de modelos de comunidade e possui uma ampla gama de possibilidades de aplicação.

No campo da geração de imagens a partir de texto, o modelo de difusão demonstrou capacidades extraordinárias, mas ainda existem algumas deficiências na geração estética de imagens. Recentemente, uma equipe de pesquisa da ByteDance e da Universidade de Ciência e Tecnologia da China propôs uma nova tecnologia chamada adaptador "Cross-Attention Value Mixing Control" (VMix), que visa melhorar a qualidade das imagens geradas e manter a sensibilidade a vários efeitos visuais. Versatilidade de conceito.

A ideia central do adaptador VMix é melhorar o desempenho estético dos modelos de difusão existentes, projetando métodos de controle condicional superiores e, ao mesmo tempo, garantindo o alinhamento entre imagens e texto.

Este adaptador atinge seu objetivo principalmente por meio de duas etapas: primeiro, ele decompõe as dicas do texto de entrada em descrições de conteúdo e descrições estéticas, inicializando incorporações estéticas, em segundo lugar, durante o processo de eliminação de ruído, misturando atenção cruzada, incorporando condições estéticas nele para aprimorar o; efeito estético da imagem e manter a consistência entre a imagem e a palavra-chave. . A flexibilidade desta abordagem permite que o VMix seja aplicado a vários modelos de comunidade sem necessidade de reciclagem, melhorando assim o desempenho visual.

Os pesquisadores verificaram a eficácia do VMix por meio de uma série de experimentos, e os resultados mostraram que o método superou outros métodos de última geração na geração de imagens estéticas. Ao mesmo tempo, VMix também é compatível com uma variedade de módulos comunitários (como LoRA, ControlNet e IPAdapter), ampliando ainda mais seu escopo de aplicação.

O controle refinado do VMix sobre a estética se reflete na capacidade de ajustar incorporações estéticas, que podem melhorar dimensões específicas da imagem por meio de rótulos estéticos unidimensionais ou melhorar a qualidade geral da imagem por meio de rótulos estéticos frontais completos. Em experimentos, quando o usuário recebe uma descrição de texto como "uma garota encostada na janela, brisa soprando, retrato de verão, foto de comprimento médio", o adaptador VMix pode melhorar significativamente a beleza da imagem gerada.

O adaptador VMix abre novas direções para melhorar a qualidade estética da geração de texto para imagem e espera-se que realize seu potencial em uma gama mais ampla de aplicações no futuro.

Entrada do projeto: https://vmix-diffusion.github.io/VMix/

Destaques:

O adaptador VMix decompõe prompts de texto em conteúdo e descrições estéticas por meio de incorporação estética, melhorando a qualidade da geração de imagens.

Este adaptador é compatível com vários modelos de comunidade, permitindo aos usuários melhorar os efeitos visuais da imagem sem retreinamento.

Resultados experimentais mostram que o VMix supera as tecnologias existentes na geração estética e tem amplo potencial de aplicação.

Resumindo, o adaptador VMix fornece uma solução eficaz para melhorar a arte e a beleza da geração de imagens de IA. Ele também tem um desempenho excelente em termos de compatibilidade e facilidade de uso, fornecendo novas direções e possibilidades para o desenvolvimento de futuras tecnologias de geração de imagens.