O lançamento de Iflytek do modelo de interação multimodal de Iflytek marca um novo marco no campo da inteligência artificial. Esse modelo interrompe as limitações da interação de voz única no passado, realiza uma integração perfeita de um clique das funções de interação humana de voz, visual e digital, trazendo aos usuários uma experiência interativa mais vívida, mais realista e mais conveniente. Sua tecnologia humana digital super-antropomórfica pode combinar com precisão o conteúdo de voz para gerar expressões e ações e suporta a interação super-antropomórfica, ajustar os parâmetros de som de acordo com as instruções e fornecer serviços personalizados. A função de interação visual multimodal oferece ao modelo a capacidade de "entender o mundo e reconhecer tudo", perceber com precisão informações ambientais e fazer respostas mais apropriadas.

O lançamento do modelo de interação multimodal de Iflytek não apenas reflete a posição de liderança de Iflytek na tecnologia de interação multimodal, mas também fornece novas idéias para a direção futura de desenvolvimento de aplicações de inteligência artificial. Ao integrar vários métodos de interação, esse modelo pode entender melhor as necessidades do usuário e fornecer serviços mais precisos e ricos. Seu SDK aberto também fornece aos desenvolvedores mais possibilidades para promover a popularização e a aplicação da tecnologia de inteligência artificial multimodal. No futuro, podemos esperar aplicativos mais inovadores com base nesse modelo para melhorar ainda mais a eficiência da vida das pessoas e experimentar a qualidade.

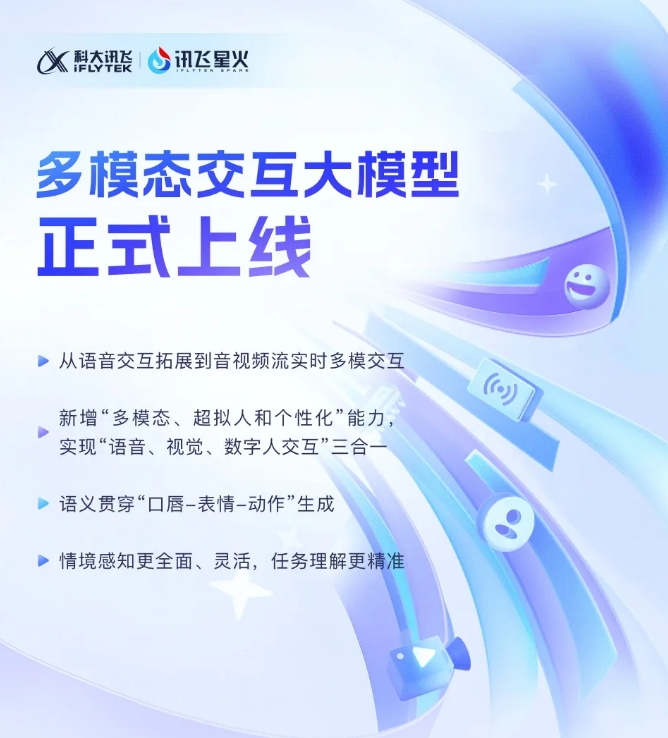

Iflytek anunciou recentemente que seu mais recente desenvolvimento do modelo de interação multimodal de Iflytek foi oficialmente colocado em operação. Esse avanço tecnológico marca um novo estágio na expansão de Iflytek de uma tecnologia de interação de voz única para um novo estágio da interação multimodal em tempo real dos fluxos de áudio e vídeo. O novo modelo integra funções de interação humana de voz, visual e digital, e os usuários podem obter uma combinação perfeita das três a um clique.

O lançamento do modelo de interação multimodal de Iflytek introduziu a tecnologia humana digital super-antropomórfica pela primeira vez. e real. Ao integrar texto, fala e expressões, o novo modelo pode obter consistência semântica cruzada, tornando a expressão emocional mais realista e coerente.

Além disso, o IFlytek Spark suporta a tecnologia de interação super-rápida super antropomórfica, usando uma rede neural unificada para realizar diretamente a modelagem de ponta a ponta da voz a voz, tornando a velocidade de resposta mais rápida e suave. Essa tecnologia pode perceber profundamente as mudanças emocionais e ajustar livremente o ritmo, o tamanho e o caráter do som de acordo com as instruções, proporcionando uma experiência interativa mais personalizada.

Em termos de interação visual multimodal, o IFLYTEK Spark pode "entender o mundo" e "reconhecer tudo", e perceber totalmente cenas de fundo específicas, status de logística e outras informações, tornando a compreensão da tarefa mais precisa. Ao integrar várias informações, como voz, gestos, comportamentos, emoções etc., o modelo pode fazer respostas apropriadas, fornecendo aos usuários uma experiência interativa mais rica e mais precisa.

Interação multimodal grande modelo SDK: https://www.xfyun.cn/solutions/multimodel

Em suma, o surgimento do modelo de interação multimodal IFLYTEK indica que a tecnologia de inteligência artificial entrou em um novo estágio de desenvolvimento. Ansioso pelo Iflytek Spark trará mais surpresas no futuro.