В последнее время популярность приложений AI-модели большого языка (LLM) привела к жесткой конкуренции в области аппаратного обеспечения. AMD выпустила свою новейшую серию гибридных процессоров Strix Point, а ее процессоры Ryzen AI демонстрируют значительные преимущества в решении задач LLM, а их производительность значительно превосходит серию Intel Lunar Lake. Редактор Downcodes даст вам более глубокое понимание производительности серии Strix Point APU и технологических инноваций, стоящих за ней.

Недавно компания AMD выпустила свою новейшую серию гибридных процессоров Strix Point, подчеркнув выдающуюся производительность этой серии в приложениях модели большого языка искусственного интеллекта (LLM), значительно превосходящую процессоры серии Intel Lunar Lake. Поскольку спрос на рабочие нагрузки ИИ продолжает расти, конкуренция за оборудование становится все более жесткой. В ответ на запросы рынка компания AMD выпустила процессоры искусственного интеллекта, предназначенные для мобильных платформ, стремясь обеспечить более высокую производительность и меньшую задержку.

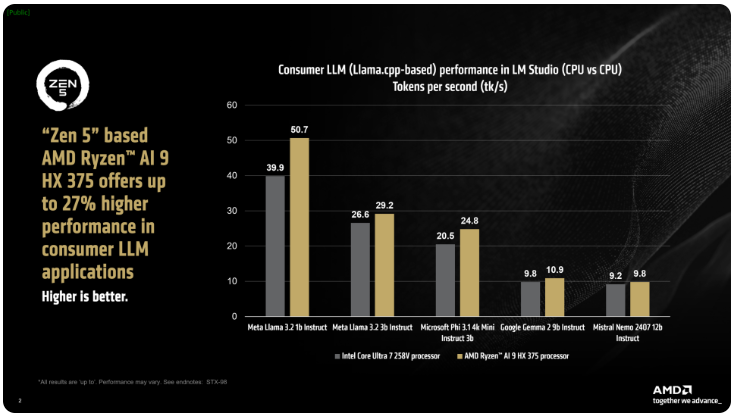

В AMD заявили, что процессор Ryzen AI300 серии ix Point способен значительно увеличить количество обрабатываемых токенов в секунду при обработке задач AI LLM. По сравнению с процессором Intel Core Ultra258V производительность Ryzen AI9375 улучшилась на 27%. Хотя Core Ultra7V не является самой быстрой моделью в серии L Lake, его количество ядер и потоков близко к процессорам Lunar Lake более высокого класса, что свидетельствует о конкурентоспособности продуктов AMD в этой области.

Инструмент AMD LM Studio — это ориентированное на потребителя приложение, основанное на платформе llama.cpp и предназначенное для упрощения использования больших языковых моделей. Платформа оптимизирует производительность процессоров x86. Хотя для запуска LLM не требуется графический процессор, его использование может еще больше ускорить обработку. Согласно тесту, Ryzen AI9HX375 может достичь в 35 раз меньшей задержки в модели Meta Llama3.21b Instruct, обрабатывая 50,7 токенов в секунду. Для сравнения, Core Ultra7258V — всего 39,9 токенов.

Мало того, Strix Point APU также оснащен мощной интегрированной видеокартой Radeon на базе архитектуры RDNA3.5, которая может перегружать задачи на iGPU через API ulkan для дальнейшего повышения производительности LLM. Используя технологию переменной графической памяти (VGM), процессор Ryzen AI300 может оптимизировать распределение памяти, повысить энергоэффективность и в конечном итоге добиться повышения производительности до 60%.

В сравнительных тестах AMD использовала те же настройки на платформе Intel AI Playground и обнаружила, что Ryzen AI9HX375 на 87 % быстрее, чем Core Ultra7258V на Microsoft Phi3.1, и на 13 % быстрее на модели Mistral7b Instruct0.3. Тем не менее, результаты более интересны по сравнению с Core Ultra9288V, флагманом серии Lunar Lake. В настоящее время AMD концентрирует усилия на том, чтобы сделать использование больших языковых моделей более популярным с помощью LM Studio, стремясь облегчить начало работы для большего количества нетехнических пользователей.

Запуск серии AMD Strix Point APU знаменует собой дальнейшее усиление конкуренции в области процессоров искусственного интеллекта, а также указывает на то, что будущие приложения искусственного интеллекта будут иметь более мощную аппаратную поддержку. Улучшения в производительности и энергоэффективности обеспечат пользователям более плавный и мощный опыт работы с искусственным интеллектом. Редактор Downcodes продолжит обращать внимание на последние разработки в этой области и предлагать читателям еще больше интересных отчетов.