Редактор Downcodes узнал, что Институт искусственного интеллекта Аллена (Ai2) недавно выпустил Molmo, новое семейство мультимодальных моделей искусственного интеллекта с открытым исходным кодом. Его производительность потрясающая, даже превосходящая OpenAI GPT-4o и Anthropic в нескольких сторонних тестах производительности. . Клод 3.5 Sonnet и Google Gemini 1.5. Molmo не только анализирует загруженные пользователем изображения, но и использует в 1000 раз меньше данных во время обучения, чем его конкуренты, благодаря своим уникальным методам обучения. Этот прорыв демонстрирует приверженность Ai2 открытым исследованиям, делая высокопроизводительные модели, а также открытые веса и данные доступными для более широкого сообщества и предприятий.

Molmo не только принимает для анализа загруженные пользователем изображения, но и использует для обучения «в 1000 раз меньше данных, чем конкуренты» благодаря своим уникальным методикам обучения.

Этот выпуск демонстрирует приверженность Ai2 открытым исследованиям, предоставляя высокопроизводительные модели с открытыми весами и данными для использования более широким сообществом и предприятиями. Семейство Molmo включает четыре основные модели, а именно Molmo-72B, Molmo-7B-D, Molmo-7B-O и MolmoE-1B — флагманская модель, содержащая 7,2 миллиарда параметров, и ее производительность особенно выдающаяся.

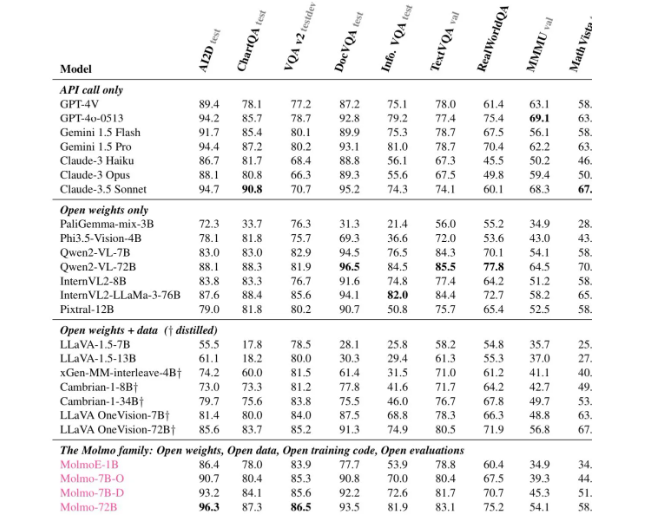

По разным оценкам, «Молмо-72Б» получил высшие оценки по 11 важным критериям и занял второе место после -4о по предпочтениям пользователей. Ai2 также запустила модель OLMoE, используя подход «малой комбинации моделей» для повышения экономической эффективности.

Архитектура Molmo была тщательно разработана для обеспечения эффективности и превосходной производительности. Все модели используют модель OpenAI ViT-L/14336px CLIP в качестве визуального кодировщика для обработки многомасштабных изображений в визуальные команды. Частью языковой модели является декодер Transformer, который имеет разные возможности и открытость.

Что касается обучения, Mol проходит два этапа обучения: первый — предварительное обучение на нескольких моделях, а второй — контролируемая точная настройка. В отличие от многих современных моделей, Molmo не полагается на обучение с подкреплением с обратной связью от человека, а вместо этого обновляет параметры модели посредством тщательно настроенного процесса обучения.

Molmo показал хорошие результаты во многих тестах, особенно в сложных задачах, таких как чтение документов и визуальное мышление, продемонстрировав свои сильные возможности. Ai2 опубликовала эти модели и наборы данных на Hugging Face и в ближайшие месяцы запустит больше моделей и расширенных технических отчетов, чтобы предоставить исследователям больше ресурсов.

Если вы хотите узнать о возможностях Molmo, публичные демонстрации теперь доступны на официальном сайте Molmo (https://molmo.allenai.org/).

Выделять:

Модальная модель искусственного интеллекта с открытым исходным кодом Ai2Molmo превосходит лучшие продукты отрасли.

? Mol-72B показывает хорошие результаты во многих тестах, уступая только GPT4o.

Он очень открыт, и исследователи могут свободно использовать модели и наборы данных.

В целом, появление Molmo знаменует собой крупный прогресс в области мультимодального искусственного интеллекта, а его открытый исходный код также предоставляет ценные ресурсы для исследователей по всему миру. Редактор Downcodes надеется, что Molmo будет более широко использоваться и развиваться в будущем и будет способствовать постоянному прогрессу технологий искусственного интеллекта.