В области разработки программного обеспечения применение инструментов кодирования искусственного интеллекта совершает тихую революцию. Команды разработчиков широко используют кодирование с помощью ИИ. Однако руководству компаний не хватает эффективного надзора и контроля за использованием инструментов ИИ. Это спровоцировало «игру в кошки-мышки» между разработчиками и руководством по поводу применения инструментов искусственного интеллекта и связанных с этим рисков безопасности.

В мире технологий между разработчиками и руководством идет игра в кошки-мышки. Главными героями этой игры являются инструменты кодирования искусственного интеллекта, которые явно запрещены компанией, но до сих пор незаметно используются разработчиками.

Согласно новому глобальному исследованию компании Checkmarx, занимающейся облачной безопасностью, хотя 15% компаний явно запрещают использование инструментов ИИ-кодирования, почти все команды разработчиков (99%) используют их. Этот феномен обнажает проблемы в контроле над использованием генеративного ИИ.

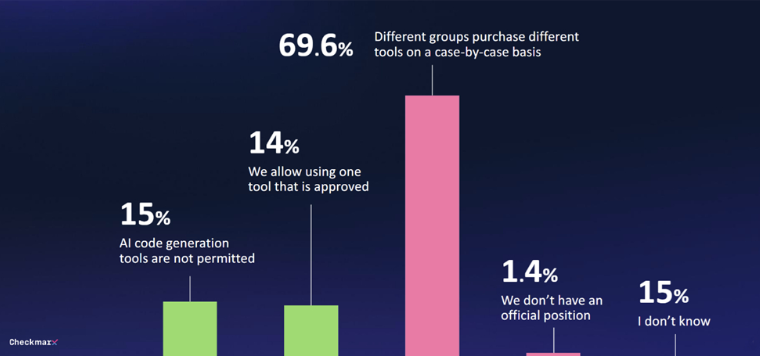

Только 29% компаний имеют ту или иную форму управления инструментами генеративного ИИ. В 70% случаев единой стратегии нет, и решения о закупках принимаются различными подразделениями ситуативно. Эта ситуация затрудняет менеджменту контроль за использованием инструментов кодирования ИИ.

С ростом популярности инструментов ИИ-кодирования вопросы безопасности становятся все более заметными. 80% респондентов обеспокоены потенциальными угрозами, которые разработчики могут нести при использовании ИИ, особенно 60% выражают обеспокоенность по поводу «галлюцинаций», вызванных ИИ.

Несмотря на опасения, интерес к потенциалу ИИ остается сильным. 47% респондентов готовы разрешить ИИ вносить изменения в код без присмотра. Лишь 6% заявили, что не будут доверять мерам безопасности ИИ в программных средах.

«Ответы этих глобальных директоров по информационной безопасности показывают реальность того, что разработчики используют ИИ при разработке приложений, даже если они не могут надежно создавать безопасный код с использованием ИИ, а это означает, что командам безопасности приходится бороться с потоком новых уязвимых атак», — сказал Цруя Код. ."

Недавний отчет Microsoft Work Trends Index показал аналогичные результаты: многие сотрудники используют свои собственные инструменты искусственного интеллекта, хотя их нет. Часто такое использование не обсуждают, что препятствует систематической интеграции генеративного ИИ в бизнес-процессы.

Несмотря на явные запреты, 99% команд разработчиков по-прежнему используют инструменты искусственного интеллекта для генерации кода. Только 29% компаний создали механизмы управления использованием генеративного ИИ. В 70% случаев решения об использовании инструментов ИИ различными ведомствами принимаются на разовой основе. В то же время растут проблемы безопасности. 47% респондентов готовы разрешить ИИ вносить изменения в код без присмотра. Команды безопасности сталкиваются с проблемой обработки больших объемов потенциально уязвимого кода, созданного искусственным интеллектом.

Эта «игра в кошки-мышки» между разработчиками и руководством продолжается, и нам придется подождать и посмотреть, куда пойдет будущее инструментов ИИ-кодирования.

Применение инструментов ИИ-кодирования стало тенденцией, но нельзя игнорировать риски безопасности, которые оно несет. Компаниям необходимо создать надежный механизм управления, чтобы сбалансировать повышение эффективности, обеспечиваемое ИИ, с потенциальными рисками безопасности, чтобы лучше адаптироваться к этой технологической волне.