Недавний исследовательский отчет, опубликованный Google, предупреждает, что генеративный искусственный интеллект (GenAI) загрязняет Интернет ложным контентом. В докладе отмечается, что существуют бесконечные случаи злоупотребления GenAI, от подделки портретов до фабрикации доказательств, в основном с целью влияния на общественное мнение, мошенничества или получения прибыли. Сама Google также стала источником дезинформации из-за своих продуктов искусственного интеллекта, которые дают нелепые предложения, что делает его предупреждения еще более тревожными и заставляет людей глубоко задуматься о потенциальных рисках GenAI.

Недавно исследователи из Google предупредили, что генеративный искусственный интеллект (GenAI) разрушает Интернет фейковым контентом. Это не только предупреждение, но и время самоанализа.

По иронии судьбы, Google играет двойную роль в этой «войне между правдой и ложью». С одной стороны, это важный пропагандист генеративного ИИ, а с другой стороны, он также является производителем дезинформации. Функция обзора искусственного интеллекта Google содержала нелепые предложения, такие как «нанести клей на пиццу» и «съесть камни», и эти ошибочные сообщения в конечном итоге пришлось удалить вручную.

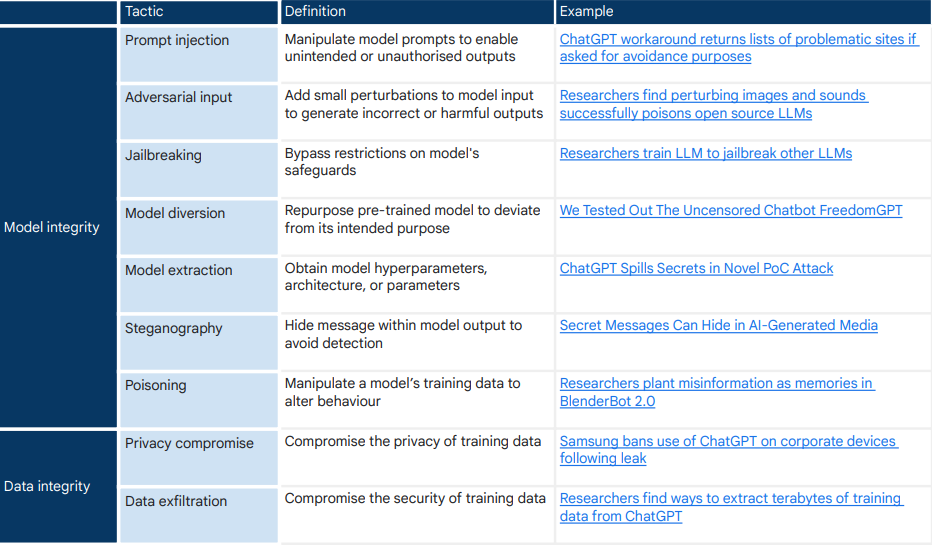

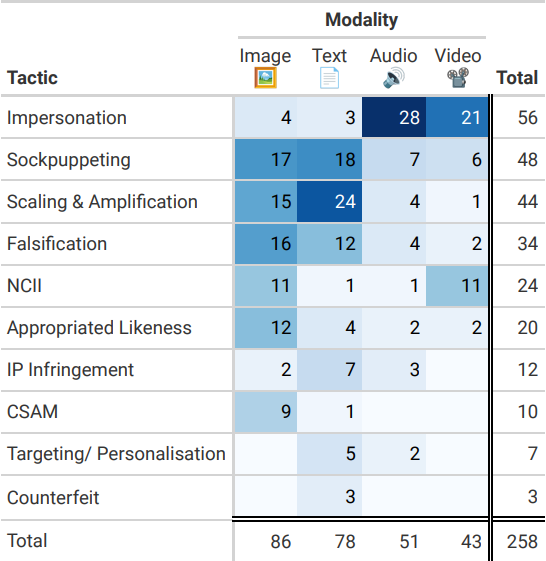

Исследовательская группа Google провела углубленное расследование 200 новостных сообщений о злоупотреблениях генеративным искусственным интеллектом и обнаружила, что подделка человеческих портретов и фабрикация доказательств являются наиболее распространенными методами злоупотреблений. Целью этих действий является не что иное, как повлиять на общественное мнение, обмануть или получить прибыль. Хотя риски генеративного ИИ еще не поднялись до уровня «экзистенциальной угрозы», они происходят сейчас и могут усугубиться в будущем.

Исследователи обнаружили, что большинство случаев злоупотреблений GenAI представляли собой обычное использование системы и не включали «взлома тюрьмы». На этот вид «рутинной работы» приходится 90%. Широкая доступность, доступность и гиперреализм GenAI допускают бесконечные формы злоупотреблений на более низком уровне. Стоимость создания ложной информации слишком низка!

Материалы исследования Google в основном основаны на сообщениях средств массовой информации. Означает ли это, что выводы исследования предвзяты средствами массовой информации? СМИ более склонны сообщать о сенсационных событиях, что может привести к тому, что набор данных будет смещен в сторону определенных типов злоупотреблений. 404Media отмечает, что существует множество незарегистрированных злоупотреблений генеративным ИИ, о которых нам пока неизвестно.

«Заборы» инструментов ИИ можно ловко обойти, воспользовавшись некоторыми советами. Например, инструмент клонирования голоса ElevenLabs с искусственным интеллектом может с высокой степенью точности имитировать голоса коллег или знаменитостей. Пользователи Civitai могут создавать изображения знаменитостей, генерируемые искусственным интеллектом, и хотя платформа придерживается политики против NCII (интимных изображений без согласия), ничто не мешает пользователям использовать инструменты с открытым исходным кодом для создания NCII на своих собственных машинах.

Когда распространяется ложная информация, хаос в Интернете станет серьезным испытанием для способности людей различать правду и ложь. Мы окажемся в ловушке постоянного сомнения: «Реально ли это?» Если оставить это без внимания, загрязнение общедоступных данных контентом, созданным ИИ, может также затруднить поиск информации и исказить коллективное восприятие социально-политической реальности или научного консенсуса.

Google способствовал распространению ложного контента, вызванного генеративным искусственным интеллектом. Пуля, выпущенная много лет назад, сегодня наконец попала ему между бровей. Исследование Google может стать началом самоспасения и тревожным звонком для всего интернет-сообщества.

Адрес статьи: https://arxiv.org/pdf/2406.13843.

Этот отчет Google, несомненно, звучит предупреждением о будущем развитии GenAI. Как сбалансировать технологическое развитие и контроль рисков, а также как эффективно реагировать на распространение ложной информации, распространяемой GenAI, — это общие проблемы, стоящие перед мировым технологическим сообществом и обществом. Мы с нетерпением ожидаем дальнейших исследований и действий по совместному поддержанию подлинности и чистоты Интернета.