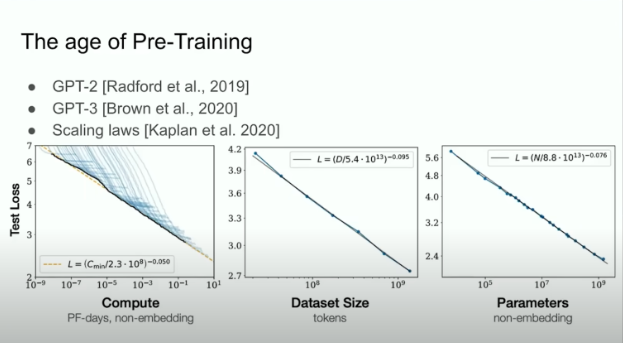

Сооснователь OpenAI Илья Сузквир выступил на конференции NeurIPS 2024, отметив, что эпоха предобучения искусственного интеллекта подходит к концу, и предсказав расцвет искусственного интеллекта-суперинтеллекта. Он считает, что существующие модели ИИ так же зависят от данных, как и от ископаемого топлива. Темпы роста общего объема данных больше не могут удовлетворить расширение потребностей моделей, поэтому необходимо изучить новые методы для расширения машинного интеллекта.

Соучредитель OpenAI Илья Суцкевер недавно заявил, что исследователи искусственного интеллекта должны найти новые способы расширения машинного интеллекта, чтобы преодолеть существующие ограничения.

Сузквер выступил с речью на конференции Neural Information Processing Systems (NeurIPS) 2024 года в Ванкувере, Канада, в которой он полагал, что эра предварительного обучения искусственному интеллекту подходит к концу, и предсказал рост сверхинтеллекта искусственного интеллекта.

Сузковир считает, что улучшение вычислительной мощности за счет улучшения аппаратного, программного обеспечения и алгоритмов машинного обучения опережает объем данных, доступных для обучения моделей ИИ. Исследователь искусственного интеллекта сравнивает данные с ископаемым топливом, которое однажды исчерпается. Сузковир сказал:

«Данные не будут расти, потому что у нас есть только один Интернет. Можно даже сказать, что данные — это ископаемое топливо ИИ. Они были каким-то образом созданы, и теперь мы их используем, и мы достигли пика данных, и их больше не будет. в будущем данных будет больше – нам придется иметь дело с теми данными, которые у нас есть».

Соучредитель OpenAI предсказывает, что искусственный интеллект агентов, синтетические данные и вычисления времени вывода станут следующим направлением развития искусственного интеллекта и в конечном итоге приведут к рождению сверхинтеллекта искусственного интеллекта.

Агенты ИИ могут разрушить существующие модели

Возможности агентов ИИ выходят за рамки существующих моделей чат-ботов, и они способны принимать решения без вмешательства человека. С появлением больших языковых моделей (LLM), таких как мем-монеты искусственного интеллекта и терминал истины, агенты искусственного интеллекта стали горячей темой в сфере криптовалют.

Терминал истины быстро стал популярным после того, как начал продвигать монету-мем под названием Goatseus Maximus (GOAT). В конечном итоге мемкоин достиг рыночной капитализации в 1 миллиард долларов, привлекая внимание розничных инвесторов и венчурных капиталистов.

Лаборатория искусственного интеллекта Google DeepMind выпустила Gemini 2.0 — модель искусственного интеллекта, которая станет основой для агентов ИИ.

По данным Google, агенты, созданные с использованием платформы Gemini 2.0, смогут помогать в решении сложных задач, таких как координация и логическое обоснование между веб-сайтами.

Достижения в области ИИ-агентов, которые могут действовать и рассуждать независимо, заложат основу для преодоления ИИ иллюзий данных.

Галлюцинации ИИ возникают из-за неправильных наборов данных, а предварительное обучение ИИ все чаще опирается на использование старых LLM для обучения новых LLM, что со временем снижает производительность.

Узкие места данных и будущее искусственного интеллекта

Точка зрения Сузковира подчеркивает огромную проблему, стоящую перед развитием ИИ: по мере того, как масштаб моделей ИИ продолжает расширяться, растет и спрос на данные. Однако реальность такова, что объем доступных данных растет не так быстро, как потребность модели в данных. Это заставляет исследователей искать новые методы преодоления узких мест в данных.

Агенты ИИ, синтетические данные и вычисления времени вывода могут стать новыми направлениями будущего развития ИИ. Ожидается, что эти технологии помогут моделям ИИ снизить зависимость от массивных данных и улучшить их возможности рассуждения и принятия решений. Появление сверхразума ИИ указывает на то, что технология ИИ может открыть новую эру, которая может полностью изменить наш существующий образ жизни и модели работы.

Однако появление сверхинтеллекта ИИ также вызвало обеспокоенность по поводу этики и безопасности ИИ. Как обеспечить управляемость и безопасность технологии искусственного интеллекта, одновременно наслаждаясь удобством, предоставляемым технологией искусственного интеллекта, — это вопрос, который нам необходимо серьезно рассмотреть.

В целом, речь Сузквера указала на новый путь будущего развития искусственного интеллекта. Она также напомнила нам о необходимости уделять внимание этическим проблемам и проблемам безопасности, возникающим в связи со сверхинтеллектом ИИ, и нам необходимо двигаться вперед осторожно и активно искать решения.