Представьте себе, что вы можете создавать высококачественную музыку или звуковые эффекты с помощью всего лишь нескольких звуков или ударов. Это уже не далекая мечта. Sketch2Sound, результат новаторских исследований искусственного интеллекта, обеспечивает создание высококачественного звука за счет сочетания имитации звука и текстовых подсказок. Он умело использует три ключевых сигнала управления громкостью, яркостью и высотой звука, извлеченные из имитации звука, и интегрирует их в потенциальную модель диффузии текста в аудио, тем самым помогая ИИ генерировать звуки, соответствующие конкретным требованиям, принося большие преимущества в области здоровое творение.

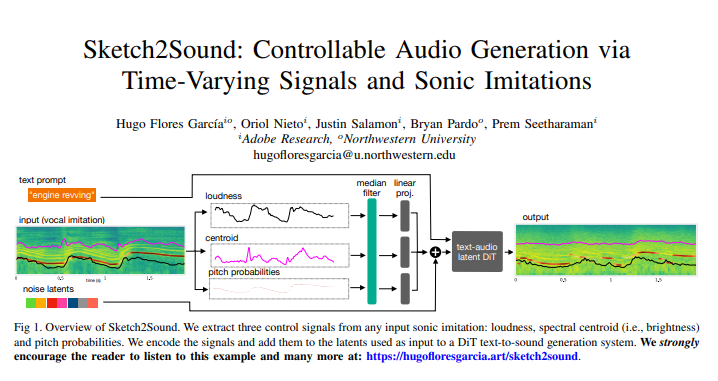

Основная технология Sketch2Sound — это способность извлекать три ключевых, изменяющихся во времени управляющих сигнала из любой звуковой имитации (например, голосовой имитации или эталонного звука): громкости, яркости (спектрального центроида) и высоты тона. После того, как эти управляющие сигналы закодированы, они добавляются к базовой модели диффузии, используемой для генерации текста в звук, тем самым направляя ИИ на создание звуков, отвечающих конкретным требованиям.

Самое впечатляющее в этой технологии — ее легкость и эффективность. Sketch2Sound построен на существующей модели скрытой диффузии текста в аудио, требующей всего 40 000 шагов точной настройки и требующей только одного линейного слоя для каждого управляющего сигнала, что делает его более кратким и эффективным, чем другие методы (например, ControlNet). Чтобы модель могла синтезировать звуковые имитации, похожие на «эскизы», исследователи также применили стохастический медианный фильтр к управляющему сигналу во время обучения, что позволило ему адаптироваться к управляющим сигналам с гибкими временными характеристиками. Результаты экспериментов показывают, что Sketch2Sound может не только синтезировать звуки, соответствующие входному сигналу управления, но также поддерживать соответствие текстовым подсказкам и достигать качества звука, сравнимого с базовым текстом.

Sketch2Sound предоставляет звукорежиссерам новый способ творчества. Они могут использовать семантическую гибкость текстовых подсказок в сочетании с выразительностью и точностью голосовых жестов или имитаций для создания беспрецедентных звуковых композиций. Это похоже на традиционных художников Фоли, которые создают звуковые эффекты, манипулируя объектами, в то время как Sketch2Sound направляет генерацию звука посредством звуковой имитации, придавая «гуманизированный» оттенок созданию звука и повышая художественную ценность звуковых произведений.

Sketch2Sound способен преодолеть свои ограничения по сравнению с традиционными методами взаимодействия текста и аудио. В прошлом звукорежиссерам приходилось тратить много времени на настройку временных характеристик генерируемых звуков, чтобы синхронизировать их с визуальными эффектами. Sketch2Sound естественным образом может достичь такой синхронизации посредством имитации звука и не ограничивается имитацией человеческого голоса, любого типа звука. имитация может использоваться для управления этой генеративной моделью.

Исследователи также разработали метод корректировки временных деталей управляющего сигнала путем применения медианных фильтров с разными размерами окон во время обучения. Это позволяет звукорежиссерам контролировать, насколько хорошо генеративная модель соответствует точности синхронизации управляющего сигнала, тем самым улучшая качество звуков, которые трудно идеально имитировать. В практических приложениях пользователи могут найти баланс между строгим соблюдением имитации звука и обеспечением качества звука, регулируя размер медианного фильтра.

Принцип работы Sketch2Sound заключается в том, чтобы сначала извлечь из входного аудиосигнала три управляющих сигнала: громкость, центроид спектра и высоту тона. Эти управляющие сигналы затем выравниваются со скрытыми сигналами в модели преобразования текста в звук, а модель скрытой диффузии настраивается с помощью простого слоя линейной проекции, чтобы в конечном итоге сгенерировать желаемый звук. Результаты экспериментов показывают, что настройка модели посредством изменяющегося во времени управления сигналом может значительно улучшить соответствие этому сигналу, оказывая при этом минимальное влияние на качество звука и соответствие текста.

Примечательно, что исследователи также обнаружили, что управляющие сигналы могут манипулировать семантикой генерируемых сигналов. Например, при использовании текстовой подсказки «лесная атмосфера», если к имитации звука добавляются случайные всплески громкости, модель может синтезировать крики птиц в этих всплесках громкости без дополнительной подсказки «птицы», что указывает на то, что модель усвоила корреляцию между всплески громкости и присутствие птиц.

Конечно, у Sketch2Sound есть некоторые ограничения, например, тот факт, что контроль центра масс может включать в сгенерированный звук звуки помещения, смоделированные входными звуками, возможно, потому, что звуки помещения кодируются центром масс, когда есть нет звуковых событий во входном аудио.

В общем, Sketch2Sound — это мощная генеративная модель звука, которая может генерировать звуки с помощью текстовых подсказок и изменяющихся во времени элементов управления (громкость, яркость, высота звука). Он может генерировать звуки посредством имитации звука и кривых управления «эскизом», он легок и эффективен. Он предоставляет звукорежиссерам управляемый, основанный на жестах и выразительный инструмент, который может генерировать звуки с гибкой синхронизацией. Любой звук с уникальными характеристиками будет иметь широкий диапазон. перспективы применения в области создания музыки и звукового дизайна игр в будущем.

Адрес статьи: https://arxiv.org/pdf/2412.08550.

Появление Sketch2Sound знаменует новую эру в области создания звука. Он предоставляет художникам беспрецедентную творческую свободу и возможности, а также открывает неограниченное пространство для воображения в музыке, играх, фильмах и других областях. Я верю, что в ближайшем будущем эта технология будет использоваться более широко и принесет нам более красочный звуковой мир.