Дипфейки, как быстро развивающийся враждебный искусственный интеллект, представляют собой все более серьезную угрозу мировой экономике и безопасности. Ожидается, что экономический ущерб, причиненный им, значительно вырастет, при этом основной мишенью станет сфера банковских и финансовых услуг. В этой статье будет проанализирована тенденция быстрого развития технологии дипфейков, риски и проблемы, которые она несет для предприятий и частных лиц, а также будут исследованы дилеммы, с которыми сталкиваются предприятия при борьбе с этой новой угрозой.

Ожидается, что потери, связанные с дипфейками, поскольку это одна из самых быстрорастущих форм состязательного искусственного интеллекта, вырастут с 12,3 миллиардов долларов в 2023 году до 40 миллиардов долларов в 2027 году, а совокупный годовой темп роста составит ошеломляющие 32%. Deloitte ожидает резкого роста количества дипфейков в ближайшие годы, при этом основной целью станут банковские и финансовые услуги.

Дипфейки находятся в авангарде состязательных атак с использованием искусственного интеллекта, их рост только за последний год составил 3000%. Ожидается, что к 2024 году количество дипфейков увеличится на 50–60%, при этом в этом году во всем мире ожидается 140 000–150 000 таких инцидентов.

Последнее поколение генеративных приложений, инструментов и платформ искусственного интеллекта предоставляет злоумышленникам все необходимое для быстрого и экономичного создания дипфейковых видео, вымышленных голосов и поддельных документов. По оценкам Pindrops в отчете по речевому анализу и безопасности за 2024 год, мошенничество с использованием дипфейков, нацеленное на контакт-центры, обходится примерно в 5 миллиардов долларов в год. В их докладе подчеркивается серьезная угроза, которую дипфейки представляют для банковских и финансовых услуг.

В прошлом году агентство Bloomberg сообщило, что «в темной сети возникла целая кустарная индустрия, продающая мошенников по цене от 20 до тысяч долларов». Совсем недавно появилась инфографика, основанная на отчете Sumsub о мошенничестве с личными данными за 2023 год. Она дает глобальный взгляд на быстрый рост мошенничества с использованием ИИ. .

У трети предприятий нет стратегии борьбы с риском состязательных атак с использованием искусственного интеллекта, которые, скорее всего, начнутся с дипфейков их ключевых руководителей. Новое исследование Ivanti показало, что 30% предприятий не имеют плана по выявлению и защите от атак с использованием искусственного интеллекта.

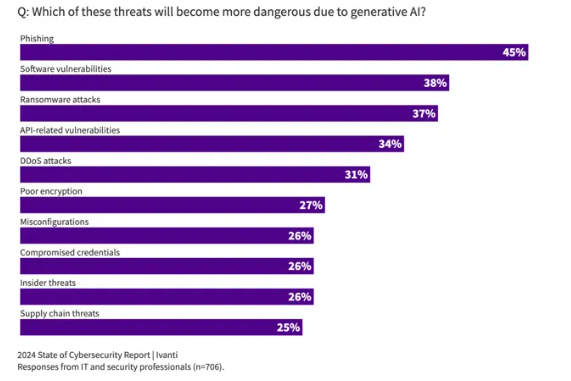

В отчете Ivanti о состоянии кибербезопасности за 2024 год говорится, что 74% опрошенных компаний видели доказательства угроз ИИ. Подавляющее большинство (89%) считают, что угроза ИИ только начинается. Из большинства директоров по информационной безопасности, ИТ-директоров и ИТ-руководителей, опрошенных Иванти, 60% были обеспокоены тем, что их организации не готовы защищаться от угроз и атак ИИ. Использование дипфейков как части организованной стратегии, включающей фишинг, программные эксплойты, программы-вымогатели и уязвимости, связанные с API, становится все более распространенным. Это соответствует угрозам, которые, как ожидают специалисты по безопасности, станут более опасными из-за нового поколения искусственного интеллекта.

Столкнувшись с быстрым развитием технологии глубокой подделки и огромными рисками, которые она несет, компаниям необходимо активно принимать контрмеры, усиливать защиту и повышать осведомленность сотрудников о рисках, чтобы эффективно сокращать потери и обеспечивать собственную безопасность. Развитие технологий также необходимо развивать одновременно с совершенствованием мер безопасности, чтобы предотвратить злоупотребление технологиями.