Adobe, как гигант в области программного обеспечения для творчества, вызвала огромные споры, обновив свои условия обслуживания. Это обновление позволяет Adobe получить доступ к работам пользователей для улучшения своей модели искусственного интеллекта Firefly. Этот шаг подвергся широкой критике как «повелительская оговорка», нарушающая авторские права и конфиденциальность пользователей. В этой статье будет проведен углубленный анализ разногласий, вызванных обновлением условий обслуживания Adobe, рассмотрены причины этого, а также все более напряженные отношения между технологическими компаниями и пользователями.

Adobe, известная компания в творческой индустрии, известна как «Защитник авторских прав» за свою позицию в области защиты авторских прав. Но недавно компания попала в водоворот общественного мнения из-за незаметно обновленных условий обслуживания.

В феврале этого года Adobe незаметно обновила условия обслуживания своего продукта, добавив привлекательное дополнение: пользователи должны согласиться с тем, что Adobe может получить доступ к своим работам автоматическими и ручными способами, в том числе защищенными соглашениями о конфиденциальности. Adobe будет использовать эти разработки для улучшения своих услуг и программного обеспечения с помощью таких технологий, как машинное обучение. Если пользователи не согласятся с этими новыми условиями, они не смогут использовать программное обеспечение Adobe.

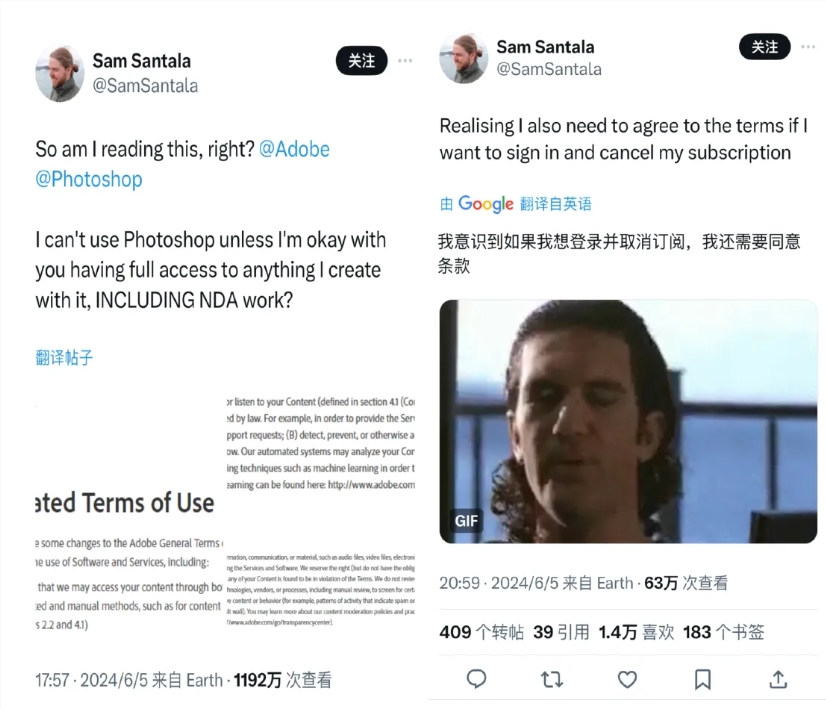

Недавно было объявлено об этом изменении, что вызвало негативную реакцию со стороны основных пользователей Adobe, включая креативщиков, цифровых художников и дизайнеров. Они считают, что это принудительное разрешение, по сути, «оговорка о повелителе», и его настоящая цель — обучение генеративной модели ИИ Adobe «Светлячок». Блогер по имени Сэм Сантала поставил под сомнение это положение в Твиттере, и его твит получил десятки миллионов просмотров.

Многие пользователи выразили обеспокоенность по поводу своей конфиденциальности и авторских прав и решили прекратить использование продуктов Adobe. В то же время Meta приняла аналогичные меры и обновила свою политику конфиденциальности, чтобы разрешить использование информации, предоставленной пользователями о продуктах и услугах Meta, для обучения ИИ. Если пользователи не согласны с новой политикой конфиденциальности, им следует рассмотреть возможность прекращения использования продуктов социальных сетей, таких как Facebook и Instagram.

С быстрым развитием технологий искусственного интеллекта борьба между технологическими компаниями и пользователями за конфиденциальность данных, владение контентом и контроль становится все более ожесточенной. Adobe утверждает, что данные для обучения ее модели Firefly взяты из сотен миллионов изображений в библиотеке изображений Adobe, некоторых изображений, имеющих общедоступную лицензию, а также общедоступных изображений, срок защиты авторских прав которых истек. Однако другие инструменты создания изображений ИИ, такие как Stable Diffusion от Stability AI, Dall-E2 от OpenAI и Midjourney, вызвали споры из-за проблем с авторскими правами.

Adobe пытается занять дифференцированную позицию на рынке в этой области и стать «белым рыцарем» в гонке вооружений ИИ, подчеркивая легитимность данных обучения своей модели и обещая выплатить претензии в спорах об авторских правах, вызванных использованием сгенерированных изображений. от Adobe Firefly. Но эта стратегия не успокоила всех пользователей. Некоторые пользователи, такие как старший дизайнер Аджи, в шутку называют себя «настоящими жертвами Adobe» и полагают, что Adobe использует свою огромную творческую экосистему для обучения ИИ. Хотя это разумная бизнес-стратегия для пользователей, платформы и творчества. Распределение интересов между ними. пользователей и право пользователя знать отсутствуют.

Кроме того, споры об авторских правах с Adobe неоднократно разоблачались за рубежом, заставляя пользователей сомневаться в том, действительно ли Adobe уважает авторские права авторов. Например, художник Брайан Кесингер обнаружил, что сгенерированные искусственным интеллектом изображения, похожие на его работы, продавались под его именем в библиотеке изображений Adobe без его согласия. Семья фотографа Ансела Адамса также публично обвинила Adobe в якобы продаже генеративных подделок работ покойного фотографа с помощью искусственного интеллекта.

Под давлением общественного мнения Adobe 19 июня пересмотрела свои условия обслуживания, дав понять, что не будет использовать пользовательский контент, хранящийся локально или в облаке, для обучения моделей ИИ. Но разъяснение не полностью развеяло опасения создателей. Некоторые известные блоггеры в зарубежном кругу ИИ отметили, что пересмотренные условия обслуживания Adobe по-прежнему позволяют использовать данные частного облака пользователей для обучения моделей машинного обучения инструментов негенеративного ИИ. Хотя пользователи могут отказаться от «контент-анализа», сложная операция отмены часто отталкивает многих пользователей.

В разных странах и регионах действуют разные правила защиты пользовательских данных, что также влияет на стратегии платформ социальных сетей при формулировании условий обслуживания пользователей. Например, в соответствии с Общим регламентом защиты данных (GDPR) пользователи в Великобритании и ЕС имеют «право на возражение» и могут явно отказаться от использования их личных данных для обучения моделей искусственного интеллекта Meta. Однако пользователи из США не имеют такого же права знать. Согласно существующей политике обмена данными Meta, контент, размещенный пользователями из США в продуктах социальных сетей Meta, может быть использован для обучения ИИ без явного согласия.

Данные провозглашаются «новой нефтью» в эпоху искусственного интеллекта, но в «эксплуатации» ресурсов все еще остается много серых зон. Некоторые технологические компании приняли расплывчатый подход к получению пользовательских данных, что вызвало двойную дилемму прав пользователей на личную информацию: вопросы владения цифровыми авторскими правами и вопросы конфиденциальности данных, что серьезно подрывает доверие пользователей к платформе.

В настоящее время платформа по-прежнему имеет серьезные недостатки в обеспечении того, чтобы генеративный ИИ не ущемлял права создателей, а также ей не хватает надлежащего контроля. Некоторые разработчики и создатели приняли меры и запустили серию «антиИИ»-инструментов, от инструмента защиты работы Glaze до инструмента отравления данных ИИ Nightshade и анти-ИИ-сообщества Cara, ставшего популярным на фоне несанкционированное использование пользователей/создателей технологическими компаниями. С согласия автора собираются соответствующие данные для обучения модели ИИ, и гнев людей усиливается.

Сегодня, в условиях быстрого развития технологий искусственного интеллекта, вопрос о том, как сбалансировать технологические инновации и безопасность конфиденциальности пользователей, а также защитить права и интересы создателей, все еще требует дальнейшего развития отрасли и постоянного совершенствования мер правового регулирования. В то же время пользователям необходимо быть более бдительными, понимать свои права на данные и при необходимости принимать меры для защиты своих творений и конфиденциальности.

Инцидент с Adobe — это лишь верхушка айсберга проблем компромисса данных в эпоху искусственного интеллекта. В будущем вопрос о том, как найти баланс между технологическим прогрессом и правами пользователей, станет важным вопросом для всех технологических компаний и регулирующих органов. . Только усилив надзор и прояснив правила использования данных, мы сможем построить более здоровую и устойчивую экологическую среду ИИ.