Чат-бот Google Gemini AI недавно запустил долгожданную функцию «памяти». Это обновление позволяет Gemini запоминать личную информацию пользователя, рабочий контент и предпочтения, тем самым предоставляя более персонализированные и эффективные услуги. Однако в настоящее время эта функция доступна только подписчикам Google One AI Premium (20 долларов США в месяц) и поддерживает только ввод через Интернет и на английском языке. Версии для iOS и Android еще не доступны в Интернете. Несмотря на свою мощь, он также вызывает обеспокоенность по поводу безопасности данных и защиты конфиденциальности.

Чат-бот Google с искусственным интеллектом Gemini недавно выпустил важное обновление — функцию «памяти», которая позволяет помощнику с искусственным интеллектом запоминать информацию о жизни пользователя, рабочий контент и личные предпочтения, тем самым обеспечивая более персонализированный опыт обслуживания.

Эта новая функция в настоящее время доступна только пользователям, оформившим подписку Google One AI Premium за 20 долларов в месяц, и в настоящее время поддерживается только на веб-странице и еще не запущена в приложениях iOS и Android. Стоит отметить, что в настоящее время поддерживается только английский ввод.

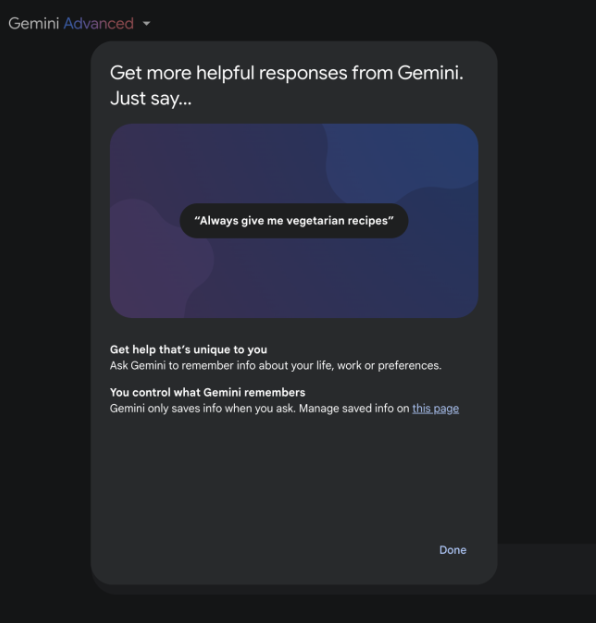

В частности, функция памяти Gemini может помочь пользователям реализовать множество практических сценариев. Например, после того, как пользователь расскажет Близнецам, какая еда ему нравится, в следующий раз, когда они попросят порекомендовать ресторан, ИИ сможет предоставить более целенаправленные предложения, основанные на вкусовых предпочтениях пользователя. Google также показывает в интерфейсе другие практические примеры, такие как «используйте простой язык и избегайте жаргона», «Я знаю только программирование на JavaScript» и «включайте ежедневные расходы при планировании поездки».

Google подчеркивает, что пользователи могут отключить функцию памяти в любой момент, но сохраненное содержимое памяти необходимо удалить вручную, прежде чем оно исчезнет. Что еще более важно, представитель Google ясно дал понять, что эта информация из памяти не будет использоваться для обучения моделей и не будет передана другим.

Однако безопасность этого типа функции памяти заслуживает беспокойства. Ранее в этом году исследователь безопасности обнаружил, что хакеры могут внедрить «фальшивые» воспоминания в ChatGPT, чтобы продолжить кражу пользовательских данных. Это открытие напоминает нам, что функция памяти систем искусственного интеллекта требует более строгих мер защиты.

Запуск этой функции отражает тенденцию того, что ИИ-помощники становятся более персонализированными и интеллектуальными, но также заставляет задуматься о защите конфиденциальности пользователей и безопасности данных. Как обеспечить безопасность пользовательских данных, обеспечивая при этом удобство, будет важным вопросом, на который поставщики услуг искусственного интеллекта должны продолжать обращать внимание.

Функция «памяти» Gemini, несомненно, улучшила пользовательский опыт, но ее вопросы безопасности и защиты конфиденциальности все еще нуждаются в дальнейшем улучшении. Это будет проблемой, с которой столкнется Google и даже вся индустрия искусственного интеллекта. Только когда будет обеспечена безопасность, ИИ сможет лучше служить человечеству.