Модели визуального языка (VLM) играют ключевую роль в мультимодальных задачах, но они страдают существенными недостатками в понимании отрицания. Существующие модели часто испытывают трудности с различением положительных и отрицательных предложений, что особенно тревожно в приложениях, требующих точного семантического понимания, таких как медицинский диагноз и мониторинг безопасности. Основная причина — это предвзятость в данных перед обучением, из-за которой модель путает отрицательные утверждения с положительными утверждениями. В этой статье будет представлена новая структура под названием NegBench, целью которой является решение проблемы недостаточной способности VLM понимать отрицание.

Модели визуального языка (VLM) играют решающую роль в мультимодальных задачах, таких как поиск изображений, описание изображений и медицинская диагностика. Цель этих моделей — согласовать визуальные данные с лингвистическими данными, чтобы обеспечить более эффективную обработку информации. Однако современные VLM по-прежнему сталкиваются с серьезными проблемами в понимании отрицания.

Отрицание имеет решающее значение во многих приложениях, например, для различения «комнаты без окон» и «комнаты с окнами». Несмотря на значительный прогресс в VLM, эффективность существующих моделей значительно падает при работе с негативными утверждениями. Это ограничение особенно важно в областях повышенного риска, таких как наблюдение за безопасностью и здравоохранение.

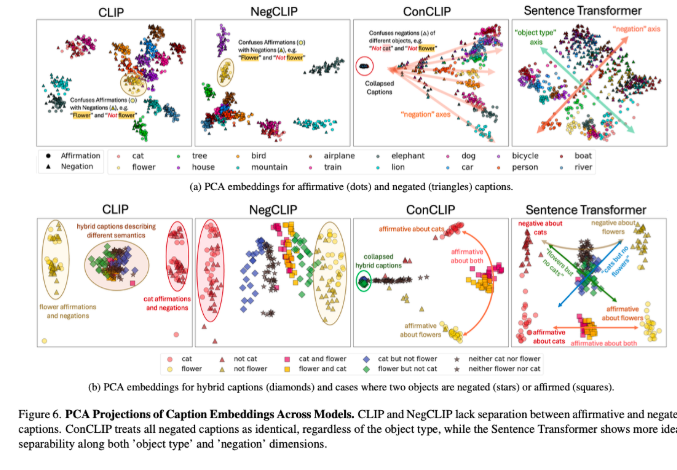

Существующие VLM, такие как CLIP, используют общее пространство встраивания для согласования визуальных и текстовых представлений. Хотя эти модели хорошо справляются с такими задачами, как кросс-модальный поиск и создание подписей к изображениям, они терпят неудачу при работе с отрицательными предложениями. Корень этой проблемы — предвзятость данных перед обучением, которые состоят в основном из положительных примеров, из-за чего модель рассматривает отрицательные и положительные утверждения как синонимы. Поэтому существующие тесты, такие как CREPE и CC-Neg, используют простые шаблонные примеры, которые не могут по-настоящему отразить богатство и глубину отрицания на естественном языке. Из-за этого VLM сталкиваются с огромными проблемами при выполнении приложений, требующих точного понимания языка, таких как запрос сложных условий в базах данных медицинских изображений.

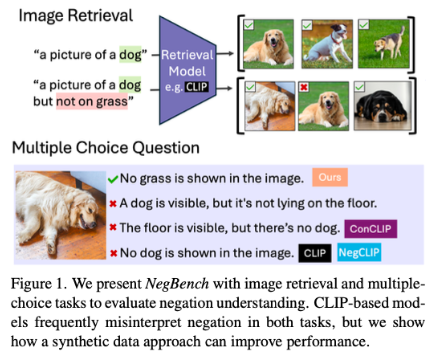

Чтобы решить эти проблемы, исследователи из Массачусетского технологического института, Google DeepMind и Оксфордского университета предложили систему NegBench для оценки и улучшения способности VLM понимать отрицание. Платформа оценивает две основные задачи: поиск и отрицание (Retrival-Neg), который проверяет способность модели извлекать изображения на основе положительных и отрицательных описаний, и вопросы с множественным выбором и отрицание (MCQ-Neg), который оценивает производительность модели на тонком уровне; понимание. NegBench использует большие синтетические наборы данных, такие как CC12M-NegCap и CC12M-NegMCQ, содержащие миллионы наименований, охватывающих богатые негативные сценарии, для улучшения обучения и оценки моделей.

Объединив реальные и синтетические наборы данных, NegBench эффективно преодолевает ограничения существующих моделей и значительно повышает производительность модели и возможности обобщения. Точная настройка модели показала значительные улучшения как в задачах поиска, так и в задачах понимания, особенно при работе с негативными запросами, где запоминаемость модели увеличилась на 10%. В заданиях с несколькими вариантами ответов точность повысилась на целых 40 %, что свидетельствует о значительно улучшенной способности различать тонкие положительные и отрицательные заголовки.

Предложение NegBench заполняет ключевой пробел VLM в понимании отрицания и открывает путь к созданию более мощных систем искусственного интеллекта, что особенно важно в таких ключевых областях, как медицинская диагностика и поиск семантического контента.

Статья: https://arxiv.org/abs/2501.09425.

Код: https://github.com/m1k2zoo/negbench

Выделять:

Исследователи показывают, что недостатки моделей визуального языка в понимании отрицания обусловлены главным образом предвзятостью в обучающих данных.

Платформа NegBench значительно повышает производительность модели при выполнении задач поиска и понимания за счет введения богатых отрицательных примеров.

Когда точно настроенная модель обрабатывает отрицательные запросы, точность и скорость отзыва значительно улучшаются, что способствует развитию систем искусственного интеллекта.

Появление структуры NegBench обеспечивает эффективное решение проблемы моделей визуального языка в понимании отрицания. Это имеет большое значение для повышения производительности моделей и содействия развитию искусственного интеллекта и заслуживает дальнейших исследований и применения.