[หน้ากระดาษ] [กระดาษ] [Supp เสื่อ.]

ใบอนุญาตลิขสิทธิ์ซอฟต์แวร์เพื่อ วัตถุประสงค์ในการวิจัยทางวิทยาศาสตร์ที่ไม่ใช่เชิงพาณิชย์ โปรดอ่านข้อกำหนดและเงื่อนไขและเอกสารประกอบใด ๆ ก่อนที่คุณจะดาวน์โหลดและ/หรือใช้โมเดล SMPL-X/SMPLIFY-X ข้อมูลและซอฟต์แวร์ ("รุ่นและซอฟต์แวร์") รวมถึง 3D Meshes, การผสมผสานน้ำหนักผสม พื้นผิวซอฟต์แวร์สคริปต์และภาพเคลื่อนไหว โดยการดาวน์โหลดและ/หรือใช้โมเดลและซอฟต์แวร์ (รวมถึงการดาวน์โหลดการโคลนนิ่งการติดตั้งและการใช้งานอื่น ๆ ของที่เก็บ GitHub นี้) คุณรับทราบว่าคุณได้อ่านข้อกำหนดและเงื่อนไขเหล่านี้เข้าใจและตกลงที่จะผูกพันกับพวกเขา หากคุณไม่เห็นด้วยกับข้อกำหนดและเงื่อนไขเหล่านี้คุณจะต้องไม่ดาวน์โหลดและ/หรือใช้โมเดลและซอฟต์แวร์ การละเมิดข้อกำหนดของข้อตกลงนี้จะยกเลิกสิทธิ์ของคุณโดยอัตโนมัติภายใต้ใบอนุญาตนี้

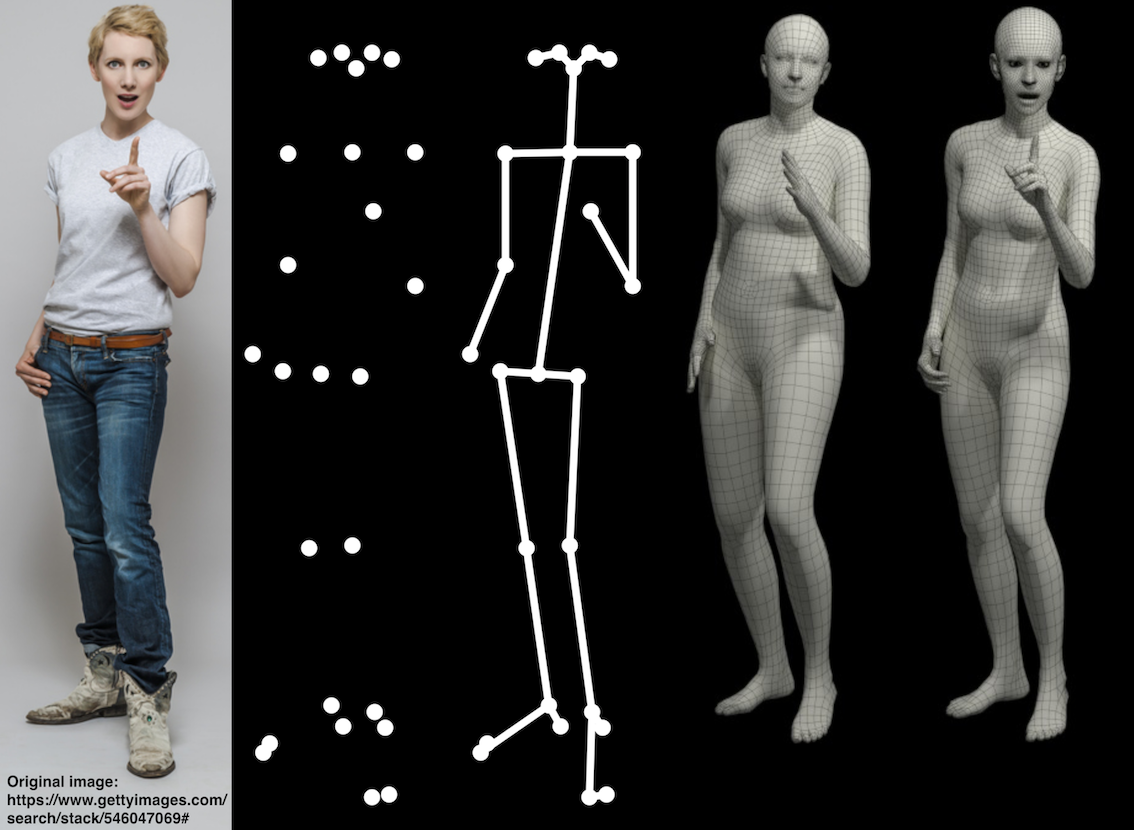

ภาพต้นฉบับที่ใช้สำหรับรูปที่ 1 และ 2 ของกระดาษสามารถพบได้ในลิงค์นี้ ภาพในกระดาษใช้ภายใต้ใบอนุญาตจาก getTyimages.com เราได้รับสิทธิ์ที่จะใช้ในสิ่งพิมพ์ แต่ไม่อนุญาตให้แจกจ่ายซ้ำ โปรดทำตามคำแนะนำในลิงค์ที่กำหนดเพื่อรับการใช้งานที่ถูกต้อง ผลลัพธ์ของเราได้รับจากความละเอียด 483 × 724 พิกเซลของภาพต้นฉบับ

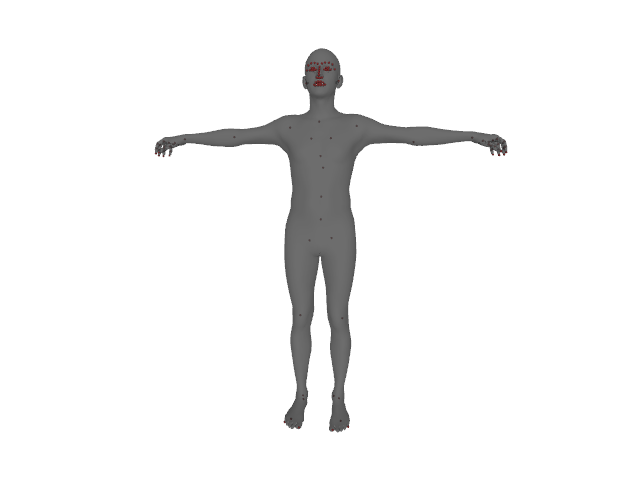

SMPL-X (SMPL Expressive) เป็นแบบจำลองร่างกายที่มีพารามิเตอร์รูปร่างที่ได้รับการฝึกฝนร่วมกันสำหรับใบหน้ามือและร่างกาย SMPL-X ใช้การผสมผสานเชิงเส้นตรงตามมาตรฐานด้วยรูปทรงผสมผสานการผสมผสานที่เรียนรู้มี N = 10, 475 จุดยอดและข้อต่อ K = 54 ซึ่งรวมถึงข้อต่อสำหรับคอขากรรไกรลูกตาและนิ้วมือ SMPL-X ถูกกำหนดโดยฟังก์ชัน M (θ, β, ψ) โดยที่θคือพารามิเตอร์ท่าโพสต์พารามิเตอร์รูปร่างและพารามิเตอร์การแสดงออกทางสีหน้า

ในการติดตั้งรุ่นโปรดทำตามขั้นตอนถัดไปในลำดับที่ระบุ:

pip install smplx[all]git clone https://github.com/vchoutas/smplx

python setup.py installหากต้องการดาวน์โหลดรุ่น SMPL-X ไปที่เว็บไซต์โครงการนี้และลงทะเบียนเพื่อรับการเข้าถึงส่วนการดาวน์โหลด

หากต้องการดาวน์โหลดโมเดล SMPL+H ไปที่เว็บไซต์โครงการนี้และลงทะเบียนเพื่อเข้าถึงส่วนการดาวน์โหลด

ในการดาวน์โหลดโมเดล SMPL ให้ไปที่เว็บไซต์ (รุ่นชายและหญิง) และเว็บไซต์โครงการ (โมเดลที่เป็นกลางทางเพศ) นี้และลงทะเบียนเพื่อเข้าถึงส่วนการดาวน์โหลด

ตัวโหลดให้ตัวเลือกในการใช้รุ่น SMPL-X, SMPL+H, SMPL และ MANO ขึ้นอยู่กับรุ่นที่คุณต้องการใช้โปรดทำตามคำแนะนำในการดาวน์โหลดที่เกี่ยวข้อง หากต้องการสลับระหว่าง Mano, SMPL, SMPL+H และ SMPL-X เพียงเปลี่ยนพารามิเตอร์ model_path หรือ model_type สำหรับรายละเอียดเพิ่มเติมโปรดตรวจสอบเอกสารของคลาสโมเดล ก่อนที่จะใช้ SMPL และ SMPL+H คุณควรทำตามคำแนะนำในเครื่องมือ/readme.md เพื่อลบวัตถุที่มีรสชาติออกจาก PKL ทั้งสองรุ่นรวมถึงรวมพารามิเตอร์ MANO ด้วย SMPL+H

คุณสามารถใช้ฟังก์ชั่นสร้างจาก Body_Models หรือเรียกตัวสร้างโดยตรงสำหรับรุ่น SMPL, SMPL+H และ SMPL-X พา ธ ไปยังโมเดลอาจเป็นพา ธ ไปยังไฟล์ที่มีพารามิเตอร์หรือไดเรกทอรีที่มีโครงสร้างต่อไปนี้:

models

├── smpl

│ ├── SMPL_FEMALE.pkl

│ └── SMPL_MALE.pkl

│ └── SMPL_NEUTRAL.pkl

├── smplh

│ ├── SMPLH_FEMALE.pkl

│ └── SMPLH_MALE.pkl

├── mano

| ├── MANO_RIGHT.pkl

| └── MANO_LEFT.pkl

└── smplx

├── SMPLX_FEMALE.npz

├── SMPLX_FEMALE.pkl

├── SMPLX_MALE.npz

├── SMPLX_MALE.pkl

├── SMPLX_NEUTRAL.npz

└── SMPLX_NEUTRAL.pklการโต้ตอบ Vertex ระหว่าง SMPL-X และ Mano สามารถดาวน์โหลดเปลวไฟได้จากเว็บไซต์โครงการ หากคุณได้แยกข้อมูลการติดต่อใน การติดต่อ โฟลเดอร์ให้ใช้สคริปต์ต่อไปนี้เพื่อให้เห็นภาพ:

python examples/vis_mano_vertices.py --model-folder $SMPLX_FOLDER --corr-fname correspondences/MANO_SMPLX_vertex_ids.pkl

python examples/vis_flame_vertices.py --model-folder $SMPLX_FOLDER --corr-fname correspondences/SMPL-X__FLAME_vertex_ids.npy

หลังจากติดตั้งแพ็คเกจ SMPLX และดาวน์โหลดพารามิเตอร์รุ่นคุณควรจะสามารถเรียกใช้สคริปต์ demo.py เพื่อให้เห็นภาพผลลัพธ์ สำหรับขั้นตอนนี้คุณต้องติดตั้งแพ็คเกจ Pyrender และ Trimesh

python examples/demo.py --model-folder $SMPLX_FOLDER --plot-joints=True --gender="neutral"

หากคุณต้องการปรับเปลี่ยนท่าทางทั่วโลกของแบบจำลองเช่นการหมุนรูทและการแปลเป็นระบบพิกัดใหม่เช่นคุณต้องคำนึงถึงการหมุนของแบบจำลองใช้กระดูกเชิงกรานเป็นศูนย์กลางของการหมุน คำอธิบายโดยละเอียดเพิ่มเติมสามารถพบได้ในลิงค์ต่อไปนี้ หากสิ่งที่ไม่ชัดเจนโปรดแจ้งให้เราทราบเพื่อให้ฉันสามารถอัปเดตคำอธิบายได้

ขึ้นอยู่กับรุ่นที่โหลดสำหรับโครงการของคุณเช่น SMPL-X หรือ SMPL+H หรือ SMPL โปรดอ้างอิงงานที่เกี่ยวข้องมากที่สุดด้านล่างแสดงอยู่ในลำดับเดียวกัน:

@inproceedings{SMPL-X:2019,

title = {Expressive Body Capture: 3D Hands, Face, and Body from a Single Image},

author = {Pavlakos, Georgios and Choutas, Vasileios and Ghorbani, Nima and Bolkart, Timo and Osman, Ahmed A. A. and Tzionas, Dimitrios and Black, Michael J.},

booktitle = {Proceedings IEEE Conf. on Computer Vision and Pattern Recognition (CVPR)},

year = {2019}

}

@article{MANO:SIGGRAPHASIA:2017,

title = {Embodied Hands: Modeling and Capturing Hands and Bodies Together},

author = {Romero, Javier and Tzionas, Dimitrios and Black, Michael J.},

journal = {ACM Transactions on Graphics, (Proc. SIGGRAPH Asia)},

volume = {36},

number = {6},

series = {245:1--245:17},

month = nov,

year = {2017},

month_numeric = {11}

}

@article{SMPL:2015,

author = {Loper, Matthew and Mahmood, Naureen and Romero, Javier and Pons-Moll, Gerard and Black, Michael J.},

title = {{SMPL}: A Skinned Multi-Person Linear Model},

journal = {ACM Transactions on Graphics, (Proc. SIGGRAPH Asia)},

month = oct,

number = {6},

pages = {248:1--248:16},

publisher = {ACM},

volume = {34},

year = {2015}

}

พื้นที่เก็บข้อมูลนี้ได้รับการพัฒนาสำหรับ SMPL-X/SMPLIFY-X (CVPR 2019) คุณอาจสนใจที่จะดู: https://smpl-x.is.tue.mpg.de

ขอขอบคุณเป็นพิเศษสำหรับ Soubhik Sanyal สำหรับการแบ่งปันรหัส Tensorflow ที่ใช้สำหรับสถานที่สำคัญบนใบหน้า

รหัสของที่เก็บนี้ถูกนำไปใช้โดย Vassilis choutas

สำหรับคำถามกรุณาติดต่อ [email protected]

สำหรับการออกใบอนุญาตเชิงพาณิชย์ (และคำถามที่เกี่ยวข้องทั้งหมดสำหรับแอปพลิเคชันธุรกิจ) โปรดติดต่อ [email protected]