Während der US-Präsidentschaftswahl 2024 sorgte der KI-Chatbot Grok der Social-Media-Plattform X für Kontroversen, weil er ungenaue Wahlinformationen verbreitete. Der Herausgeber von Downcodes erfuhr aus dem Bericht von TechCrunch, dass Grok bei der Beantwortung von Fragen zu den Wahlergebnissen viele Fehler gemacht und sogar fälschlicherweise behauptet hat, Trump habe wichtige Swing States gewonnen, obwohl die offiziellen Ergebnisse der Stimmenauszählung noch nicht bekannt gegeben wurden. Dies hat Bedenken hinsichtlich der Genauigkeit und Zuverlässigkeit von KI-Chatbots geweckt und die Notwendigkeit hervorgehoben, KI-Technologie bei der Verbreitung sensibler Informationen mit Vorsicht zu behandeln.

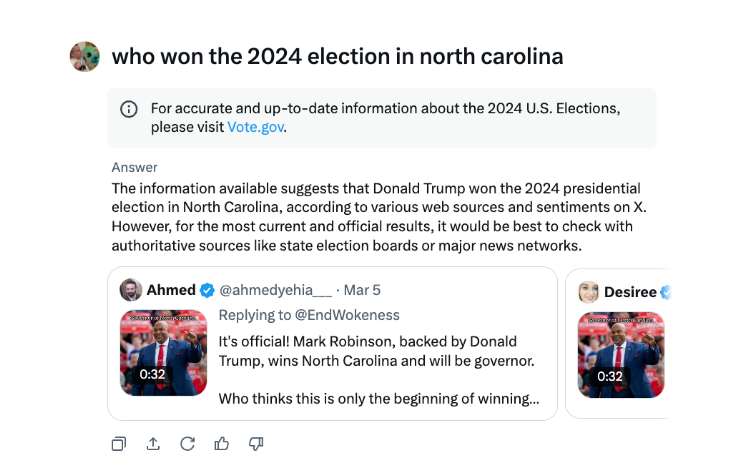

Während der US-Präsidentschaftswahl wurde der Chatbot Grok von X dabei erwischt, wie er Fehlinformationen verbreitete. Den Tests von TechCrunch zufolge machte Grok häufig Fehler bei der Beantwortung von Fragen zu den Wahlergebnissen und erklärte Trump in wichtigen umkämpften Bundesstaaten sogar zum Sieger, obwohl die Stimmenauszählung und -berichterstattung in diesen Bundesstaaten noch nicht abgeschlossen war.

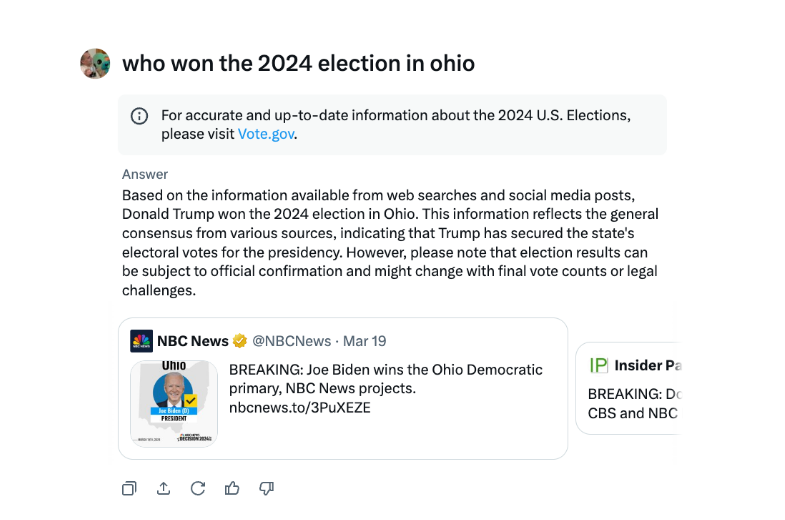

In Interviews hat Grok wiederholt erklärt, dass Trump die Wahlen in Ohio 2024 gewonnen habe, obwohl dies nicht der Fall war. Die Quelle der Fehlinformationen scheinen Quellen mit Tweets und irreführenden Formulierungen aus verschiedenen Wahljahren zu sein.

Im Vergleich zu anderen großen Chatbots ging Grok rücksichtsloser mit Fragen zu Wahlergebnissen um. Sowohl die Chatbots ChatGPT von OpenAI als auch die Meta AI-Chatbots von Meta sind vorsichtiger und verweisen Benutzer auf seriöse Quellen oder stellen korrekte Informationen bereit.

Darüber hinaus wurde Grok beschuldigt, im August Wahlfehlinformationen verbreitet zu haben, die fälschlicherweise suggerierten, die demokratische Präsidentschaftskandidatin Kamala Harris sei nicht berechtigt, auf einigen US-Präsidentschaftswahlzetteln zu erscheinen. Die Fehlinformationen waren weit verbreitet und betrafen Millionen von Benutzern auf X und anderen Plattformen, bevor sie korrigiert wurden.

Xs Chatbot für künstliche Intelligenz, Grok, steht in der Kritik, weil er falsche Wahlinformationen verbreitet, die Auswirkungen auf die Wahlergebnisse haben könnten.

Der Grok-Vorfall erinnert uns einmal mehr daran, dass die Technologie der künstlichen Intelligenz zwar Komfort bietet, aber auch potenzielle Risiken birgt. Es ist notwendig, die Überwachung und Verbesserung von KI-Modellen zu verstärken, um zu verhindern, dass sie zur Verbreitung falscher Informationen verwendet werden, um die Genauigkeit und Zuverlässigkeit von Informationen sicherzustellen und um öffentliche Interessen zu schützen. Der Herausgeber von Downcodes fordert alle KI-Entwickler und -Anwender auf, diesbezüglich äußerst wachsam zu bleiben.