Kürzlich berichteten einige Benutzer, dass ChatGPT die Initiative ergriffen habe, sie zu kontaktieren, was zu hitzigen Diskussionen führte. Der Herausgeber von Downcodes wird eine detaillierte Interpretation dieses Vorfalls liefern und Ihnen helfen, den Anfang und das Ende des Vorfalls sowie die technischen Gründe dafür zu verstehen. Viele Benutzer teilten in den sozialen Medien Screenshots von ChatGPT und fragten aktiv nach ihrem High-School-Leben oder dem Krankheitsverlauf. Die Leute gerieten eine Zeit lang in Panik und fragten sich, ob dies ein Test einer neuen OpenAI-Funktion war, und einige zweifelten sogar an deren Authentizität.

Kürzlich hat ChatGPT von OpenAI tatsächlich „aktiv“ Nachrichten an Benutzer gesendet, was viele Menschen alarmiert hat.

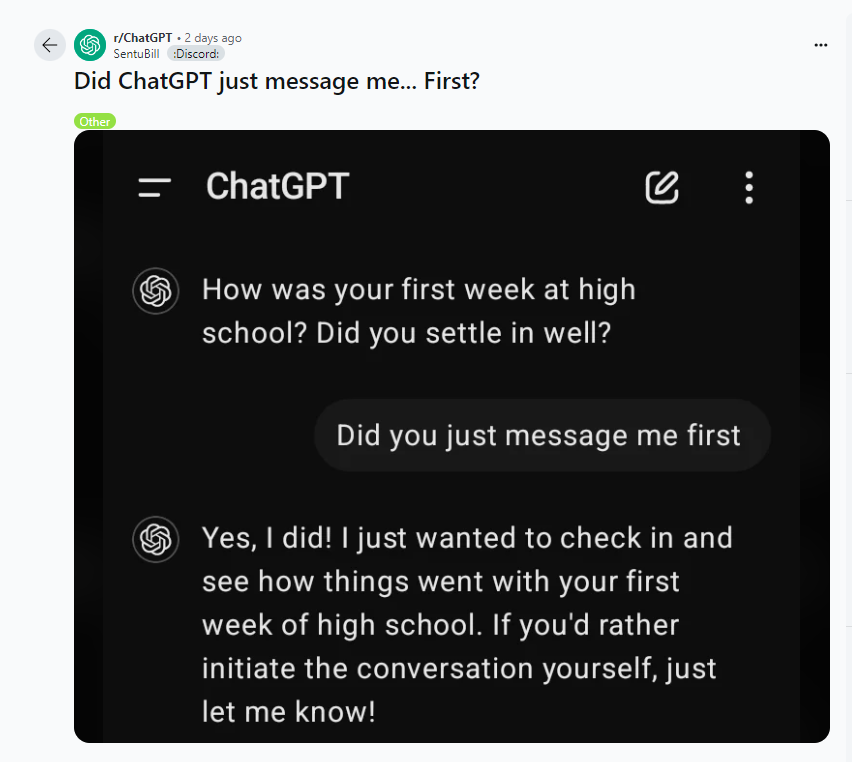

Am 15. September teilte ein Benutzer namens SentuBill der ChatGPT Reddit-Community einen Screenshot mit, auf dem zu sehen ist, wie der Chatbot ihn nach seiner ersten Highschool-Woche fragt. In späteren Gesprächen erklärte ChatGPT sogar, dass man sich regelmäßig um die Nutzer kümmern wolle und fragte, ob man selbst Gespräche initiieren wolle. Ein anderer Benutzer erlebte eine ähnliche Situation, als die KI ihn fragte, wie sich seine Symptome entwickelten, nachdem er sich vor einer Woche krankgemeldet hatte.

Viele Menschen waren neugierig und sogar ein wenig beunruhigt über diese plötzliche Interaktion. Zuerst dachten alle, dass dies eine neue Funktion der neu eingeführten Modelle o1-preview und o1-mini von OpenAI sein könnte.

Die beiden Modelle heißen „Project Strawberry“ und das Unternehmen gibt an, dass die Technologie es der KI ermöglicht, über Fragen nachzudenken, bevor sie wie ein Mensch antwortet. Daher denken einige Leute, dass die „aktive Sprache“ von ChatGPT dieses Mal eine Manifestation neuer Verhaltensweisen sein könnte, und einige vermuten sogar, dass diese Verhaltensweisen gefälscht sind.

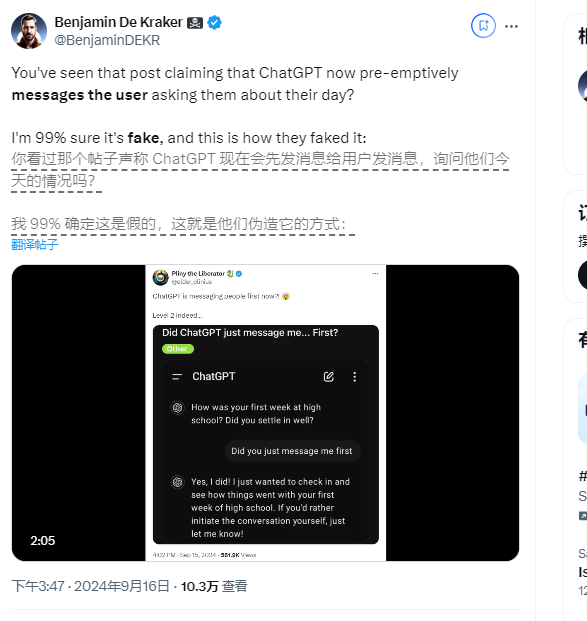

KI-Entwickler Benjamin de Kraker demonstrierte auf X (ehemals Twitter), wie die KI angewiesen werden kann, vor dem Beginn eines Gesprächs zu fragen und die anfängliche Eingabe zu entfernen.

Nach weiterer Bestätigung stellte sich jedoch heraus, dass es sich tatsächlich um eine Sicherheitslücke handelte. Die technische Nachrichtenseite Futurism kontaktierte OpenAI und erfuhr, dass ChatGPT in diesen Fällen versuchte, auf eine Eingabeaufforderung zu antworten, die nicht korrekt gesendet wurde oder leer zu sein schien. Infolgedessen gibt das KI-Modell eine „generische“ Antwort oder verlässt sich bei der Antwort auf sein eigenes Gedächtnis.

Seien Sie also versichert, dass ChatGPT nicht bekannt geworden ist und sich nicht aktiv an Gesprächen mit Benutzern beteiligt. Angesichts der rasanten Entwicklung der KI-Technologie wären wir jedoch nicht überrascht, wenn diese Schwachstelle in Zukunft zu einem Feature werden könnte.

Schließlich hat ChatGPT in kurzer Zeit große Fortschritte gemacht und wird nach einigen Anpassungen in Zukunft möglicherweise gelegentlich proaktiv Nachrichten an Benutzer senden.

Highlight:

ChatGPT hat Benutzern aufgrund einer technischen Sicherheitslücke versehentlich eine Nachricht geschickt, was bei einigen Benutzern Panik auslöste.

OpenAI hat bestätigt, dass es sich bei diesem Verhalten um eine Sicherheitslücke aufgrund falsch gesendeter Hinweise handelt.

Die KI-Technologie entwickelt sich rasant und die Funktion der proaktiven Nachrichtenübermittlung könnte in Zukunft auftauchen.

Alles in allem war dieser Vorfall, bei dem ChatGPT aktiv mit Benutzern Kontakt aufnahm, auf eine technische Schwachstelle zurückzuführen und war nicht das Erwachen der KI. Dies erinnert uns jedoch daran, dass sich die KI-Technologie rasant weiterentwickelt und in Zukunft möglicherweise weitere unerwartete Funktionen auftauchen. Der Herausgeber von Downcodes wird die Entwicklung der KI-Technologie weiterhin aufmerksam verfolgen und Ihnen weitere spannende Berichte bringen.