Im Zeitalter der Informationsexplosion ist es entscheidend, Textinformationen effizient in Bildern zu verarbeiten. Der Herausgeber von Downcodes wird heute ein revolutionäres OCR-Modell vorstellen – GOT (General Optical Character Recognition Theory), das den Eintritt der OCR-Technologie in die 2.0-Ära markiert. Das GOT-Modell vereint die Vorteile traditioneller OCR-Modelle und großer Sprachmodelle und bringt mit seiner leistungsstarken Leistung und Vielseitigkeit neue Durchbrüche auf dem Gebiet der Texterkennung. Es kann nicht nur englische und chinesische Dokumente und Szenentexte erkennen, sondern auch komplexe Informationen wie mathematische und chemische Formeln, Musiksymbole, Diagramme usw. verarbeiten. Man kann es als „Allround-Player“ im Bereich OCR bezeichnen.

Im digitalen Zeitalter ist die schnelle Umwandlung von Textinhalten in Bildern in bearbeitbaren Text eine häufige und wichtige Anforderung. Nun markiert die Einführung eines neuen OCR-Modells (Optical Character Recognition) namens GOT (General Optical Character Recognition Theory) den Eintritt der OCR-Technologie in die Ära 2.0. Dieses innovative Modell kombiniert die Vorteile traditioneller OCR-Systeme und umfangreicher Sprachmodelle, um ein effizienteres und intelligenteres Texterkennungstool zu schaffen.

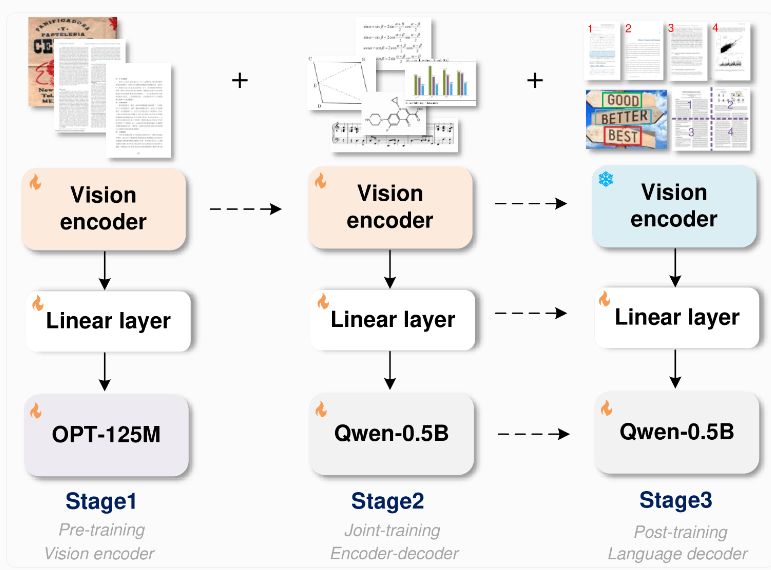

Das GOT-Modell verwendet eine innovative End-to-End-Architektur. Dieses Design spart nicht nur Ressourcen, sondern erweitert auch die Erkennungsmöglichkeiten erheblich über die Texterkennung hinaus. Das Modell besteht aus einem Bildencoder mit ca. 80 Millionen Parametern und einem Decoder mit ca. 5 Millionen Parametern. Der Bildencoder ist in der Lage, Bilder mit einer Größe von bis zu 1024 x 1024 Pixeln in Dateneinheiten zu komprimieren, während der Decoder diese Daten in Text mit einer Länge von bis zu 8000 Zeichen umwandelt.

Die Stärke von GOT liegt in seiner Vielseitigkeit. Es kann nicht nur englische und chinesische Dokumente und Szenentexte erkennen und konvertieren, sondern auch mathematische und chemische Formeln, Musiksymbole, einfache geometrische Figuren und verschiedene Diagramme verarbeiten. Das macht GOT zu einem wahren Allrounder.

Um dieses Modell zu trainieren, konzentrierte sich das Forschungsteam zunächst auf Texterkennungsaufgaben, verwendete dann Alibabas Qwen-0.5B als Decoder und verfeinerte es mit einer Vielzahl synthetischer Daten. Sie verwendeten professionelle Rendering-Tools wie LaTeX, Mathpix-markdown-it und Matplotlib, um Millionen von Bild-Text-Paaren für das Modelltraining zu generieren.

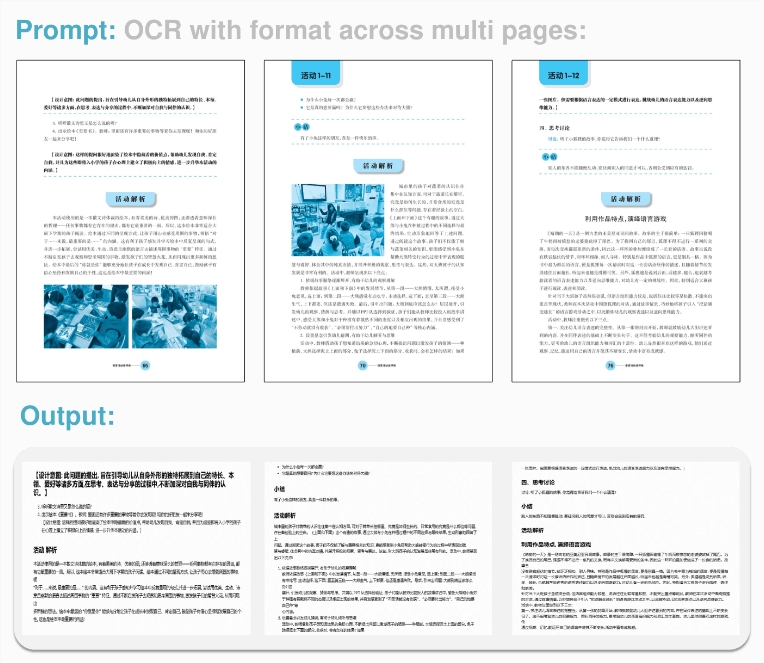

Ein weiteres Highlight der OCR2.0-Technologie ist ihre Fähigkeit, formatierten Text, Titel und sogar mehrseitige Bilder zu extrahieren und in ein strukturiertes digitales Format umzuwandeln. Dies eröffnet neue Möglichkeiten der automatisierten Verarbeitung und Analyse in Bereichen wie Wissenschaft, Musik und Datenanalyse.

In Tests verschiedener OCR-Aufgaben hat GOT eine hervorragende Leistung gezeigt, branchenführende Ergebnisse bei der Dokument- und Szenentexterkennung erzielt und sogar viele professionelle Modelle und große Sprachmodelle bei der Diagrammerkennung übertroffen. Ganz gleich, ob es sich um komplexe chemische Strukturformeln oder um Musiknotation und Datenvisualisierung handelt, OCR2.0 kann diese präzise erfassen und in maschinenlesbare Formate umwandeln.

Damit mehr Benutzer diese Technologie erleben und nutzen können, veröffentlichte das Forschungsteam kostenlose Demos und Codes auf der Hugging Face-Plattform. Die Einführung von OCR2.0 hat zweifellos eine Revolution im Bereich der Informationsverarbeitung mit sich gebracht. Es verbessert nicht nur die Effizienz, sondern erhöht auch die Flexibilität, sodass wir Textinformationen einfacher in Bildern verarbeiten können.

Das Aufkommen des GOT-Modells hat der OCR-Technologie zweifellos neue Dynamik verliehen. Seine effizienten, genauen und vielseitigen Funktionen werden in allen Lebensbereichen weit verbreitet sein und die Arbeit und das Leben der Menschen komfortabler machen. Wir freuen uns darauf, das GOT-Modell in Zukunft weiter zu verbessern und uns weitere Überraschungen zu bereiten!