Das Meta FAIR-Team veröffentlichte ein neues Transformer-Modell, Dualformer, das menschliche duale kognitive Systeme (System 1 und System 2) simuliert und erhebliche Verbesserungen der Denkfähigkeiten und der Recheneffizienz erzielt. Im Gegensatz zu herkömmlichen Transformer-Modellen, die nur System 1 oder System 2 simulieren, kann Dualformer flexibel zwischen schnellen und langsamen Argumentationsmodi wechseln, um sich an die Komplexität verschiedener Aufgaben anzupassen. Diese Innovation ist auf die einzigartige Trainingsmethode zurückzuführen, bei der zufällige Denkverläufe für das Training verwendet und verschiedene Teile der Verläufe nach dem Zufallsprinzip verworfen werden, um Abkürzungen im menschlichen Denkprozess zu simulieren.

Das FAIR-Team von Meta hat kürzlich ein neues Transformer-Modell namens Dualformer auf den Markt gebracht, das das menschliche duale kognitive System nachahmt und schnelle und langsame Denkmodi nahtlos integrieren kann, wodurch bedeutende Durchbrüche bei den Denkfähigkeiten und der Recheneffizienz erzielt werden.

Es wird allgemein angenommen, dass menschliche Denkprozesse von zwei Systemen gesteuert werden: System 1, das schnell und intuitiv ist, und System 2, das langsamer und logischer ist.

Herkömmliche Transformer-Modelle simulieren normalerweise nur System 1 oder System 2, was zu einem Modell führt, das entweder schnell ist, aber über schlechte Argumentationsfähigkeiten verfügt, oder über starke Argumentationsfähigkeiten verfügt, aber langsam ist und hohe Rechenkosten verursacht.

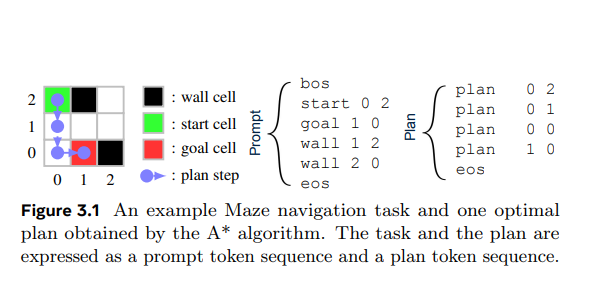

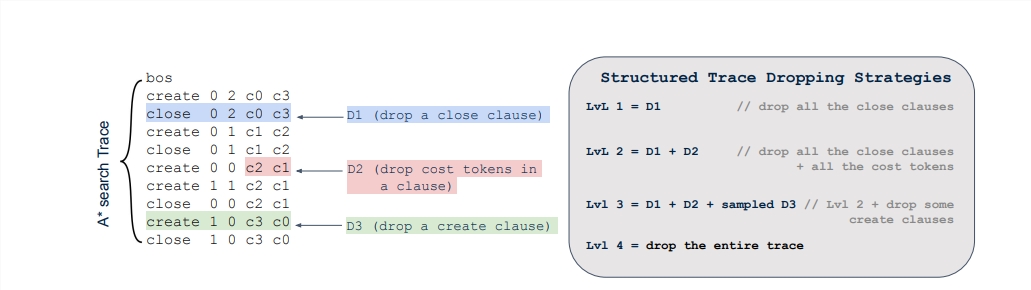

Das Innovative am Dualformer ist die Art und Weise, wie er trainiert wird. Die Forscher trainierten das Modell mithilfe zufälliger Inferenztrajektorien und verwarfen während des Trainings zufällig verschiedene Teile der Trajektorien, ähnlich wie bei der Analyse menschlicher Denkprozesse und der Erstellung von Abkürzungen. Diese Trainingsstrategie ermöglicht es Dualformer, während der Inferenz flexibel zwischen verschiedenen Modi zu wechseln:

Schnellmodus: Dualformer gibt nur die endgültige Lösung aus, die extrem schnell ist.

Langsamer Modus: Dualformer gibt eine vollständige Argumentationskette und eine endgültige Lösung mit stärkeren Argumentationsfunktionen aus.

Automatischer Modus: Dualformer kann je nach Komplexität der Aufgabe automatisch den geeigneten Modus auswählen.

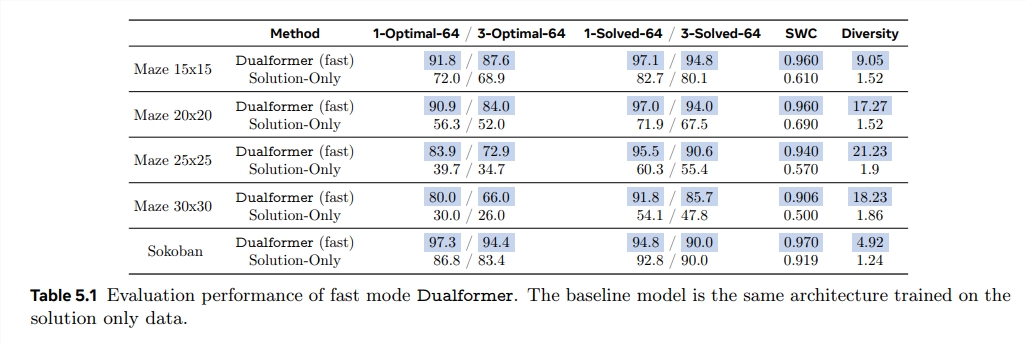

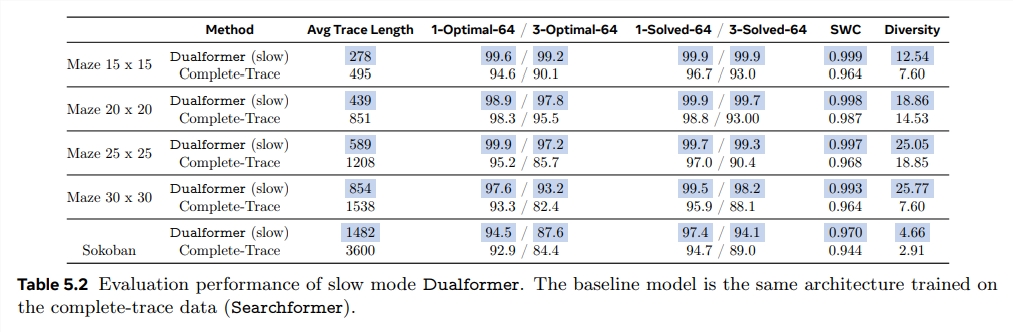

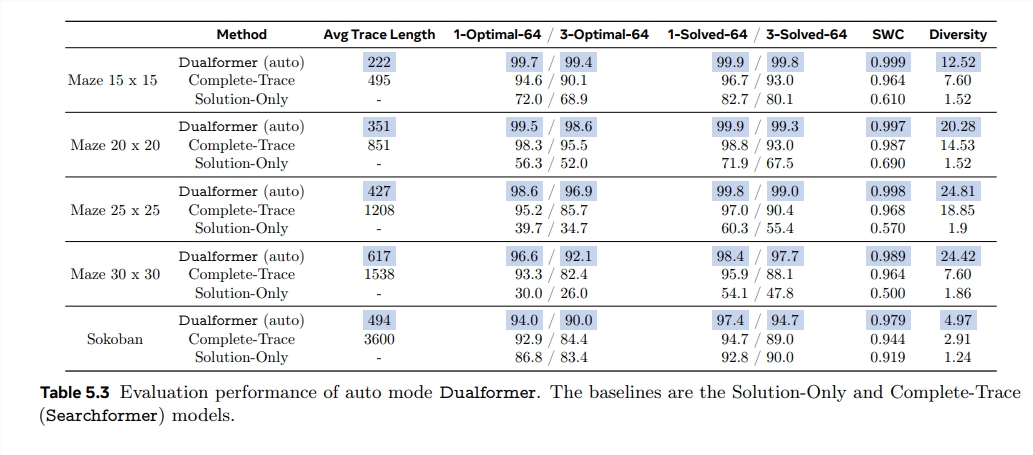

Experimentelle Ergebnisse zeigen, dass Dualformer bei Aufgaben wie Labyrinthnavigation und mathematischer Problemlösung gute Leistungen erbringt. Im langsamen Modus kann Dualformer die 30x30-Labyrinth-Navigationsaufgabe mit einer Erfolgsquote von 97,6 % lösen und übertrifft damit das Searchformer-Modell, das nur mit vollständigen Inferenztrajektorien trainiert wurde, während die Inferenzschritte um 45,5 % reduziert werden.

Im Schnellmodus beträgt die Erfolgsquote von Dualformer ebenfalls bis zu 80 %, was viel höher ist als beim Nur-Lösung-Modell, das nur mit der endgültigen Lösung trainiert wurde. Im automatischen Modus kann Dualformer die Inferenzschritte erheblich reduzieren und gleichzeitig eine hohe Erfolgsquote beibehalten.

Der Erfolg von Dualformer zeigt, dass die Anwendung der menschlichen kognitiven Theorie auf das Modelldesign mit künstlicher Intelligenz die Modellleistung effektiv verbessern kann. Dieses Modell der Integration von schnellem und langsamem Denken liefert neue Ideen für den Aufbau leistungsfähigerer und effizienterer KI-Systeme.

Papieradresse: https://arxiv.org/pdf/2410.09918

Der Herausgeber von Downcodes kam zu dem Schluss: „Das Aufkommen von Dualformer markiert einen großen Fortschritt bei der Gestaltung von Modellen der künstlichen Intelligenz, die den menschlichen Denkmustern näher kommen.“