Der Herausgeber von Downcodes führt Sie zu den neuesten Durchbrüchen von Metaforschern! Sie nutzten das Transformer-Modell, um ein seit langem ungelöstes Problem auf dem Gebiet dynamischer Systeme zu lösen – die Suche nach der globalen Lyapunov-Funktion. Diese Forschung demonstriert nicht nur die leistungsstarken Fähigkeiten großer Sprachmodelle für komplexe mathematische Überlegungen, sondern, was noch wichtiger ist, sie schlägt eine innovative Methode der „umgekehrten Generation“ vor, die das Problem unzureichender Trainingsdaten effektiv löst und den Weg für KI in der wissenschaftlichen Entdeckung ebnet . Anwendungen darin haben neue Wege eröffnet. Die Forschungsergebnisse wurden auf arXiv veröffentlicht und die Adresse des Artikels wurde angegeben.

Große Sprachmodelle leisten bei vielen Aufgaben gute Dienste, ihre Argumentationsfähigkeiten sind jedoch umstritten. Forscher von Meta haben kürzlich einen Artikel veröffentlicht, der zeigt, wie sie das Transformer-Modell verwenden, um ein seit langem bestehendes Problem in der Mathematik zu lösen: die Entdeckung der globalen Lyapunov-Funktion eines dynamischen Systems.

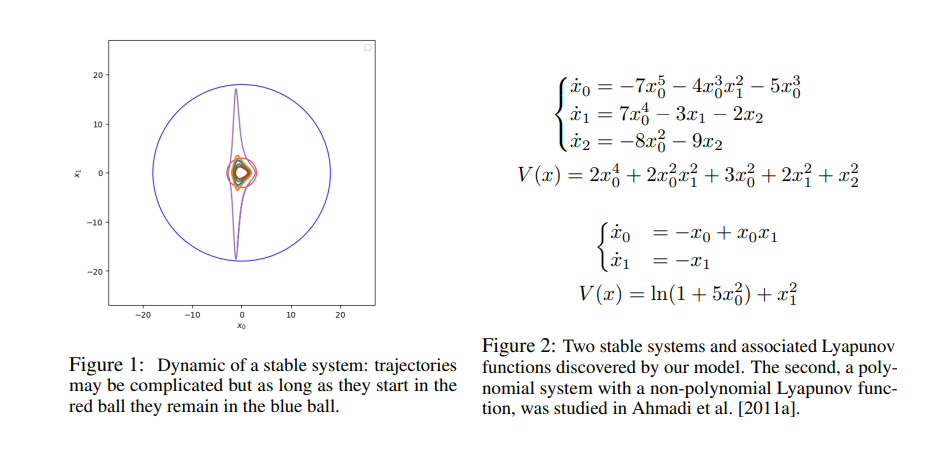

Die Lyapunov-Funktion kann beispielsweise zur Vorhersage der Langzeitstabilität des Dreikörperproblems, also der langfristigen Flugbahn von drei Himmelskörpern unter dem Einfluss der Schwerkraft, verwendet werden . Es wurde jedoch noch keine allgemeine Methode zur Ableitung der Ljapunow-Funktion gefunden, und die entsprechende Funktion ist nur für wenige Systeme bekannt.

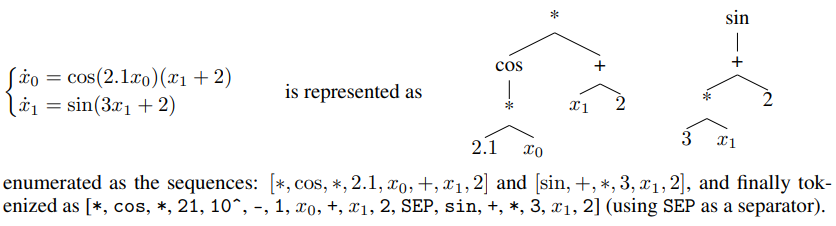

Um dieses Problem zu lösen, haben Forscher bei Meta ein Sequenz-zu-Sequenz-Transformer-Modell trainiert, um die Lyapunov-Funktion eines bestimmten Systems vorherzusagen. Sie verwendeten auf innovative Weise einen Ansatz der „inversen Generation“, um einen großen Trainingsdatensatz zu erstellen, der stabile dynamische Systeme und ihre entsprechenden Lyapunov-Funktionen enthält.

Die traditionelle Methode der „Vorwärtsgenerierung“ geht von einem zufällig generierten System aus und versucht, dessen Lyapunov-Funktion zu berechnen. Diese Methode ist ineffizient und kann nur bestimmte Arten einfacher Systeme verarbeiten. Die Methode der „umgekehrten Generation“ generiert zunächst zufällig Lyapunov-Funktionen und baut dann ein entsprechendes stabiles System auf, wodurch das Problem der Berechnung von Lyapunov-Funktionen umgangen und vielfältigere Trainingsdaten generiert werden.

Die Forscher fanden heraus, dass das auf dem Datensatz „Inverse Generation“ trainierte Transformer-Modell eine nahezu perfekte Genauigkeit beim Testsatz (99 %) erreichte und auch beim Testsatz außerhalb der Verteilung (73 %) eine gute Leistung erbrachte. Noch überraschender ist, dass durch das Hinzufügen einer kleinen Anzahl (300) einfacher Beispiele für „Vorwärtsgenerierung“ zum Trainingssatz die Genauigkeit des Modells weiter auf 84 % verbessert werden kann, was zeigt, dass dies auch bei einer kleinen Anzahl bekannter Lösungen der Fall ist Verbessern Sie die Genauigkeit des Modells erheblich.

Um die Fähigkeit des Modells zu testen, neue Lyapunov-Funktionen zu entdecken, generierten die Forscher Zehntausende Zufallssysteme und nutzten das Modell, um Vorhersagen zu treffen. Die Ergebnisse zeigen, dass das Modell beim Auffinden von Lyapunov-Funktionen auf Polynomsystemen zehnmal erfolgreicher ist als die modernsten Methoden und auch Lyapunov-Funktionen auf nicht-polynomialen Systemen finden kann, was kein aktueller Algorithmus kann wenig.

Die Forscher verglichen das Modell auch mit menschlichen Mathematikern. Sie luden 25 Mathematik-Masterstudenten ein, einen Test durchzuführen, und die Ergebnisse zeigten, dass die Genauigkeit des Modells viel höher war als die von Menschen.

Diese Forschung zeigt, dass Transformer-Modelle trainiert werden können, um komplexe mathematische Argumentationsprobleme zu lösen, und dass Methoden der „inversen Generation“ effektiv Trainingsdatensätze erstellen können, die die Einschränkungen traditioneller Methoden überwinden. In Zukunft planen die Forscher, diese Methode auf andere mathematische Probleme anzuwenden und weitere Möglichkeiten der KI in der wissenschaftlichen Entdeckung zu erkunden.

Papieradresse: https://arxiv.org/pdf/2410.08304

Insgesamt liefert die Forschung von Meta neue Ideen und Methoden für die KI zur Lösung komplexer wissenschaftlicher Probleme und deutet auch darauf hin, dass KI im Bereich der wissenschaftlichen Forschung eine immer wichtigere Rolle spielen wird. Der Herausgeber von Downcodes wird weiterhin die neuesten Entwicklungen im Bereich KI im Auge behalten und den Lesern weitere spannende Berichte bringen!