Mit der rasanten Entwicklung der AIGC-Technologie kommt es immer häufiger zu Bildmanipulationen. Die traditionelle Methode zur Erkennung und Lokalisierung von Bildmanipulationen (IFDL) steht vor der Herausforderung der „Black-Box“-Natur und der unzureichenden Generalisierungsfähigkeit. Der Herausgeber von Downcodes erfuhr, dass ein Forschungsteam der Universität Peking ein multimodales Framework namens FakeShield vorgeschlagen hat, das darauf abzielt, diese Probleme zu lösen. FakeShield nutzt geschickt die leistungsstarken Funktionen großer Sprachmodelle (LLM), insbesondere multimodaler großer Sprachmodelle (M-LLM), durch den Aufbau eines multimodalen Manipulationsbeschreibungsdatensatzes (MMTD-Set) und die Feinabstimmung des Modells, um eine effektive Erkennung zu erreichen und lokalisiert verschiedene Manipulationstechniken und liefert interpretierbare Analyseergebnisse.

Mit der rasanten Entwicklung der AIGC-Technologie sind Bildbearbeitungswerkzeuge immer leistungsfähiger geworden, wodurch Bildmanipulationen einfacher und schwieriger zu erkennen sind. Obwohl bestehende Bildmanipulationserkennungs- und -lokalisierungsmethoden (IFDL) im Allgemeinen wirksam sind, stehen sie häufig vor zwei großen Herausforderungen: erstens der „Black-Box“-Charakter und unklaren Erkennungsprinzipien, zweitens begrenzte Generalisierungsfähigkeit und Schwierigkeiten beim Umgang mit mehreren Manipulationsmethoden (z. B wie Photoshop, DeepFake, AIGC-Bearbeitung).

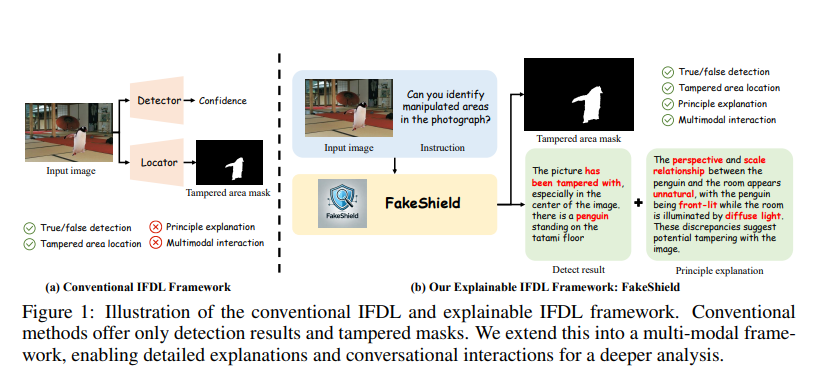

Um diese Probleme zu lösen, schlug das Forschungsteam der Universität Peking die interpretierbare IFDL-Aufgabe vor und entwarf FakeShield, ein multimodales Framework, das in der Lage ist, die Authentizität von Bildern zu bewerten, manipulierte Bereichsmasken zu generieren und auf der Grundlage von Manipulationshinweisen auf Pixel- und Bildebene Hinweise zu liefern Grundlage für die Beurteilung.

Die herkömmliche IFDL-Methode kann nur die Authentizitätswahrscheinlichkeit und den Manipulationsbereich des Bildes liefern, aber das Erkennungsprinzip nicht erklären. Aufgrund der begrenzten Genauigkeit bestehender IFDL-Methoden ist weiterhin eine manuelle anschließende Beurteilung erforderlich. Da die von der IFDL-Methode bereitgestellten Informationen jedoch nicht ausreichen, um eine manuelle Auswertung zu unterstützen, müssen Benutzer verdächtige Bilder dennoch selbst erneut analysieren.

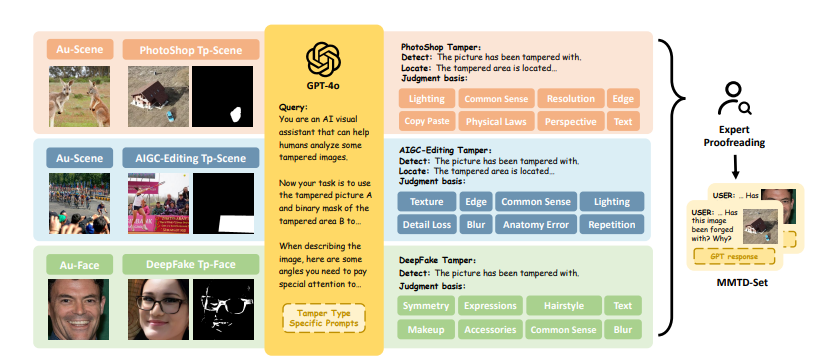

Darüber hinaus gibt es in realen Szenarien verschiedene Arten von Manipulationen, darunter Photoshop (Kopieren, Verschieben, Spleißen und Entfernen), AIGC-Bearbeitung, DeepFake usw. Bestehende IFDL-Methoden beherrschen meist nur eine der Techniken und verfügen nicht über umfassende Generalisierungsfähigkeiten. Dies zwingt Benutzer dazu, verschiedene Manipulationsarten im Voraus zu identifizieren und entsprechende Erkennungsmethoden anzuwenden, was den Nutzen dieser Modelle erheblich verringert.

Um diese beiden Hauptprobleme bestehender IFDL-Methoden zu lösen, nutzt das FakeShield-Framework die leistungsstarken Funktionen großer Sprachmodelle (LLMs), insbesondere multimodaler großer Sprachmodelle (M-LLMs), die in der Lage sind, visuelle und textliche Merkmale aufeinander abzustimmen und so LLM zu stärken verfügt über ein stärkeres visuelles Verständnis. Da LLMs auf einem umfangreichen und vielfältigen Weltwissen vorab geschult sind, verfügen sie über großes Potenzial in vielen Anwendungsbereichen wie maschineller Übersetzung, Code-Vervollständigung und visuellem Verständnis.

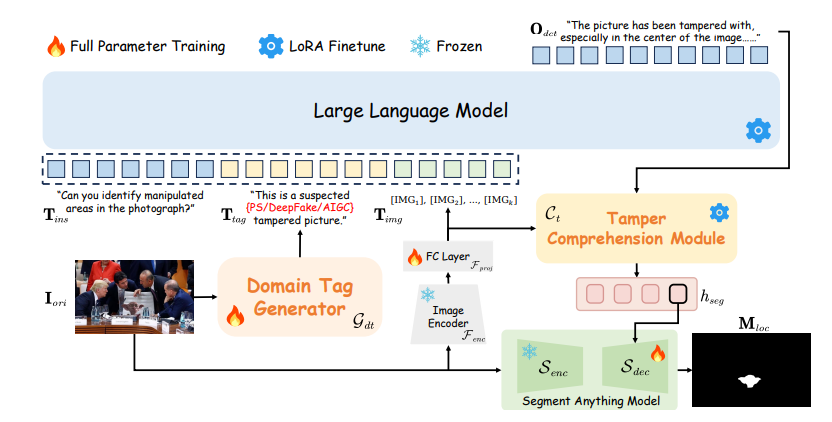

Der Kern des FakeShield-Frameworks ist der Multimodal Tamper Description Dataset (MMTD-Set). Dieser Datensatz nutzt GPT-4o zur Erweiterung des vorhandenen IFDL-Datensatzes und enthält Dreiergruppen manipulierter Bilder, geänderte Regionsmasken und detaillierte Beschreibungen bearbeiteter Regionen. Durch den Einsatz von MMTD-Set hat das Forschungsteam die M-LLM- und visuellen Segmentierungsmodelle so optimiert, dass sie vollständige Analyseergebnisse liefern können, einschließlich der Erkennung von Manipulationen und der Erstellung präziser Masken für manipulierte Bereiche.

FakeShield umfasst außerdem das Domain Label Guided Interpretable Forgery Detection Module (DTE-FDM) und das Multimodal Forgery Localization Module (MFLM), die jeweils zur Lösung verschiedener Arten der Manipulationserkennungsinterpretation und zur Implementierung der Fälschungslokalisierung mithilfe detaillierter Textbeschreibungen verwendet werden.

Umfangreiche Experimente zeigen, dass FakeShield verschiedene Manipulationstechniken effektiv erkennen und lokalisieren kann und im Vergleich zu früheren IFDL-Methoden eine interpretierbare und überlegene Lösung bietet.

Dieses Forschungsergebnis ist der erste Versuch, M-LLM auf interpretierbares IFDL anzuwenden, was einen bedeutenden Fortschritt auf diesem Gebiet darstellt. FakeShield eignet sich nicht nur gut zur Manipulationserkennung, sondern bietet auch umfassende Erklärungen und eine präzise Lokalisierung und weist starke Generalisierungsfähigkeiten für verschiedene Manipulationstypen auf. Diese Funktionen machen es zu einem vielseitigen Hilfswerkzeug für eine Vielzahl realer Anwendungen.

In Zukunft wird diese Arbeit in mehreren Bereichen eine entscheidende Rolle spielen, beispielsweise bei der Verbesserung von Gesetzen und Vorschriften im Zusammenhang mit der Manipulation digitaler Inhalte, bei der Bereitstellung von Leitlinien für die Entwicklung generativer künstlicher Intelligenz und bei der Förderung einer klareren und vertrauenswürdigeren Online-Umgebung . . Darüber hinaus kann FakeShield bei der Beweiserhebung in Gerichtsverfahren helfen und dabei helfen, Fehlinformationen im öffentlichen Diskurs zu korrigieren, was letztendlich dazu beiträgt, die Integrität und Zuverlässigkeit digitaler Medien zu verbessern.

Projekthomepage: https://zhipeixu.github.io/projects/FakeShield/

GitHub-Adresse: https://github.com/zhipeixu/FakeShield

Papieradresse: https://arxiv.org/pdf/2410.02761

Das Aufkommen von FakeShield hat neue Durchbrüche auf dem Gebiet der Bildmanipulationserkennung gebracht. Seine Interpretierbarkeit und seine starken Generalisierungsfähigkeiten machen es zu einem großen Potenzial für praktische Anwendungen. Es lohnt sich, auf seinen zukünftigen Einsatz bei der Aufrechterhaltung der Netzwerksicherheit und der Verbesserung der Glaubwürdigkeit digitaler Daten zu blicken Medien spielen eine größere Rolle. Der Herausgeber von Downcodes glaubt, dass diese Technologie einen positiven Einfluss auf die Authentizität und Zuverlässigkeit digitaler Inhalte haben wird.