Das Gebiet der künstlichen Intelligenz verändert sich von Tag zu Tag und das Kausaldenken ist in den letzten Jahren zu einem heißen Forschungsthema geworden. Herkömmlichen Modellen des maschinellen Lernens mangelt es oft an logischem Denken und es fällt ihnen schwer, den Kausalzusammenhang hinter Ereignissen zu verstehen. Heute wird der Herausgeber von Downcodes einen Forschungsbericht von Institutionen wie Microsoft und MIT vorstellen, der eine bahnbrechende Trainingsstrategie für maschinelles Lernen vorschlägt, die die logischen Denkfähigkeiten großer Modelle und sogar kleiner Transformer-Modelle erheblich verbessert. 4 in der Denkfähigkeit. Schauen wir uns dieses beeindruckende Forschungsergebnis genauer an.

Im Zeitalter der Informationsexplosion beschäftigen wir uns täglich mit intelligenten Geräten. Haben Sie sich jemals gefragt, woher diese scheinbar klugen Kerle wissen, dass sie einen Regenschirm mitbringen, weil es regnet? Dahinter steckt tatsächlich eine tiefgreifende Revolution im Kausaldenken.

Eine Gruppe von Forschern renommierter akademischer Institutionen, darunter Microsoft und MIT, hat eine bahnbrechende Trainingsstrategie für maschinelles Lernen entwickelt. Diese Strategie überwindet nicht nur die Mängel großer Modelle für maschinelles Lernen beim logischen Denken, sondern erzielt auch erhebliche Verbesserungen durch die folgenden Schritte:

Einzigartige Trainingsmethode: Die Forscher verwendeten eine neuartige Trainingsmethode, die sich von herkömmlichen Trainingstechniken für maschinelles Lernen unterscheiden kann.

Verbesserungen beim logischen Denken: Ihr Ansatz verbessert die logischen Denkfähigkeiten großer Modelle erheblich und löst damit bisher bestehende Herausforderungen.

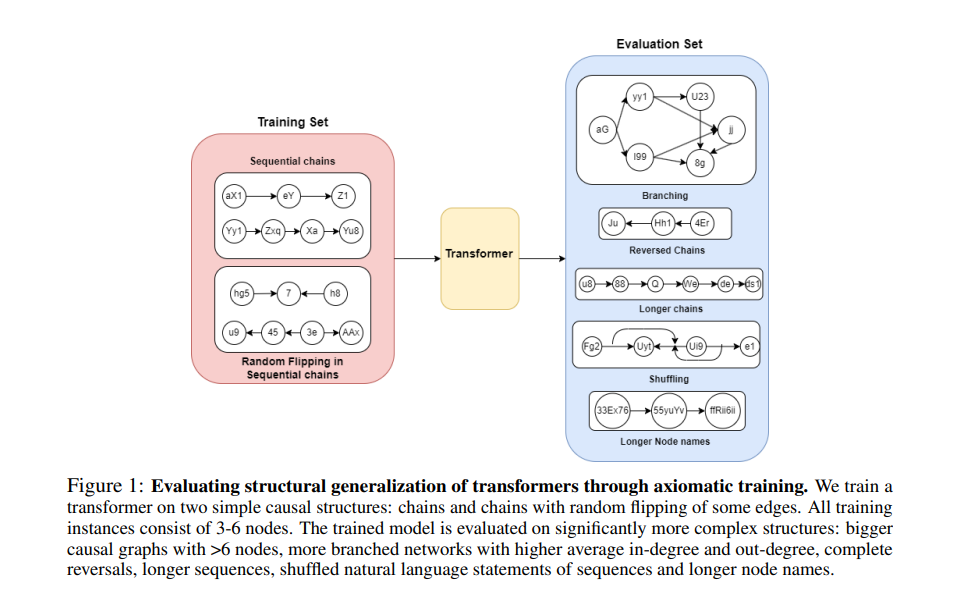

Verwenden Sie Kausalität, um einen Trainingssatz zu erstellen: Das Forschungsteam verwendet ein Kausalitätsmodell, um einen Trainingsdatensatz zu erstellen. Dieses Modell kann den Kausalzusammenhang zwischen Variablen aufdecken und dabei helfen, ein Modell zu trainieren, das die kausale Logik hinter den Daten verstehen kann.

Vermitteln Sie die grundlegenden Axiome des Modells: Sie vermitteln dem Modell direkt die grundlegenden Prämissen in Logik und Mathematik, um dem Modell zu helfen, bessere logische Überlegungen anzustellen.

Die erstaunliche Leistung des kleinen Transformer-Modells: Obwohl die Modellparameter nur 67 Millionen betragen, ist das mit dieser Methode trainierte Transformer-Modell hinsichtlich der Argumentationsfähigkeiten mit GPT-4 vergleichbar.

Das Kausaldenken mag wie eine Domäne der Philosophen klingen, tatsächlich ist es jedoch bereits in jeden Aspekt unseres Lebens eingedrungen. Für die künstliche Intelligenz ist die Beherrschung des kausalen Denkens so, als würde man lernen, die Welt mit „weil...so...“ zu erklären. Aber KI wird nicht damit geboren, sie muss lernen, und dieser Lernprozess ist die Geschichte dieses Artikels.

Axiom-Trainingsmethode:

Stellen Sie sich vor, Sie haben einen Schüler, der sehr schlau ist, aber keine Ahnung von Ursache und Wirkung in der Welt hat. Wie lehrt man es? Forscher haben eine Lösung gefunden – Axiom-Training. Das ist so, als würde man der KI ein „Kausalitätshandbuch“ geben und sie anhand dieses Handbuchs lernen lassen, kausale Regeln zu identifizieren und anzuwenden.

Die Forscher führten Experimente mit dem Transformatormodell durch und stellten fest, dass diese Trainingsmethode nicht nur lernte, kausale Zusammenhänge auf kleinen Diagrammen zu erkennen, sondern sie konnte dieses Wissen auch auf größere Diagramme anwenden, selbst wenn So ein großes Bild hat man noch nie gesehen.

Der Beitrag dieser Forschung besteht darin, dass sie eine neue Methode für die KI bereitstellt, um kausale Schlussfolgerungen aus passiven Daten zu lernen. Das ist, als würde man der KI eine neue Art des „Denkens“ geben, damit sie die Welt besser verstehen und erklären kann.

Diese Forschung ermöglicht es uns nicht nur, die Möglichkeit zu erkennen, dass KI kausales Denken erlernt, sondern öffnet uns auch die Tür für mögliche Anwendungsszenarien von KI in der Zukunft. Vielleicht können unsere intelligenten Assistenten in naher Zukunft nicht nur Fragen beantworten, sondern uns auch sagen, warum etwas passiert.

Papieradresse: https://arxiv.org/pdf/2407.07612v1

Alles in allem hat diese Forschung zu erheblichen Verbesserungen der Kausalschlussfähigkeiten der künstlichen Intelligenz geführt und neue Richtungen und Möglichkeiten für die zukünftige KI-Entwicklung eröffnet. Der Herausgeber von Downcodes freut sich auf die Anwendung dieser Technologie in weiteren Bereichen, die es der KI ermöglichen wird, Menschen besser zu verstehen und ihnen zu dienen.