OpenAI hat in letzter Zeit häufige Schritte unternommen, um nach der Open Source von Llama 3.1 eine weitere große Neuigkeit zu veröffentlichen: Von jetzt an bis zum 23. September können Entwickler täglich 2 Millionen Trainingstoken kostenlos erhalten, um das Modell zu verfeinern! Dieser Schritt zeigt nicht nur die Großzügigkeit von OpenAI, sondern markiert auch eine neue Etappe in der Entwicklung der KI-Technologie. Der Herausgeber von Downcodes wird Ihnen ein detailliertes Verständnis der Vorteile von GPT-4o mini und der Bedeutung dieser kostenlosen Feinabstimmungsveranstaltung vermitteln.

Während uns die Nachricht, dass Llama 3.1 Open Source sein wird, immer noch in den Ohren klingelt, ist OpenAI hier, um erneut im Rampenlicht zu stehen. Von nun an werden täglich bis zum 23. September 2 Millionen Trainingstoken zur kostenlosen Feinabstimmung des Modells verwendet. Dies ist nicht nur eine großzügige Spende an Entwickler, sondern auch ein mutiger Vorstoß für die Weiterentwicklung der KI-Technologie.

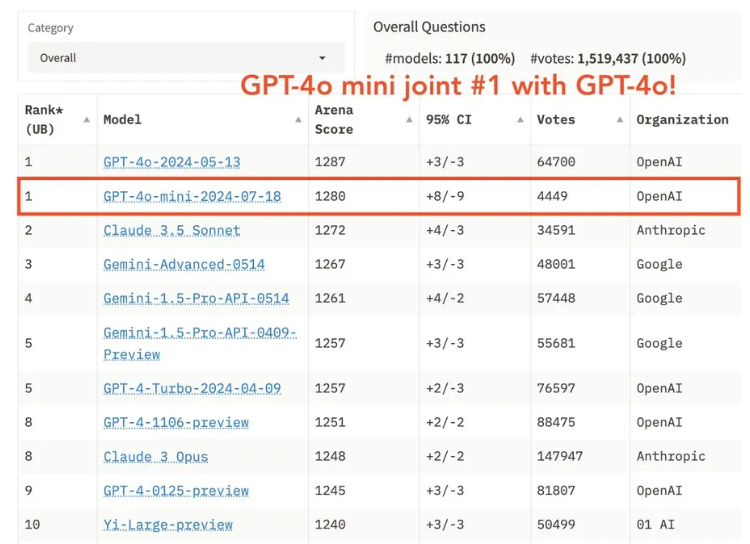

Die Einführung von GPT-4o mini hat unzählige Entwickler begeistert. Es belegt mit GPT-4o den ersten Platz im LMSYS-Ranking der großen Modellarena. Es verfügt über eine starke Leistung, aber der Preis beträgt nur 1/20 des GPT-4o. Dieser Schritt von OpenAI ist zweifellos ein großer Vorteil für den KI-Bereich.

Die Entwickler, die die E-Mail erhielten, beeilten sich, sich gegenseitig aufgeregt zu sagen, dass ein so großes Stück Wolle so schnell wie möglich geerntet werden müsse. OpenAI gab bekannt, dass Entwickler vom 23. Juli bis 23. September 2 Millionen Trainingstoken kostenlos nutzen können. Der Überschuss wird mit 3 Millionen US-Dollar-Tokens berechnet.

Erschwinglicher: Die Eingabe-Token-Gebühr von GPT-4o mini ist 90 % niedriger als die von GPT-3.5Turbo und die Ausgabe-Token-Gebühr ist 80 % niedriger. Selbst nach Ablauf des kostenlosen Zeitraums sind die Schulungskosten für GPT-4o mini halb so hoch wie für GPT-3.5Turbo.

Längerer Kontext: Die Länge des Trainingskontexts von GPT-4o mini beträgt 65.000 Token, was dem Vierfachen von GPT-3.5Turbo entspricht, und die Länge des Inferenzkontexts beträgt 128.000 Token, was dem Achtfachen von GPT-3.5Turbo entspricht.

Intelligenter und leistungsfähiger: GPT-4o mini ist intelligenter als GPT-3.5Turbo und unterstützt visuelle Funktionen (obwohl die Feinabstimmung derzeit auf Text beschränkt ist).

Die GPT-4o-Mini-Feinabstimmungsfunktion steht Unternehmenskunden sowie Tier4- und Tier5-Entwicklern offen und der Zugriff wird in Zukunft schrittweise auf alle Benutzerebenen ausgeweitet. OpenAI hat einen Leitfaden zur Feinabstimmung veröffentlicht, der Entwicklern den schnellen Einstieg erleichtern soll.

Einige Internetnutzer sind diesbezüglich nicht optimistisch. Sie glauben, dass OpenAI Daten sammelt, KI-Modelle trainiert und verbessert. Andere Internetnutzer glauben, dass der Sieg von GPT-4o mini ein wesentlicher Beweis dafür ist, dass die KI intelligent genug geworden ist, um uns zu täuschen.

Die Veröffentlichung von GPT-4o mini und die kostenlose Feinabstimmungspolitik werden zweifellos die weitere Entwicklung und Popularisierung der KI-Technologie fördern. Für Entwickler ist dies eine einmalige Gelegenheit, leistungsfähigere Anwendungen zu geringeren Kosten zu erstellen. Bedeutet dies für die KI-Technologie selbst einen neuen Meilenstein?

Dokumentation zur Feinabstimmung: https://platform.openai.com/docs/guides/fine-tuning/fine-tuning-integrations

Die kostenlosen Feinabstimmungsaktivitäten von GPT-4o mini bieten Entwicklern hervorragende Lern- und Übungsmöglichkeiten. Seine kostengünstigen und leistungsstarken Eigenschaften weisen auch auf die zukünftige Entwicklungsrichtung von KI-Anwendungen hin !