Mini-Omni, ein multimodales Open-Source-Sprachmodell im großen Maßstab, revolutioniert die Sprachinteraktionstechnologie. Es integriert fortschrittliche Technologie zur Realisierung der Spracheingabe und -ausgabe in Echtzeit und verfügt über die Fähigkeit, gleichzeitig zu denken und zu sprechen, was zu einem natürlicheren und reibungsloseren Mensch-Computer-Interaktionserlebnis führt. Der Hauptvorteil von Mini-Omni liegt in seinen End-to-End-Echtzeit-Sprachverarbeitungsfunktionen. Für reibungslose Gespräche ist keine zusätzliche Konfiguration von ASR- oder TTS-Modellen erforderlich. Es unterstützt mehrere modale Eingaben und wandelt diese flexibel um, um sie an verschiedene komplexe Szenarien anzupassen und unterschiedliche Anforderungen zu erfüllen.

Heute, mit der rasanten Entwicklung der künstlichen Intelligenz, ist ein multimodales, groß angelegtes Open-Source-Sprachmodell namens Mini-Omni führend bei der Innovation der Sprachinteraktionstechnologie. Dieses in mehrere fortschrittliche Technologien integrierte KI-System ermöglicht nicht nur die Spracheingabe und -ausgabe in Echtzeit, sondern verfügt auch über die einzigartige Fähigkeit, gleichzeitig zu denken und zu sprechen, was den Benutzern ein beispielloses natürliches Interaktionserlebnis bietet.

Der Hauptvorteil von Mini-Omni liegt in seinen End-to-End-Echtzeit-Sprachverarbeitungsfunktionen. Benutzer können reibungslose Sprachgespräche genießen, ohne zusätzliche Konfiguration von automatischen Spracherkennungsmodellen (ASR) oder Text-to-Speech-Modellen (TTS). Dieses nahtlose Design verbessert das Benutzererlebnis erheblich und macht die Mensch-Computer-Interaktion natürlicher und intuitiver.

Neben der Sprachfunktion unterstützt Mini-Omni auch die Eingabe in mehreren Modi wie z. B. Text und kann flexibel zwischen verschiedenen Modi wechseln. Diese multimodale Verarbeitungsfähigkeit ermöglicht es dem Modell, sich an verschiedene komplexe Interaktionsszenarien anzupassen und den unterschiedlichen Bedürfnissen der Benutzer gerecht zu werden.

Besonders hervorzuheben ist die Funktion „Any Model Can Talk“ des Mini-Omni. Diese Innovation ermöglicht es anderen KI-Modellen, die Echtzeit-Sprachfunktionen von Mini-Omni problemlos zu integrieren, wodurch die Möglichkeiten für KI-Anwendungen erheblich erweitert werden. Dies bietet Entwicklern nicht nur mehr Auswahlmöglichkeiten, sondern ebnet auch den Weg für die bereichsübergreifende Anwendung der KI-Technologie.

In puncto Leistung zeigt Mini-Omni seine umfassende Stärke. Es schneidet nicht nur gut bei herkömmlichen Sprachaufgaben wie Spracherkennung (ASR) und Sprachgenerierung (TTS) ab, sondern zeigt auch großes Potenzial bei multimodalen Aufgaben, die komplexe Argumentationsfähigkeiten erfordern, wie TextQA und SpeechQA. Diese umfassende Fähigkeit ermöglicht es Mini-Omni, eine Vielzahl komplexer Interaktionsszenarien zu bewältigen, von einfachen Sprachbefehlen bis hin zu Frage- und Antwortaufgaben, die gründliches Nachdenken erfordern.

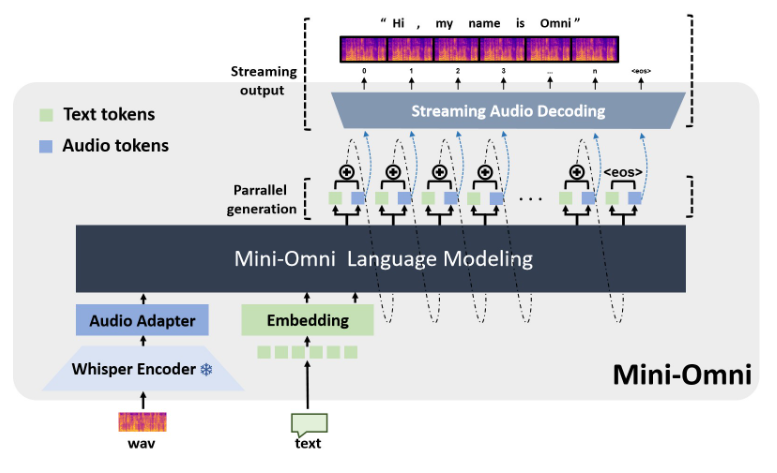

Die technische Implementierung von Mini-Omni umfasst mehrere fortschrittliche KI-Modelle und -Technologien. Es verwendet Qwen2 als Basis eines großen Sprachmodells, verwendet litGPT für Training und Inferenz, verwendet Whisper für die Audiokodierung und Snac ist für die Audiodekodierung verantwortlich. Diese Multitechnologie-Fusionsmethode verbessert nicht nur die Gesamtleistung des Modells, sondern erhöht auch seine Anpassungsfähigkeit an verschiedene Szenarien.

Für Entwickler und Forscher bietet Mini-Omni eine komfortable Nutzung. Mit einfachen Installationsschritten können Benutzer Mini-Omni in ihrer lokalen Umgebung starten und interaktive Demonstrationen über Tools wie Streamlit und Gradio durchführen. Diese offene und benutzerfreundliche Funktion bietet starke Unterstützung für die Popularisierung und innovative Anwendung der KI-Technologie.

Projektadresse: https://github.com/gpt-omni/mini-omni

Mit seinen leistungsstarken Funktionen, der bequemen Nutzung und den Open-Source-Funktionen bringt Mini-Omni neue Möglichkeiten in den Bereich der KI-Sprachinteraktion und verdient die Aufmerksamkeit und Erforschung von Entwicklern und Forschern. Es lohnt sich auch, auf die zukünftige Entwicklung zu blicken.