Google hat sich im Preiskampf um die KI-Modelle erneut einen Namen gemacht und bekannt gegeben, dass der Preis seines Gemini 1.5 Flash-Modells um bis zu 78 % gesenkt wurde! Dieser Schritt zielt darauf ab, die Hemmschwelle für Entwickler zu senken und die Popularisierung und Anwendung der KI-Technologie zu fördern. Die deutlich reduzierten Kosten, gepaart mit erweiterter Sprachunterstützung und offenen Feinabstimmungsfunktionen, werden zweifellos mehr Entwickler dazu bewegen, sich anzuschließen und Innovationen im KI-Bereich voranzutreiben.

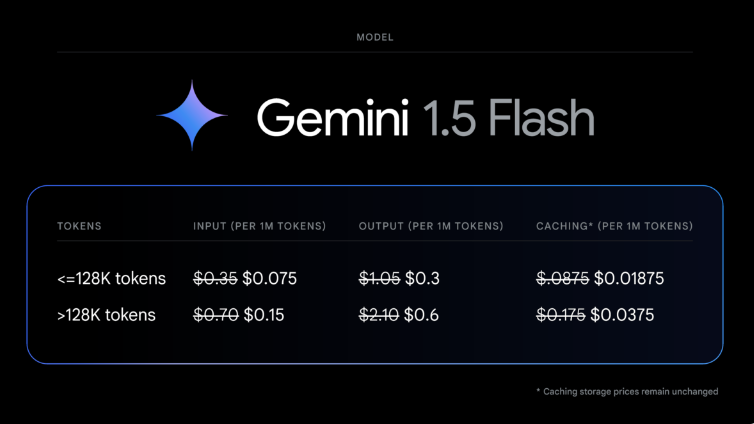

Kürzlich hat Google einen weiteren mutigen Schritt im Preiskampf der KI-Modelle unternommen und angekündigt, dass der Preis seines schnellen KI-Modells Gemini1.5Flash um bis zu 78 % gesenkt wird. Für Entwickler sind das zweifellos gute Nachrichten. Laut der Ankündigung von Google werden die Kosten für Eingabe-Token auf 0,075 US-Dollar pro Million Token sinken, während die Kosten für Ausgabe-Token auf 0,30 US-Dollar pro Million Token für bis zu 128.000 Token sinken werden. Auch für längere Eingabeaufforderungen und Caches gelten ähnliche Preisanpassungen.

Gemini1.5Flash wird häufig in Szenarien verwendet, die eine schnelle Reaktion und geringe Latenz erfordern, wie z. B. Zusammenfassung, Klassifizierung und multimodales Verständnis. Das neue API- und AI-Studio von Google unterstützt außerdem bessere PDF-Verständnisfunktionen und kann PDFs mit visuellen Inhalten wie Grafiken und Bildern analysieren und so seine leistungsstarken multimodalen Verarbeitungsfähigkeiten unter Beweis stellen.

Darüber hinaus hat Google auch die Sprachunterstützung für die Modelle Gemini1.5Pro und Flash erweitert, die nun mehr als 100 Sprachen abdecken. Dies bedeutet, dass Entwickler aus verschiedenen Regionen in einer ihnen vertrauten Sprachumgebung entwickeln können, wodurch das Problem blockierter Antworten durch die Verwendung nicht unterstützter Sprachen vermieden wird. Gleichzeitig hat Google auch die Feinabstimmungsfunktion von Gemini1.5Flash für alle Entwickler geöffnet. Mit der Feinabstimmungsfunktion können Entwickler zusätzliche Daten bereitstellen und das Basismodell an bestimmte Aufgaben anpassen, wodurch die Modellleistung verbessert wird. Auf diese Weise können Entwickler die Kontextgröße von Hinweisen reduzieren, wodurch Latenz und Kosten reduziert und gleichzeitig die Modellgenauigkeit verbessert werden.

Die Nachricht über diese Preissenkungsrunde durch Google kommt auch, nachdem OpenAI kürzlich bekannt gegeben hat, dass seine GPT-4o-API-Zugriffsgebühr um bis zu 50 % gesenkt wurde. Angesichts der hohen Kosten für die Entwicklung und den Betrieb von KI-Modellen ist der Preiswettbewerb innerhalb der Branche offensichtlich ziemlich hart geworden.

Highlight:

? Große Preissenkung: Google hat den Input-Token-Preis von Gemini1.5Flash auf 0,075 US-Dollar und den Output-Token-Preis auf 0,30 US-Dollar gesenkt, was einer Reduzierung von bis zu 78 % entspricht.

? Erweiterung der Sprachunterstützung: Gemini1.5Pro- und Flash-Modelle unterstützen jetzt mehr als 100 Sprachen, was die Verwendung für Entwickler auf der ganzen Welt erleichtert.

⚙️ Offene Feinabstimmungsfunktion: Alle Entwickler können das Gemini1.5-Flash-Modell über API und AI Studio optimieren, um die Modellleistung und -genauigkeit zu verbessern.

Alles in allem wird der Schritt von Google die Schwelle für die KI-Entwicklung erheblich senken und eine breitere Anwendung der KI-Technologie fördern. Außerdem wird er den Preiswettbewerb in der KI-Branche verschärfen, was darauf hindeutet, dass zukünftige KI-Modelle benutzerfreundlicher und benutzerfreundlicher werden .