Ein kürzlich von Google veröffentlichter Forschungsbericht warnt davor, dass generative künstliche Intelligenz (GenAI) das Internet mit falschen Inhalten verschmutzt. Der Bericht wies darauf hin, dass es unzählige Fälle von GenAI-Missbrauch gibt, von der Manipulation von Porträts bis hin zur Fälschung von Beweisen, meist mit dem Ziel, die öffentliche Meinung zu beeinflussen, zu betrügen oder Profit zu machen. Auch Google selbst ist aufgrund seiner KI-Produkte, die lächerliche Vorschläge gemacht haben, zu einem Hersteller von Desinformation geworden, was seine Warnungen noch alarmierender macht und die Menschen dazu veranlasst, gründlich über die potenziellen Risiken von GenAI nachzudenken.

Kürzlich warnten Forscher von Google, dass generative künstliche Intelligenz (GenAI) das Internet mit gefälschten Inhalten ruiniert. Dies ist nicht nur eine Warnung, sondern auch eine Zeit der Selbstreflexion.

Ironischerweise spielt Google in diesem „Krieg zwischen Wahrheit und Falschheit“ eine Doppelrolle. Einerseits ist es ein wichtiger Förderer der generativen KI, andererseits aber auch ein Produzent von Desinformation. Die KI-Übersichtsfunktion von Google enthielt lächerliche Vorschläge wie „Kleber auf Pizza“ und „Iss Steine“, und diese fehlerhaften Meldungen mussten schließlich manuell gelöscht werden.

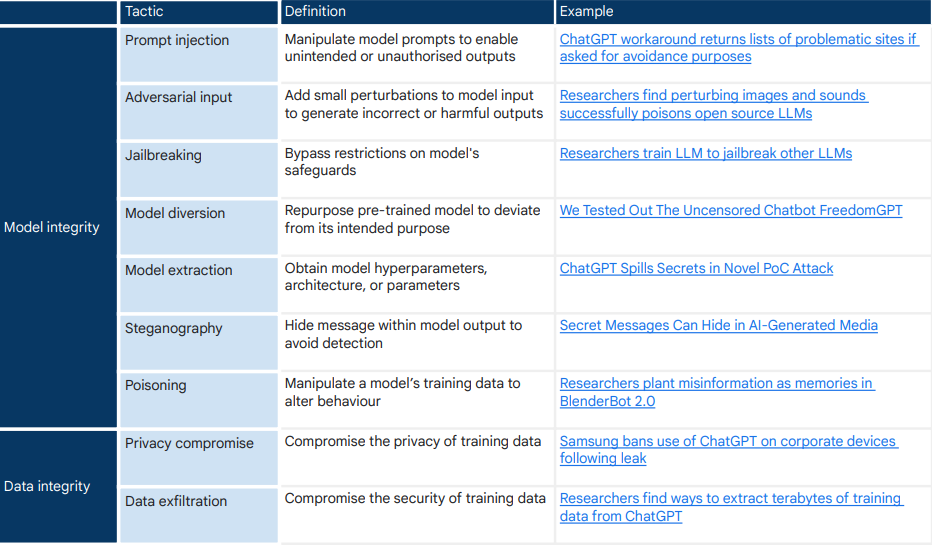

Das Google-Forschungsteam führte eine eingehende Untersuchung von 200 Nachrichtenberichten über den Missbrauch generativer KI durch und stellte fest, dass die Manipulation menschlicher Porträts und die Fälschung von Beweisen die häufigsten Missbrauchsmethoden waren. Der Zweck dieser Handlungen besteht lediglich darin, die öffentliche Meinung zu beeinflussen, zu betrügen oder Gewinne zu erzielen. Obwohl die Risiken der generativen KI noch nicht das Niveau einer „existenziellen Bedrohung“ erreicht haben, sind sie bereits da und könnten in Zukunft noch schlimmer werden.

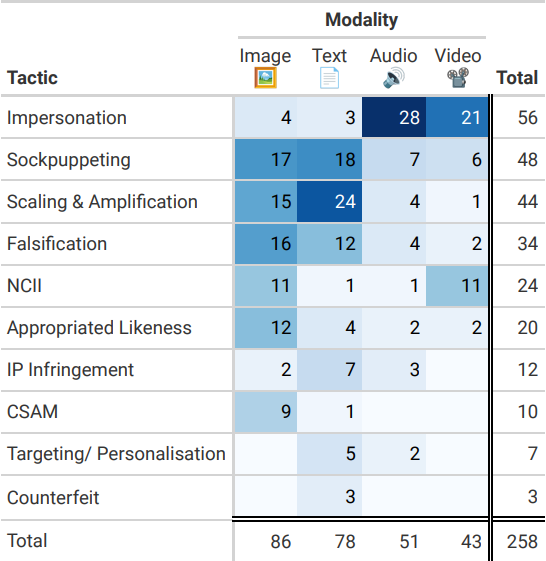

Die Forscher fanden heraus, dass es sich bei den meisten GenAI-Missbrauchsfällen um die normale Nutzung des Systems handelte und kein „Jailbreaking“-Verhalten vorlag. Dieser „Routinebetrieb“ macht 90 % aus. Die weit verbreitete Verfügbarkeit, Zugänglichkeit und der Hyperrealismus von GenAI ermöglichen endlose Formen des Missbrauchs auf niedrigerer Ebene. Die Kosten für die Generierung falscher Informationen sind zu gering!

Das Forschungsmaterial von Google stammt größtenteils aus Medienberichten. Bedeutet dies, dass die Medien eher dazu neigen, über sensationelle Ereignisse zu berichten, was dazu führen kann, dass der Datensatz auf bestimmte Arten von Missbrauch ausgerichtet ist? 404Media weist darauf hin, dass es viele nicht gemeldete Missbräuche generativer KI gibt, von denen wir noch nichts wissen.

Mit einigen Tipps lassen sich die „Zäune“ der KI-Tools geschickt umgehen. Beispielsweise kann das KI-Tool zum Klonen von Stimmen von ElevenLabs die Stimmen von Kollegen oder Prominenten mit einem hohen Maß an Wiedergabetreue nachahmen. Civitai-Benutzer können KI-generierte Bilder von Prominenten erstellen, und obwohl die Plattform eine Richtlinie gegen NCII (intime Bilder ohne Zustimmung) hat, hindert nichts Benutzer daran, Open-Source-Tools zu verwenden, um NCII auf ihren eigenen Computern zu generieren.

Wenn sich falsche Informationen verbreiten, wird das Chaos im Internet die Fähigkeit der Menschen, zwischen Wahrheit und Unwahrheit zu unterscheiden, auf eine große Probe stellen. Wir werden in einem ständigen Zustand des Zweifels gefangen sein: „Ist das real?“ Wenn die Kontamination öffentlicher Daten durch KI-generierte Inhalte nicht berücksichtigt wird, kann dies auch den Informationsabruf behindern und die kollektive Wahrnehmung der gesellschaftspolitischen Realität oder des wissenschaftlichen Konsenses verzerren.

Google hat zur Verbreitung falscher Inhalte durch generative KI beigetragen. Die vor vielen Jahren abgefeuerte Kugel traf ihn heute endlich zwischen den Augenbrauen. Googles Forschung könnte der Beginn der Selbsterlösung und ein Weckruf für die gesamte Internetgesellschaft sein.

Papieradresse: https://arxiv.org/pdf/2406.13843

Dieser Google-Bericht ist zweifellos eine Warnung für die zukünftige Entwicklung von GenAI. Wie man technologische Entwicklung und Risikokontrolle in Einklang bringt und wie man effektiv auf die Verbreitung falscher Informationen durch GenAI reagiert, sind gemeinsame Herausforderungen, vor denen die globale Technologiegemeinschaft und die Gesellschaft stehen. Wir freuen uns auf weitere Forschungen und Maßnahmen, um gemeinsam die Authentizität und Reinheit des Internets zu bewahren.