Adobe, ein Riese im Bereich kreativer Software, hat durch die Aktualisierung seiner Nutzungsbedingungen für große Kontroversen gesorgt. Dieses Update ermöglicht Adobe den Zugriff auf Benutzerarbeiten, um sein KI-Modell Firefly zu verbessern, ein Schritt, der weithin als „Overlord-Klausel“ kritisiert wurde, die das Urheberrecht und die Privatsphäre der Benutzer verletzt. Dieser Artikel bietet eine detaillierte Analyse der Kontroverse, die durch die Aktualisierung der Nutzungsbedingungen von Adobe ausgelöst wurde, untersucht die Gründe dafür und die zunehmend angespannte Beziehung zwischen Technologieunternehmen und Benutzern.

Adobe, ein bekannter Name in der Kreativbranche, ist aufgrund seiner Haltung zum Urheberrechtsschutz als „Copyright Guardian“ bekannt. Doch kürzlich geriet das Unternehmen aufgrund einer stillschweigenden Aktualisierung seiner Nutzungsbedingungen in den Strudel der öffentlichen Meinung.

Im Februar dieses Jahres hat Adobe seine Produkt-Nutzungsbedingungen stillschweigend aktualisiert und eine auffällige Ergänzung hinzugefügt: Benutzer müssen zustimmen, dass Adobe auf automatisierten und manuellen Wegen auf ihre Werke zugreifen kann, einschließlich solcher, die durch Geheimhaltungsvereinbarungen geschützt sind. Adobe wird diese Arbeiten nutzen, um seine Dienste und Software durch Technologien wie maschinelles Lernen zu verbessern. Wenn Benutzer diesen neuen Bedingungen nicht zustimmen, können sie die Software von Adobe nicht verwenden.

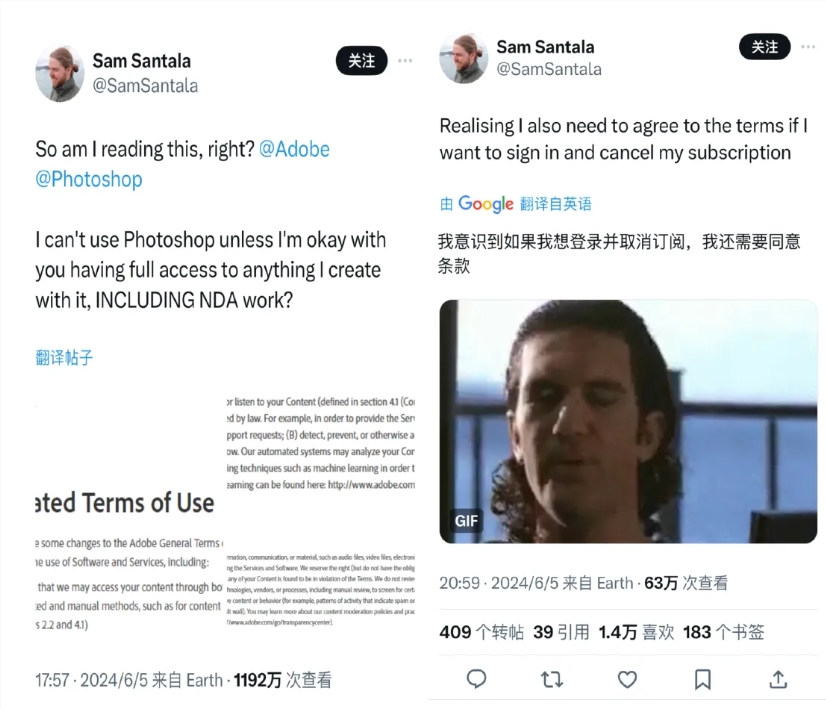

Die Änderung wurde kürzlich bekannt gegeben und löste eine Gegenreaktion bei den Kernnutzern von Adobe aus, darunter Kreative, Digitalkünstler und Designer. Sie glauben, dass es sich hierbei um eine Zwangsautorisierung handelt, im Wesentlichen um eine „Overlord-Klausel“, und dass ihr eigentlicher Zweck darin besteht, Adobes generatives KI-Modell „Firefly“ zu trainieren. Ein Blogger namens Sam Santala stellte diese Bestimmung auf Twitter in Frage und sein Tweet wurde zig Millionen Mal aufgerufen.

Viele Benutzer haben Bedenken hinsichtlich ihrer Privatsphäre und ihres Urheberrechts geäußert und sich entschieden, die Produkte von Adobe nicht mehr zu verwenden. Gleichzeitig hat Meta ähnliche Maßnahmen ergriffen und seine Datenschutzrichtlinie aktualisiert, um die Verwendung von Informationen zu ermöglichen, die von Benutzern auf Meta-Produkten und -Diensten geteilt werden, um KI zu trainieren. Wenn Nutzer mit der neuen Datenschutzrichtlinie nicht einverstanden sind, sollten sie darüber nachdenken, die Nutzung von Social-Media-Produkten wie Facebook und Instagram einzustellen.

Mit der rasanten Entwicklung der KI-Technologie ist der Kampf zwischen Technologieunternehmen und Nutzern um Datenschutz, Eigentum an Inhalten und Kontrolle immer härter geworden. Adobe behauptet, dass die Trainingsdaten für sein Firefly-Modell aus Hunderten Millionen Bildern in der Adobe-Bildbibliothek, einigen öffentlich lizenzierten Bildern und öffentlichen Bildern stammen, deren Urheberrechtsschutz abgelaufen ist. Andere KI-Bilderzeugungstools wie Stability AI’s Stable Diffusion, OpenAI’s Dall-E2 und Midjourney waren jedoch aus urheberrechtlichen Gründen umstritten.

Adobe versucht, in diesem Bereich eine differenzierte Marktpositionierung einzunehmen und zum „weißen Ritter“ im KI-Wettrüsten zu werden, indem es die Legitimität seiner Modelltrainingsdaten betont und die Zahlung von Ansprüchen in Urheberrechtsstreitigkeiten verspricht, die durch die Verwendung generierter Bilder entstehen von Adobe Firefly. Doch die Strategie zerstreute nicht alle Bedenken der Nutzer. Einige Benutzer, wie der leitende Designer Ajie, bezeichnen sich scherzhaft als „echte Adobe-Opfer“ und glauben, dass Adobe sein riesiges kreatives Ökosystem nutzt, um KI zu trainieren. Obwohl dies eine kluge Geschäftsstrategie für Benutzer, die Plattform und die Erstellung von Interessen ist Benutzer und das Recht des Benutzers auf Auskunft fehlen.

Darüber hinaus kam es im Ausland immer wieder zu Urheberrechtsstreitigkeiten mit Adobe, die bei Anwendern zu der Frage führten, ob Adobe das Urheberrecht der Urheber wirklich respektiert. Beispielsweise entdeckte der Künstler Brian Kesinger, dass KI-generierte Bilder, die seiner Arbeit ähnelten, ohne seine Zustimmung unter seinem Namen in der Adobe-Bildbibliothek verkauft wurden. Der Nachlass des Fotografen Ansel Adams hat Adobe außerdem öffentlich beschuldigt, angeblich generative KI-Repliken der Arbeiten des verstorbenen Fotografen verkauft zu haben.

Unter dem Druck der öffentlichen Meinung überarbeitete Adobe am 19. Juni seine Nutzungsbedingungen und stellte klar, dass es keine lokal oder in der Cloud gespeicherten Benutzerinhalte zum Trainieren von KI-Modellen verwenden wird. Doch die Klarstellung konnte die Bedenken der Urheber nicht vollständig zerstreuen. Einige bekannte Blogger im KI-Kreis im Ausland wiesen darauf hin, dass die überarbeiteten Nutzungsbedingungen von Adobe weiterhin die Nutzung privater Cloud-Daten von Benutzern zum Trainieren von Modellen für maschinelles Lernen nicht generativer KI-Tools erlauben. Obwohl Nutzer die „Inhaltsanalyse“ ablehnen können, schreckt der komplizierte Kündigungsvorgang viele Nutzer oft ab.

In verschiedenen Ländern und Regionen gelten unterschiedliche Regelungen zum Datenschutz der Nutzer, was sich auch auf die Strategien der Social-Media-Plattformen bei der Formulierung der Nutzungsbedingungen der Nutzer auswirkt. Beispielsweise haben Benutzer im Vereinigten Königreich und in der EU gemäß der Datenschutz-Grundverordnung (DSGVO) ein „Widerspruchsrecht“ und können sich ausdrücklich dagegen entscheiden, dass ihre personenbezogenen Daten zum Trainieren der Modelle der künstlichen Intelligenz von Meta verwendet werden. Allerdings haben US-Benutzer nicht das gleiche Recht auf Information. Gemäß der bestehenden Datenfreigaberichtlinie von Meta könnten von US-Benutzern auf den Social-Media-Produkten von Meta gepostete Inhalte ohne ausdrückliche Zustimmung zum Training von KI verwendet worden sein.

Daten werden im KI-Zeitalter als das „neue Öl“ gefeiert, doch es gibt immer noch viele Grauzonen bei der „Ausbeutung“ von Ressourcen. Einige Technologieunternehmen haben bei der Beschaffung von Benutzerdaten einen vagen Ansatz gewählt, der ein doppeltes Dilemma hinsichtlich der persönlichen Informationsrechte der Benutzer ausgelöst hat: Eigentum an digitalen Urheberrechten und Datenschutzprobleme, was das Vertrauen der Benutzer in die Plattform ernsthaft geschädigt hat.

Derzeit weist die Plattform noch große Mängel auf, um sicherzustellen, dass generative KI nicht die Rechte der Urheber verletzt, und es mangelt auch an angemessener Aufsicht. Einige Entwickler und Ersteller haben Maßnahmen ergriffen und eine Reihe von „Anti-KI“-Tools auf den Markt gebracht, vom Arbeitsschutztool Glaze über das AI-Datenvergiftungstool Nightshade bis hin zur Anti-KI-Community Cara, die angesichts dessen populär wurde Die unbefugte Nutzung von Benutzern/Erstellern durch Technologieunternehmen erfasst relevante Daten, um das KI-Modell zu trainieren, und die Wut der Menschen hat zugenommen.

Angesichts der rasanten Entwicklung der KI-Technologie bedarf es heute noch einer Weiterentwicklung der Branche und einer kontinuierlichen Verbesserung der rechtlichen Regulierungsmaßnahmen, um ein Gleichgewicht zwischen technologischer Innovation und Sicherheit der Privatsphäre der Nutzer zu finden und die Rechte und Interessen der Urheber zu schützen. Gleichzeitig müssen Benutzer wachsamer sein, ihre Datenrechte verstehen und bei Bedarf Maßnahmen ergreifen, um ihre Kreationen und ihre Privatsphäre zu schützen.

Der Adobe-Vorfall ist nur die Spitze des Eisbergs der Datenkompromisse im KI-Zeitalter. In Zukunft wird es für alle Technologieunternehmen und Regulierungsbehörden ein wichtiges Thema sein, ein Gleichgewicht zwischen technologischem Fortschritt und Benutzerrechten zu finden . Nur durch eine Stärkung der Aufsicht und die Klärung der Datennutzungsregeln können wir eine gesündere und nachhaltigere KI-ökologische Umgebung schaffen.