In diesem Artikel wird der neue Diffusionsmodelladapter VMix vorgestellt, der vom Forschungsteam von ByteDance und der University of Science and Technology of China vorgeschlagen wurde und darauf abzielt, die Qualität und den ästhetischen Effekt der Text-zu-Bild-Generierung zu verbessern. VMix verwendet eine clevere bedingte Kontrollmethode, um die ästhetische Leistung vorhandener Diffusionsmodelle zu verbessern und die Konsistenz zwischen Bildern und Textbeschreibungen aufrechtzuerhalten, ohne das Modell neu zu trainieren. Es zerlegt Texthinweise in inhaltliche und ästhetische Beschreibungen und integriert ästhetische Informationen durch einen hybriden Kreuzaufmerksamkeitsmechanismus in den Bilderzeugungsprozess, um eine feinkörnige Kontrolle über die Bildästhetik zu erreichen. Der Adapter ist mit einer Vielzahl von Community-Modellen kompatibel und bietet vielfältige Einsatzmöglichkeiten.

Im Bereich der Bilderzeugung aus Text hat das Diffusionsmodell außergewöhnliche Fähigkeiten bewiesen, es gibt jedoch immer noch gewisse Mängel bei der ästhetischen Bilderzeugung. Kürzlich hat ein Forschungsteam von ByteDance und der University of Science and Technology of China eine neue Technologie namens „Cross-Attention Value Mixing Control“ (VMix)-Adapter vorgeschlagen, die darauf abzielt, die Qualität der erzeugten Bilder zu verbessern und die Empfindlichkeit gegenüber verschiedenen visuellen Elementen aufrechtzuerhalten Vielseitigkeit des Konzepts.

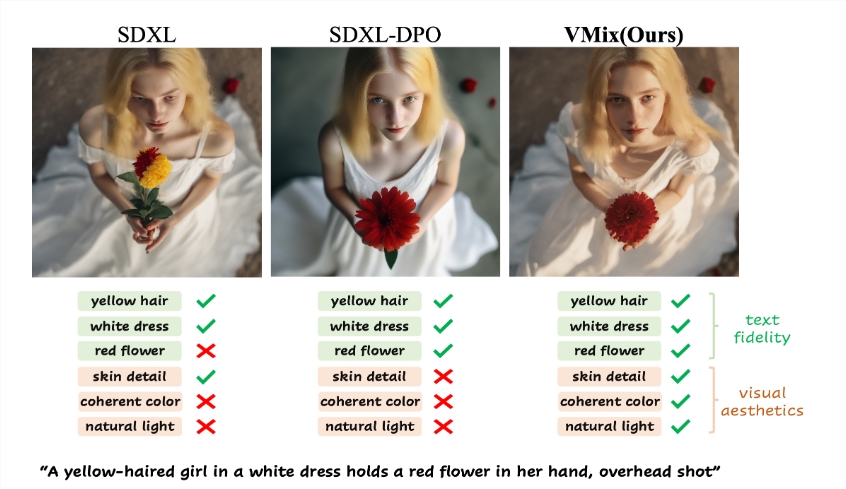

Die Kernidee des VMix-Adapters besteht darin, die ästhetische Leistung bestehender Diffusionsmodelle durch die Entwicklung überlegener bedingter Kontrollmethoden zu verbessern und gleichzeitig die Ausrichtung zwischen Bildern und Text sicherzustellen.

Dieser Adapter erreicht sein Ziel hauptsächlich durch zwei Schritte: Erstens zerlegt er die eingegebenen Texthinweise in Inhaltsbeschreibungen und ästhetische Beschreibungen, indem er ästhetische Einbettungen initialisiert. Zweitens werden während des Entrauschungsprozesses durch Mischen von Queraufmerksamkeit ästhetische Bedingungen integriert, um die zu verbessern Ästhetische Wirkung des Bildes und Wahrung der Konsistenz zwischen Bild und Aufforderungswort. . Die Flexibilität dieses Ansatzes ermöglicht die Anwendung von VMix auf mehrere Community-Modelle ohne Umschulung, wodurch die visuelle Leistung verbessert wird.

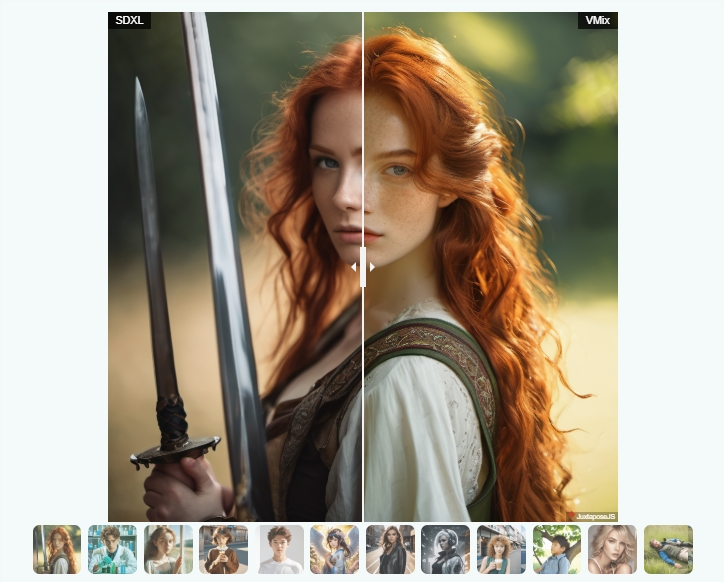

Die Forscher überprüften die Wirksamkeit von VMix durch eine Reihe von Experimenten und die Ergebnisse zeigten, dass die Methode andere hochmoderne Methoden bei der Erzeugung ästhetischer Bilder übertrifft. Gleichzeitig ist VMix auch mit einer Vielzahl von Community-Modulen (wie LoRA, ControlNet und IPAdapter) kompatibel, was seinen Anwendungsbereich weiter erweitert.

Die feinkörnige Kontrolle von VMix über die Ästhetik spiegelt sich in der Möglichkeit wider, ästhetische Einbettungen anzupassen, wodurch bestimmte Dimensionen des Bildes durch eindimensionale ästhetische Beschriftungen oder die Gesamtbildqualität durch vollständige frontale ästhetische Beschriftungen verbessert werden können. In Experimenten kann der VMix-Adapter die Schönheit des erzeugten Bildes erheblich verbessern, wenn dem Benutzer eine Textbeschreibung wie „Ein Mädchen lehnt an einem Fenster, eine Brise weht, ein Sommerporträt, eine mittellange Aufnahme“ gegeben wird.

Der VMix-Adapter eröffnet neue Wege zur Verbesserung der ästhetischen Qualität der Text-zu-Bild-Generierung und wird voraussichtlich in Zukunft sein Potenzial in einem breiteren Anwendungsspektrum entfalten.

Projekteingang: https://vmix-diffusion.github.io/VMix/

Höhepunkte:

Der VMix-Adapter zerlegt Textansagen durch ästhetische Einbettung in inhaltliche und ästhetische Beschreibungen und verbessert so die Qualität der Bilderzeugung.

Dieser Adapter ist mit mehreren Community-Modellen kompatibel, sodass Benutzer die visuellen Bildeffekte ohne Umschulung verbessern können.

Experimentelle Ergebnisse zeigen, dass VMix bestehende Technologien bei der ästhetischen Erzeugung übertrifft und über ein breites Anwendungspotenzial verfügt.

Alles in allem bietet der VMix-Adapter eine effektive Lösung zur Verbesserung der Kunstfertigkeit und Schönheit der KI-Bilderzeugung. Er bietet auch hervorragende Leistungen in Bezug auf Kompatibilität und Benutzerfreundlichkeit und bietet neue Richtungen und Möglichkeiten für die Entwicklung zukünftiger Bilderzeugungstechnologie.