In den letzten Jahren hat die Technologie zur Generierung von KI-Animationen erhebliche Fortschritte gemacht, und EchoMimicV2 zeichnet sich als neueste Errungenschaft durch seine hochwertigen Fähigkeiten zur Generierung menschlicher Animationen in halber Länge aus. Es kombiniert geschickt mehrere Eingabemethoden wie Bilder, Audio und Gestensequenzen, durchbricht die Einschränkungen traditioneller Methoden und bietet eine neue Lösung für die digitale Produktion menschlicher Animationen. In diesem Artikel werden die technischen Merkmale und Vorteile von EchoMimicV2 ausführlich erläutert und seine möglichen Auswirkungen im Bereich Animation erörtert.

In den letzten Jahren ist die Erzeugung lebendiger menschlicher Animationen mit der rasanten Entwicklung der Computer-Vision- und Animationstechnologie allmählich zu einem Forschungsschwerpunkt geworden. Das neueste Forschungsergebnis, EchoMimicV2, nutzt Referenzbilder, Audioclips und Gestensequenzen, um hochwertige menschliche Animationen in halber Länge zu erstellen.

Einfach ausgedrückt unterstützt EchoMimicV2 die Eingabe von 1 Bild + 1 Gestenvideo + 1 Audio, um eine neue digitale Person zu generieren. Dies kann als Eingabe von Audioinhalten, Videos mit Eingabegesten und Kopfbewegungen bezeichnet werden.

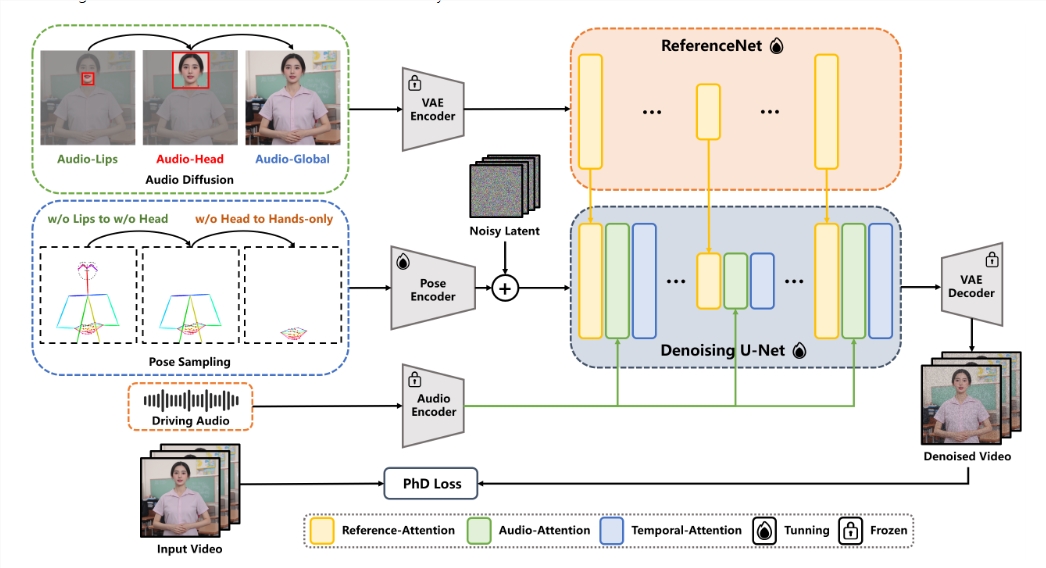

EchoMimicV2 wurde als Reaktion auf einige praktische Herausforderungen in der bestehenden Technologie zur Animationserzeugung entwickelt. Herkömmliche Methoden basieren oft auf mehreren Steuerungsbedingungen, wie z. B. Audio, Körperhaltung oder Bewegungskarten, was die Erstellung von Animationen komplex und umständlich macht und oft auf die Betätigung des Kopfes beschränkt ist. Daher schlug das Forschungsteam eine neue Strategie namens „Audio-Pose Dynamic Harmonization“ vor, die darauf abzielt, den Animationserstellungsprozess zu vereinfachen und gleichzeitig die Details und Ausdruckskraft von Halbkörperanimationen zu verbessern.

Um mit der Knappheit an Halbkörperdaten umzugehen, führten die Forscher innovativ den Mechanismus der „lokalen Kopfaufmerksamkeit“ ein. Diese Methode kann Kopfbilddaten während des Trainingsprozesses effektiv nutzen und diese Daten während der Inferenzphase weglassen, wodurch eine Animationsgenerierung bereitgestellt wird größere Flexibilität.

Darüber hinaus entwarf das Forschungsteam einen „bühnenspezifischen Rauschunterdrückungsverlust“, um die Bewegung, Details und die Leistung der Animation auf niedrigem Niveau in verschiedenen Phasen zu steuern. Durch diese mehrstufige Optimierungsmethode werden Qualität und Wirkung der generierten Animation deutlich verbessert.

Um die Wirksamkeit von EchoMimicV2 zu überprüfen, haben die Forscher außerdem einen neuen Benchmark eingeführt, um den Generierungseffekt menschlicher Animationen in halber Länge zu bewerten. Nach umfangreichen Experimenten und Analysen zeigen die Ergebnisse, dass EchoMimicV2 andere bestehende Methoden sowohl bei quantitativen als auch qualitativen Auswertungen übertrifft und sein starkes Potenzial im Bereich Animation unter Beweis stellt.

Highlight:

EchoMimicV2 erreicht durch die Vereinfachung der Steuerungsbedingungen eine qualitativ hochwertige Generierung menschlicher Halbkörperanimationen.

Verwenden Sie die Audio-Pose Dynamic Harmonization-Strategie, um Animationsdetails und Ausdruckskraft zu verbessern.

Die neue Benchmark-Bewertungsmethode zeigt, dass EchoMimicV2 bestehenden Technologien hinsichtlich der Leistung überlegen ist.

Alles in allem bietet EchoMimicV2 mit seinen innovativen technischen Strategien und überlegenen Generierungseffekten neue Möglichkeiten für die Generierung hochwertiger halblanger menschlicher Animationen und zeigt ein großes Entwicklungspotenzial im Bereich der Animation, das weiterer Forschung wert ist Anwendung.