Der KI-Chatbot von Google Gemini hat kürzlich die mit Spannung erwartete „Memory“-Funktion eingeführt. Dieses Update ermöglicht es Gemini, sich die persönlichen Daten, Arbeitsinhalte und Präferenzen des Benutzers zu merken und so personalisiertere und effektivere Dienste bereitzustellen. Allerdings ist diese Funktion derzeit auf Google One AI Premium-Abonnenten beschränkt (20 US-Dollar pro Monat) und unterstützt nur Web- und Englisch-Eingaben. Die iOS- und Android-Versionen sind noch nicht online. Obwohl es mächtig ist, wirft es auch Bedenken hinsichtlich der Datensicherheit und des Schutzes der Privatsphäre auf.

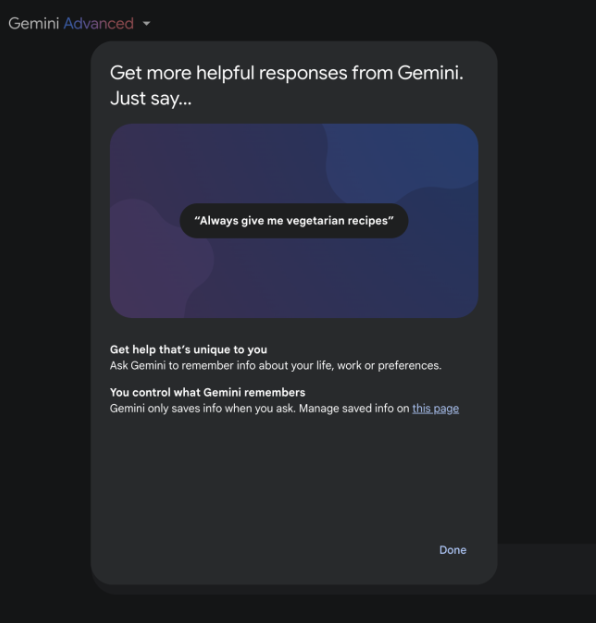

Googles KI-Chatbot Gemini hat kürzlich ein wichtiges Update veröffentlicht – die „Memory“-Funktion, die es dem KI-Assistenten ermöglicht, sich die Lebensinformationen, Arbeitsinhalte und persönlichen Vorlieben des Nutzers zu merken und so ein personalisierteres Serviceerlebnis zu bieten.

Diese neue Funktion ist derzeit nur für Benutzer verfügbar, die den Google One AI Premium-Plan für 20 US-Dollar pro Monat abonnieren. Sie wird derzeit nur auf der Webseite unterstützt und wurde noch nicht für iOS- und Android-Anwendungen eingeführt. Es ist erwähnenswert, dass derzeit nur die englische Eingabe unterstützt wird.

Insbesondere die Speicherfunktion von Gemini kann Benutzern dabei helfen, eine Vielzahl praktischer Szenarien zu realisieren. Nachdem ein Benutzer Gemini beispielsweise mitgeteilt hat, welches Essen er mag, kann die KI bei der nächsten Anfrage nach Restaurantempfehlungen gezieltere Vorschläge basierend auf den Geschmackspräferenzen des Benutzers liefern. Google zeigt in der Benutzeroberfläche auch weitere praktische Beispiele an, etwa „Verwenden Sie eine einfache Sprache und vermeiden Sie Fachjargon“, „Ich kenne mich nur mit JavaScript-Programmierung aus“ und „Beziehen Sie die täglichen Ausgaben bei der Reiseplanung mit ein“.

Google betont, dass Nutzer die Speicherfunktion jederzeit deaktivieren können, der gespeicherte Speicherinhalt jedoch manuell gelöscht werden muss, bevor er verschwindet. Noch wichtiger ist, dass ein Google-Sprecher klarstellte, dass diese Speicherinformationen weder für das Modelltraining verwendet noch mit anderen geteilt werden.

Allerdings gibt die Sicherheit dieser Art von Speicherfunktion Anlass zur Sorge. Anfang des Jahres entdeckte ein Sicherheitsforscher, dass Hacker „falsche“ Erinnerungen in ChatGPT einfügen konnten, um weiterhin Benutzerdaten zu stehlen. Diese Entdeckung erinnert uns daran, dass die Speicherfunktion von KI-Systemen strengere Sicherheitsmaßnahmen erfordert.

Die Einführung dieser Funktion spiegelt den Trend wider, dass KI-Assistenten immer personalisierter und intelligenter werden, regt aber auch zum Nachdenken über den Schutz der Privatsphäre der Benutzer und die Datensicherheit an. Wie die Sicherheit der Benutzerdaten gewährleistet und gleichzeitig Komfort geboten werden kann, wird ein wichtiges Thema sein, dem Anbieter von KI-Diensten weiterhin Aufmerksamkeit schenken müssen.

Die „Speicher“-Funktion von Gemini hat zweifellos das Benutzererlebnis verbessert, aber die Sicherheits- und Datenschutzprobleme müssen noch weiter verbessert werden. Dies wird eine Herausforderung für Google und sogar die gesamte KI-Branche sein. Nur wenn die Sicherheit gewährleistet ist, kann KI der Menschheit besser dienen.