Kürzlich wurde berichtet, dass OpenAI bald ein neues KI-Tool namens „Operator“ herausbringen wird, das Personalcomputer direkt steuern und verschiedene Aufgaben autonom ausführen kann, was große Aufmerksamkeit erregt hat. Laut Softwareentwickler Tibor Blaho bestätigte er die Nachricht, indem er versteckte Optionen im OpenAI ChatGPT-MacOS-Client und zugehörige Informationen auf der offiziellen OpenAI-Website (noch nicht öffentlich) entdeckte und sagte voraus, dass die Veröffentlichung im Januar 2025 erfolgen wird. Diese Nachricht spiegelt auch frühere Berichte von Bloomberg und anderen Medien wider, was ihre Glaubwürdigkeit weiter erhöht. Das Aufkommen von „Operator“ wird die Art und Weise, wie Personalcomputer verwendet werden, revolutionär verändern und auch ein neues Kapitel in der Erforschung praktischer Anwendungen der Technologie der künstlichen Intelligenz aufschlagen.

Kürzlich gab es Neuigkeiten, dass OpenAI im Begriff ist, ein KI-Tool namens „Operator“ auf den Markt zu bringen, das einen Personalcomputer steuern und in seinem Namen Aufgaben ausführen kann. Der Softwareentwickler Tibor Blaho gab die Neuigkeiten in den sozialen Medien bekannt und sagte, er habe die neuesten Hinweise auf das Tool entdeckt. Zuvor hatten viele Medien, darunter auch Bloomberg, über Gerüchte über den „Operator“ berichtet, wonach er mehrere Aufgaben wie das Schreiben von Code und das Buchen von Reisen autonom erledigen könne.

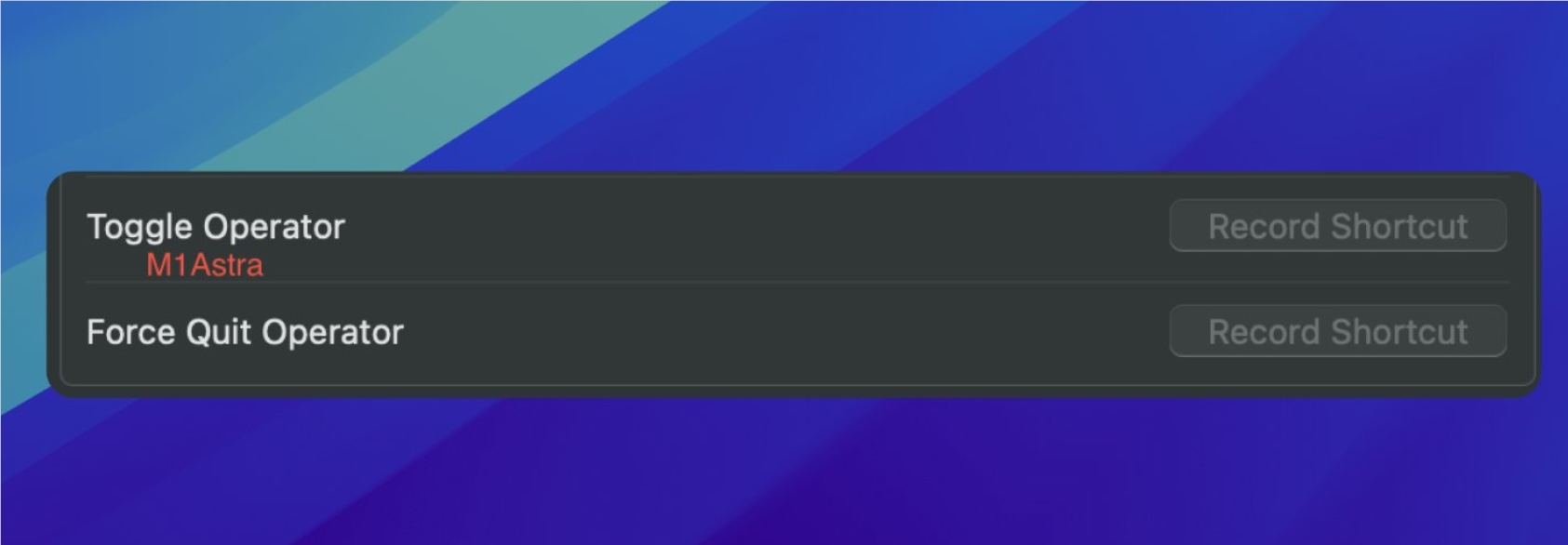

Laut Blaho plant OpenAI die Veröffentlichung von „Operator“ im Januar 2025. Er entdeckte, dass der ChatGPT-MacOS-Client von OpenAI über eine neue versteckte Option verfügt, die Tastenkombinationen für „Operator wechseln“ und „Beenden des Operators erzwingen“ definieren kann. Darüber hinaus sind auf der Website von OpenAI auch Informationen zum Thema „Operator“ erschienen, die jedoch noch nicht veröffentlicht wurden.

Blaho erwähnte auch, dass es auf der OpenAI-Website einige Tabellen gibt, die die Leistung von „Operator“ mit anderen computerbasierten KI-Systemen vergleichen, und dass diese Tabellen möglicherweise nur Platzhalter sind. Wenn die Daten in der Tabelle korrekt sind, ist die Leistung der Anzeige „Operator“ je nach ausgeführter Aufgabe nicht immer zuverlässig.

In einem Benchmark-Test von OSWorld erzielte der „OpenAI Computer Usage Agent (CUA)“ 38,1 %. Obwohl er das computergesteuerte Modell von Anthropic übertraf, lag er immer noch weit unter dem menschlichen Wert von 72,4 %. Die Leistung des Bedieners übertraf im WebVoyager-Test die menschliche Leistung, blieb jedoch im WebArena-Test hinter der menschlichen Leistung zurück. Bei einigen einfachen Aufgaben, wie der Registrierung bei einem Cloud-Dienstanbieter und dem Starten einer virtuellen Maschine, beträgt die Erfolgsquote des Betreibers nur 60 % und bei der Aufgabe, ein Bitcoin-Wallet zu erstellen, beträgt die Erfolgsquote nur 10 %.

Der Einstieg von OpenAI in den Markt für KI-Agenten erfolgt zu einer Zeit, in der auch andere Konkurrenten wie Anthropic und Google sich auf die Einführung ähnlicher Technologien stürzen. Obwohl KI-Agenten noch in den Kinderschuhen stecken, prognostiziert das Marktanalyseunternehmen Markets and Markets, dass der Markt für KI-Agenten bis 2030 einen Wert von 47,1 Milliarden US-Dollar haben wird.

Obwohl die aktuelle KI-Agententechnologie noch relativ einfach ist, haben einige Experten Bedenken hinsichtlich ihrer potenziellen Sicherheitsrisiken geäußert. Von Blaho offengelegte Daten zeigen, dass der Betreiber bei einigen Sicherheitsbewertungen gut abgeschnitten hat und in der Lage war, effektiv auf Tests zu reagieren, bei denen versucht wurde, das System dazu zu bringen, „illegale Aktivitäten“ durchzuführen oder nach „sensiblen personenbezogenen Daten“ zu suchen. Sicherheitstests gelten als einer der Gründe für den langen Entwicklungszyklus von Operator.

Wojciech Zaremba, Mitbegründer von OpenAI, kritisierte die mangelnde Sicherheit der von Anthropic veröffentlichten Agenten in den sozialen Medien. Er sagte, dass die Veröffentlichung eines ähnlichen Produkts durch OpenAI eine negative Reaktion hervorrufen könnte.

Highlight:

Das demnächst erscheinende „Operator“-Tool von OpenAI wird Computer autonom steuern, um Aufgaben wie das Schreiben von Code und das Buchen von Reisen auszuführen.

Durchgesickerten Informationen zufolge hat der Operator bei einigen Aufgaben eine relativ niedrige Erfolgsquote und schneidet schlechter ab als Menschen.

Obwohl Operator bei Sicherheitsbewertungen gut abgeschnitten hat, sind Experten besorgt über die potenziellen Sicherheitsrisiken.

Insgesamt zeigt das „Operator“-Tool von OpenAI das große Potenzial der KI-Technologie im Bereich der Automatisierung, steht aber auch vor Herausforderungen in Bezug auf technologische Reife und Sicherheit. Mit der kontinuierlichen Weiterentwicklung und Verbesserung der Technologie könnte „Operator“ in Zukunft die Art und Weise verändern, wie wir mit Computern interagieren, aber gleichzeitig müssen wir hinsichtlich seiner potenziellen Risiken vorsichtig sein.