mPLUG-Owl3 โมเดลขนาดใหญ่อเนกประสงค์อเนกประสงค์รุ่นล่าสุดของอาลีบาบา ได้ก่อให้เกิดพายุในสาขาปัญญาประดิษฐ์ ด้วยความสามารถในการทำความเข้าใจหลายรูปแบบอันทรงพลัง และมีประสิทธิภาพในการให้เหตุผลที่น่าทึ่ง สามารถเข้าใจเนื้อหาวิดีโอความยาว 2 ชั่วโมงได้ภายใน 4 วินาที และตอบคำถามต่างๆ ที่ผู้ใช้ถามได้อย่างแม่นยำ ซึ่งแสดงให้เห็นถึงประสิทธิภาพที่ยอดเยี่ยมในการทำความเข้าใจรูปภาพ วิดีโอ และข้อความ ความก้าวหน้าทางเทคโนโลยีนี้ไม่เพียงแต่เป็นก้าวสำคัญในแวดวงวิชาการเท่านั้น แต่ยังเป็นการประกาศถึงการเปลี่ยนแปลงในอนาคตในวิธีที่ AI โต้ตอบกับมนุษย์

ในยุคที่ข้อมูลล้นหลามเช่นนี้ เราใช้รูปภาพและวิดีโอเพื่อบันทึกชีวิตของเราและแบ่งปันความสุขของเราทุกวัน แต่คุณเคยคิดบ้างไหมว่าจะเกิดอะไรขึ้นหากมีเทคโนโลยีที่ทำให้เครื่องจักรไม่เพียงแต่เข้าใจรูปภาพและวิดีโอเหล่านี้ได้เหมือนมนุษย์ แต่ยังสื่อสารกับเราในเชิงลึกได้ด้วย

mPLUG-Owl3 รุ่นใหญ่อเนกประสงค์ล่าสุดที่ออกโดยทีมงานอาลีบาบา มีประสิทธิภาพอันน่าทึ่งและความสามารถในการเข้าใจ ช่วยให้เรารับชมภาพยนตร์ความยาว 2 ชั่วโมงได้ใน 4 วินาที นี่ไม่ใช่แค่โมเดลเท่านั้น แต่ยังคล้ายกันมากกว่า เป็นผู้ช่วย AI ที่สามารถเห็น ฟัง พูด และคิดได้

mPLUG-Owl3 ชื่อเหมือนนกฮูกใส่แว่น ฉลาด และตื่นตัว ความสามารถหลักคือการทำความเข้าใจลำดับภาพขนาดยาว ไม่ว่าจะเป็นชุดภาพถ่ายหรือวิดีโอก็สามารถเข้าใจเนื้อหาและแม้กระทั่งเข้าใจเนื้อเรื่องได้

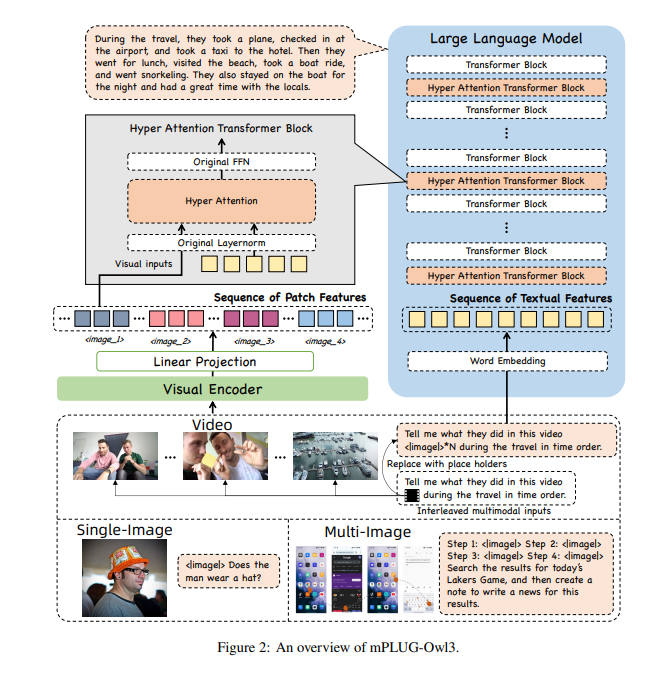

เพื่อให้ mPLUG-Owl3 ประมวลผลข้อมูลได้มากมาย นักวิจัยจึงได้ติดตั้งโมดูลซูเปอร์ใส่ใจสมองเป็นพิเศษ โมดูลนี้เปรียบเสมือนสมองชั้นยอดของ AI ที่สามารถประมวลผลข้อมูลภาพและภาษาไปพร้อมๆ กัน ทำให้ AI เข้าใจทั้งรูปภาพและข้อมูลข้อความที่เกี่ยวข้อง

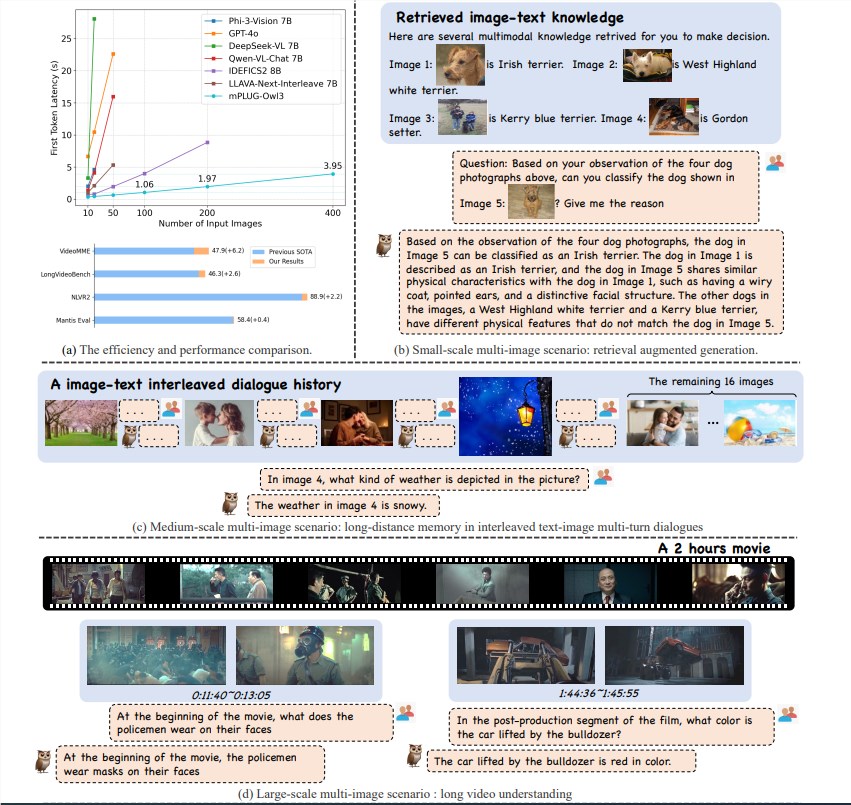

โมเดล mPLUG-Owl3 ได้สร้างความก้าวหน้าครั้งใหญ่ในด้านความเข้าใจหลายรูปแบบด้วยประสิทธิภาพการใช้เหตุผลที่ยอดเยี่ยม ไม่เพียงแต่เข้าถึง SOTA (State of the Art) ในการวัดประสิทธิภาพหลายสถานการณ์ เช่น ภาพเดียว หลายภาพ วิดีโอ ฯลฯ แต่ยังลด First Token Latency ลง 6 เท่า และจำนวนภาพที่สามารถประมวลผลได้ ด้วยกราฟิกการ์ด A100 เพียงใบเดียว เพิ่มขึ้น 8 เท่า สูงถึง 400 แผ่น

mPLUG-Owl3 สามารถเข้าใจความรู้หลายรูปแบบที่เข้ามาได้อย่างแม่นยำ และใช้เพื่อตอบคำถาม มันสามารถบอกคุณได้ว่าความรู้ชิ้นใดที่ใช้เป็นพื้นฐานในการตัดสิน เช่นเดียวกับพื้นฐานโดยละเอียดสำหรับการตัดสิน

mPLUG-Owl3 สามารถเข้าใจความสัมพันธ์ของเนื้อหาในสื่อต่างๆ ได้อย่างถูกต้อง และดำเนินการให้เหตุผลเชิงลึกได้ ไม่ว่าจะเป็นความแตกต่างด้านโวหารหรือการจดจำตัวอักษร ก็สามารถจัดการทุกอย่างได้อย่างง่ายดาย

mPLUG-Owl3 สามารถรับชมและทำความเข้าใจวิดีโอได้นานถึง 2 ชั่วโมง และสามารถเริ่มตอบคำถามของผู้ใช้ได้ภายใน 4 วินาที ไม่ว่าคำถามจะเกี่ยวข้องกับส่วนใดของวิดีโอก็ตาม

mPLUG-Owl3 ใช้โมดูล Hyper Attention น้ำหนักเบาเพื่อขยาย Transformer Block ให้เป็นโมดูลใหม่ที่สามารถโต้ตอบกับฟีเจอร์กราฟิกและข้อความและการสร้างแบบจำลองข้อความได้ การออกแบบนี้ช่วยลดจำนวนพารามิเตอร์ใหม่เพิ่มเติมที่แนะนำได้อย่างมาก ทำให้ฝึกโมเดลได้ง่ายขึ้น และยังปรับปรุงประสิทธิภาพการฝึกและการอนุมานอีกด้วย

จากการทดลองกับชุดข้อมูลที่หลากหลาย mPLUG-Owl3 ก็ได้ผลลัพธ์ SOTA จากการวัดประสิทธิภาพหลายรูปแบบสำหรับภาพเดียวส่วนใหญ่ ในการประเมินหลายภาพ จะเหนือกว่ารุ่นที่ปรับให้เหมาะสมที่สุดสำหรับสถานการณ์หลายภาพโดยเฉพาะ LongVideoBench เหนือกว่ารุ่นที่มีอยู่ โดยแสดงให้เห็นความสามารถอันยอดเยี่ยมในการทำความเข้าใจวิดีโอขนาดยาว

การเปิดตัว mPLUG-Owl3 ของ Alibaba ไม่เพียงเป็นการก้าวกระโดดทางเทคโนโลยีเท่านั้น แต่ยังมอบความเป็นไปได้ใหม่ๆ สำหรับการประยุกต์ใช้โมเดลขนาดใหญ่หลายรูปแบบอีกด้วย ในขณะที่เทคโนโลยีมีการปรับปรุงอย่างต่อเนื่อง เราหวังว่าจะได้ mPLUG-Owl3 ที่จะนำมาซึ่งความประหลาดใจอีกมากมายในอนาคต

ที่อยู่กระดาษ: https://arxiv.org/pdf/2408.04840

รหัส: https://github.com/X-PLUG/mPLUG-Owl/tree/main/mPLUG-Owl3

ประสบการณ์ออนไลน์: https://huggingface.co/spaces/mPLUG/mPLUG-Owl3

การเกิดขึ้นของ mPLUG-Owl3 ถือเป็นก้าวใหม่ในการพัฒนาเทคโนโลยีโมเดลขนาดใหญ่หลายรูปแบบ ความสามารถในการประมวลผลที่มีประสิทธิภาพและความสามารถในการทำความเข้าใจที่แม่นยำนั้นเปิดโอกาสในวงกว้างสำหรับการประยุกต์ใช้เทคโนโลยี AI ในอนาคต ฉันเชื่อว่าในขณะที่เทคโนโลยีเติบโตอย่างต่อเนื่อง mPLUG-Owl3 จะนำความสะดวกสบายและความประหลาดใจมาสู่ชีวิตของผู้คนมากขึ้น รอคอยที่จะพบกับแอปพลิเคชันที่เป็นนวัตกรรมใหม่เพิ่มเติมซึ่งใช้ mPLUG-Owl3