Anthropic API นำเสนอฟีเจอร์ใหม่ที่รอคอยมานาน นั่นคือการแคชคำใบ้ ซึ่งจะช่วยปรับปรุงประสิทธิภาพและความประหยัดของโมเดล Claude ได้อย่างมาก คุณสมบัตินี้ช่วยให้นักพัฒนาสามารถแคชข้อมูลบริบทที่ใช้บ่อยระหว่างการเรียก API ซึ่งช่วยลดการคำนวณซ้ำซ้อนและลดต้นทุนและเวลาแฝง สำหรับสถานการณ์แอปพลิเคชันที่จำเป็นต้องประมวลผลข้อมูลเชิงบริบทจำนวนมาก เช่น ตัวแทนการสนทนา ผู้ช่วยเขียนโค้ด และการประมวลผลเอกสารขนาดใหญ่ การแคชคำใบ้จะนำมาซึ่งการปรับปรุงประสิทธิภาพอย่างมาก ขณะนี้การอัปเดตนี้เผยแพร่ในรุ่นเบต้าสาธารณะสำหรับ Claude3.5 Sonnet และ Claude3 Haiku โดยมีแผนจะขยายไปยัง Claude3 Opus

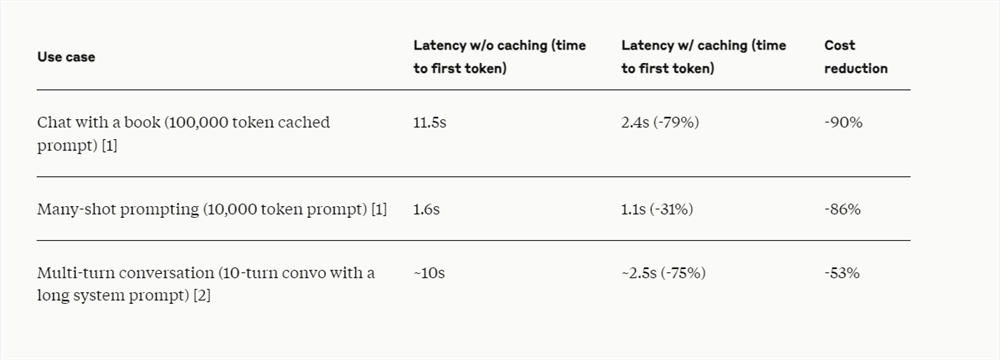

เมื่อเร็วๆ นี้ Anthropic API ได้เปิดตัวการแคชพร้อมท์ ดังนั้นนักพัฒนาจึงสามารถแคชข้อมูลบริบทที่ใช้โดยทั่วไประหว่างการเรียก API ได้แล้ว ด้วยการแคชคำใบ้ ลูกค้าสามารถมอบความรู้เบื้องหลังและผลลัพธ์ตัวอย่างแก่โมเดล Claude ขณะเดียวกันก็ลดต้นทุนของคำใบ้ยาวได้อย่างมาก ลดค่าธรรมเนียมได้มากถึง 90% และลดเวลาแฝงได้มากถึง 85%

ปัจจุบันฟีเจอร์นี้มีให้บริการใน Claude3.5Sonnet และ Claude3Haiku เวอร์ชันเบต้าสาธารณะ และจะรองรับ Claude3Opus ในอนาคตด้วย

คุณลักษณะการแคชพร้อมท์มีประโยชน์อย่างยิ่งในสถานการณ์ที่จำเป็นต้องอ้างอิงบริบทพร้อมท์จำนวนมากซ้ำๆ ในคำขอหลายรายการ เช่น ในพร็อกซีการสนทนาเพื่อลดต้นทุนและเวลาแฝงของการสนทนาที่ยาวนาน โดยเฉพาะอย่างยิ่งเมื่อมีคำสั่งที่ซับซ้อนหรือการอัปโหลดเอกสาร สามารถปรับปรุงผู้ช่วยเติมข้อความอัตโนมัติและฐานรหัสได้โดยเก็บเวอร์ชันสรุปของฐานรหัสไว้ในพรอมต์ เมื่อทำงานกับเอกสารขนาดใหญ่ พรอมต์แคชช่วยให้สามารถฝังเนื้อหาที่มีรูปแบบยาวโดยสมบูรณ์โดยไม่ต้องเพิ่มเวลาตอบสนอง นอกจากนี้ สำหรับระบบที่เกี่ยวข้องกับหลายรอบ การเรียกเครื่องมือและการวนซ้ำ การค้นหาพร็อกซีที่เปลี่ยนแปลงและสถานการณ์การใช้งานเครื่องมือ การแคชพร้อมท์ยังสามารถปรับปรุงประสิทธิภาพได้อย่างมาก

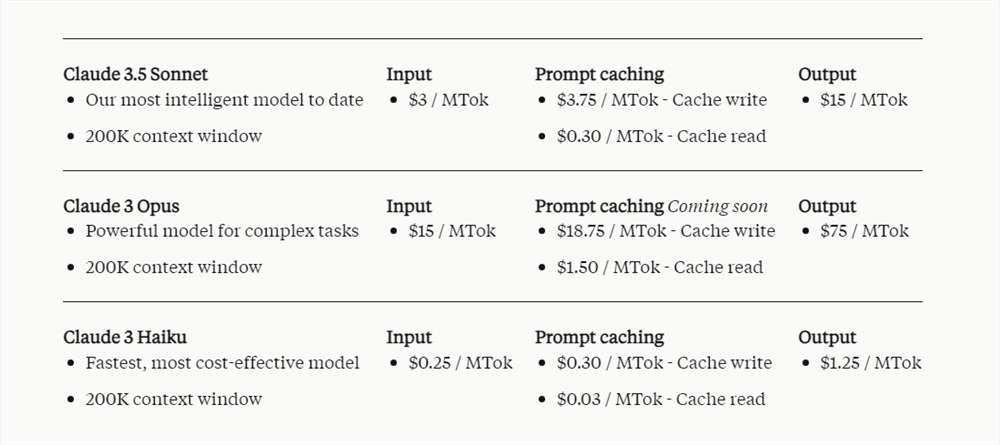

ราคาเคล็ดลับแคชขึ้นอยู่กับจำนวนโทเค็นอินพุตที่แคชไว้และความถี่ในการใช้งาน การเขียนลงในแคชมีราคาสูงกว่าราคาโทเค็นอินพุตพื้นฐาน 25% ในขณะที่การใช้เนื้อหาที่แคชไว้จะมีต้นทุนน้อยกว่าอย่างมาก เพียง 10% ของราคาโทเค็นอินพุตพื้นฐาน

มีรายงานว่า Notion ในฐานะลูกค้าของ Anthropic API ได้รวมฟังก์ชันแคชทันทีเข้ากับผู้ช่วยปัญญาประดิษฐ์ Notion AI ด้วยการลดต้นทุนและเพิ่มความเร็ว Notion จึงเพิ่มประสิทธิภาพการดำเนินงานภายในและนำประสบการณ์ที่ล้ำหน้าและรวดเร็วยิ่งขึ้นมาสู่ผู้ใช้

การเปิดตัวฟังก์ชัน prompt caching สะท้อนให้เห็นถึงความพยายามของ Anthropic ในการปรับปรุงประสิทธิภาพของโมเดล Claude และลดต้นทุนของผู้ใช้ ส่งผลให้นักพัฒนาได้รับโซลูชัน AI ที่คุ้มค่ามากขึ้น และปรับปรุงการใช้งานจริงของโมเดล Claude ในสถานการณ์การใช้งานต่างๆ ต่อไป เรื่องราวความสำเร็จของ Notion ยังพิสูจน์คุณค่าเชิงปฏิบัติของฟีเจอร์นี้อีกด้วย