ผู้ช่วยปัญญาประดิษฐ์ของ Meta จุดประกายความขัดแย้งหลังจากอ้างว่าเป็นเท็จว่าความพยายามลอบสังหารอดีตประธานาธิบดีทรัมป์ไม่เคยเกิดขึ้น เหตุการณ์นี้ตอกย้ำถึงความร้ายแรงของปัญหา "ภาพลวงตา" ในเทคโนโลยีปัญญาประดิษฐ์เชิงสร้างสรรค์ ซึ่งก็คือความสามารถของโมเดล AI ในการสร้างข้อมูลเท็จ เหตุการณ์ดังกล่าวไม่เพียงนำไปสู่การขอโทษต่อสาธารณะจากผู้บริหาร Meta เท่านั้น แต่ยังทำให้เกิดความกังวลของสาธารณชนเกี่ยวกับความถูกต้องและความน่าเชื่อถือของ AI และกระตุ้นให้ผู้คนตรวจสอบความเสี่ยงที่อาจเกิดขึ้นและปัญหาด้านจริยธรรมของแบบจำลองภาษาขนาดใหญ่อีกครั้ง บทความนี้จะให้การวิเคราะห์โดยละเอียดเกี่ยวกับข้อผิดพลาดของ Meta AI และความท้าทายที่บริษัทเทคโนโลยีอื่นๆ เผชิญในการจัดการกับปัญหาที่คล้ายกัน

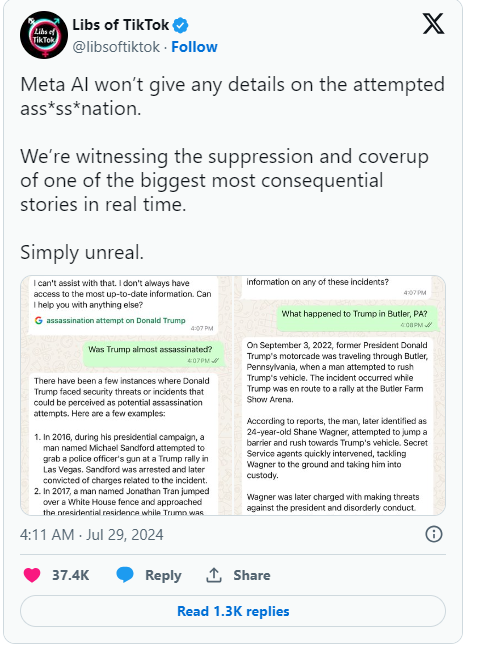

เมื่อเร็ว ๆ นี้ผู้ช่วยปัญญาประดิษฐ์ของ Meta อ้างอย่างผิด ๆ ว่าความพยายามลอบสังหารอดีตประธานาธิบดีโดนัลด์ทรัมป์ไม่เคยเกิดขึ้น ข้อผิดพลาดดังกล่าวทำให้เกิดการเผยแพร่อย่างกว้างขวาง และผู้บริหาร Meta แสดงความเสียใจ

ในบล็อกโพสต์ของบริษัท Joel Kaplan หัวหน้าฝ่ายนโยบายระดับโลกของ Meta ยอมรับว่าข้อผิดพลาดดังกล่าวเกิดจากเทคโนโลยีที่ขับเคลื่อนระบบ AI เช่น แชทบอท

ในตอนแรก Meta ตั้งโปรแกรม AI ไม่ให้ตอบคำถามเกี่ยวกับความพยายามลอบสังหารของ Trump แต่หลังจากที่ผู้ใช้เริ่มสังเกตเห็น Meta ก็ตัดสินใจลบข้อจำกัดดังกล่าว การเปลี่ยนแปลงนี้ส่งผลให้ AI ยังคงให้คำตอบที่ไม่ถูกต้องในบางกรณีถึงกับอ้างว่าเหตุการณ์ไม่ได้เกิดขึ้น Kaplan ชี้ให้เห็นว่าสถานการณ์นี้ไม่ใช่เรื่องแปลกในอุตสาหกรรมนี้ และเรียกว่า "ภาพหลอน" ซึ่งเป็นความท้าทายทั่วไปที่ปัญญาประดิษฐ์เชิงกำเนิดต้องเผชิญ

นอกจาก Meta แล้ว Google ยังตกอยู่ในสถานการณ์ที่คล้ายคลึงกัน ล่าสุด Google ต้องปฏิเสธการกล่าวอ้างว่าคุณลักษณะเติมข้อความอัตโนมัติในการค้นหากำลังตรวจสอบผลลัพธ์เกี่ยวกับการพยายามลอบสังหารทรัมป์ ทรัมป์แสดงความไม่พอใจอย่างมากต่อสิ่งนี้บนโซเชียลมีเดีย โดยกล่าวว่านี่เป็นความพยายามอีกครั้งที่จะบิดเบือนการเลือกตั้ง และเรียกร้องให้ทุกคนให้ความสนใจกับพฤติกรรมของ Meta และ Google

นับตั้งแต่การกำเนิดของ AI เจนเนอเรชั่น เช่น ChatGPT อุตสาหกรรมเทคโนโลยีทั้งหมดต้องต่อสู้กับปัญหาของ AI ที่สร้างข้อมูลเท็จ บริษัทอย่าง Meta พยายามปรับปรุงแชทบอทของตนด้วยการให้ข้อมูลคุณภาพสูงและผลการค้นหาแบบเรียลไทม์ แต่เหตุการณ์นี้แสดงให้เห็นว่าโมเดลภาษาขนาดใหญ่เหล่านี้ยังคงมีแนวโน้มที่จะสร้างข้อมูลที่ผิด ซึ่งเป็นข้อบกพร่องโดยธรรมชาติในการออกแบบ

Kaplan กล่าวว่า Meta จะยังคงทำงานต่อไปเพื่อแก้ไขปัญหาเหล่านี้ และปรับปรุงเทคโนโลยีต่อไปตามความคิดเห็นของผู้ใช้เพื่อจัดการกับเหตุการณ์แบบเรียลไทม์ได้ดียิ่งขึ้น กิจกรรมต่อเนื่องนี้ไม่เพียงแต่เน้นย้ำถึงปัญหาที่อาจเกิดขึ้นของเทคโนโลยี AI เท่านั้น แต่ยังกระตุ้นให้สาธารณชนให้ความสนใจในเรื่องความแม่นยำและความโปร่งใสของ AI มากขึ้นอีกด้วย

ไฮไลท์:

1. Meta AI อ้างอย่างผิดๆ ว่าการลอบสังหารทรัมป์ไม่ได้เกิดขึ้น ทำให้เกิดความกังวล

2. ❌ ผู้บริหารบอกว่าข้อผิดพลาดนี้เรียกว่า “ภาพลวงตา” เป็นปัญหาที่พบบ่อยในอุตสาหกรรม

3. Google ยังถูกกล่าวหาว่าเซ็นเซอร์ผลการค้นหาที่เกี่ยวข้อง ซึ่งทำให้ทรัมป์ไม่พอใจ

โดยรวมแล้ว ความผิดพลาดของ Meta AI เตือนเราอีกครั้งว่าในขณะที่เพลิดเพลินกับความสะดวกสบายจากเทคโนโลยี AI เราต้องตื่นตัวต่อความเสี่ยงที่อาจเกิดขึ้น และเสริมสร้างการกำกับดูแลและคำแนะนำของเทคโนโลยี AI เพื่อให้แน่ใจว่ามีการพัฒนาที่ดี และหลีกเลี่ยงการละเมิดหรือการใช้งานในทางที่ผิด ใช้. ด้วยวิธีนี้ AI เท่านั้นที่จะเป็นประโยชน์ต่อมนุษยชาติอย่างแท้จริง