ในด้านการพัฒนาซอฟต์แวร์ การใช้เครื่องมือเข้ารหัส AI กำลังก่อให้เกิดการปฏิวัติที่เงียบงัน ทีมพัฒนาใช้การเข้ารหัสที่ได้รับความช่วยเหลือจาก AI อย่างกว้างขวาง อย่างไรก็ตาม ฝ่ายบริหารของบริษัทยังขาดการควบคุมดูแลและการควบคุมการใช้เครื่องมือ AI ที่มีประสิทธิภาพ สิ่งนี้ทำให้เกิด "เกมแมวจับหนู" ระหว่างนักพัฒนาและผู้บริหารเกี่ยวกับการใช้เครื่องมือ AI และความเสี่ยงด้านความปลอดภัยที่ตามมา

ในโลกของเทคโนโลยี มีเกมแมวจับหนูเกิดขึ้นระหว่างผู้พัฒนาและผู้บริหาร ตัวละครเอกของเกมนี้คือเครื่องมือเข้ารหัส AI ที่ถูกบริษัทแบนอย่างชัดเจน แต่นักพัฒนายังคงใช้งานอย่างเงียบๆ

แม้ว่า 15% ของบริษัทจะห้ามการใช้เครื่องมือเขียนโค้ด AI อย่างชัดเจน แต่ทีมพัฒนาเกือบทั้งหมด (99%) ก็ใช้งานเครื่องมือเหล่านี้ ตามการวิจัยระดับโลกครั้งใหม่จากบริษัทรักษาความปลอดภัยบนคลาวด์ Checkmarx ปรากฏการณ์นี้เผยให้เห็นถึงความท้าทายในการควบคุมการใช้ generative AI

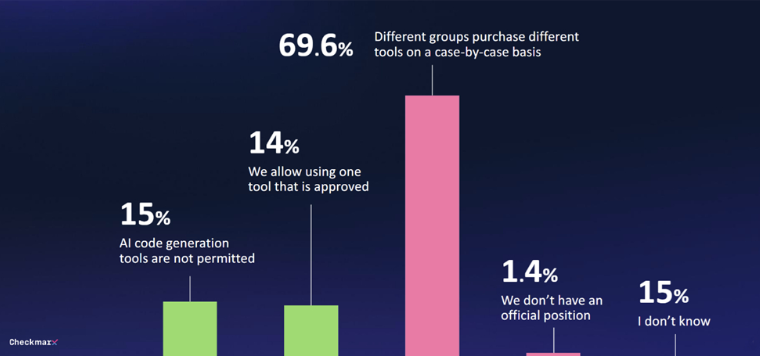

มีบริษัทเพียง 29% เท่านั้นที่มีรูปแบบการกำกับดูแลสำหรับเครื่องมือ AI เชิงสร้างสรรค์ ใน 70% ของกรณี ไม่มีกลยุทธ์ที่เป็นหนึ่งเดียว และการตัดสินใจซื้อจะดำเนินการเฉพาะกิจโดยแผนกต่างๆ สถานการณ์นี้ทำให้ฝ่ายบริหารควบคุมการใช้เครื่องมือเข้ารหัส AI ได้ยาก

ด้วยความนิยมของเครื่องมือเข้ารหัส AI ปัญหาด้านความปลอดภัยจึงมีความโดดเด่นมากขึ้น 80% ของผู้ตอบแบบสอบถามกังวลเกี่ยวกับภัยคุกคามที่อาจเกิดขึ้นที่นักพัฒนาอาจนำมาเมื่อใช้ AI โดยเฉพาะอย่างยิ่ง 60% ที่แสดงความกังวลเกี่ยวกับ "ภาพหลอน" ที่เกิดจาก AI

แม้จะมีความกังวล แต่ความสนใจในศักยภาพของ AI ยังคงแข็งแกร่ง 47% ของผู้ตอบแบบสอบถามเปิดให้ AI ทำการเปลี่ยนแปลงโค้ดโดยไม่ได้รับการดูแล มีเพียง 6% เท่านั้นที่กล่าวว่าพวกเขาจะไม่ไว้วางใจมาตรการรักษาความปลอดภัยของ AI ในสภาพแวดล้อมซอฟต์แวร์

“การตอบสนองจาก CISO ระดับโลกเหล่านี้เผยให้เห็นถึงความเป็นจริงที่นักพัฒนาใช้ AI ในการพัฒนาแอปพลิเคชัน แม้ว่าพวกเขาจะไม่สามารถสร้างโค้ดที่ปลอดภัยโดยใช้ AI ได้อย่างน่าเชื่อถือ ซึ่งหมายความว่าทีมรักษาความปลอดภัยจำเป็นต้องต่อสู้กับการโจมตีใหม่ๆ ที่มีช่องโหว่มากมาย” Tzruya กล่าว ”

รายงานล่าสุดจาก Work Trends Index ของ Microsoft แสดงให้เห็นข้อค้นพบที่คล้ายกัน โดยพนักงานจำนวนมากใช้เครื่องมือ AI ของตัวเองแต่ไม่มีเครื่องมือให้เลย บ่อยครั้งที่พวกเขาไม่ได้พูดถึงการใช้งานนี้ ซึ่งเป็นอุปสรรคต่อการบูรณาการอย่างเป็นระบบของ generative AI เข้ากับกระบวนการทางธุรกิจ

แม้จะมีข้อห้ามอย่างชัดเจน แต่ 99% ของทีมพัฒนายังคงใช้เครื่องมือ AI เพื่อสร้างโค้ด มีบริษัทเพียง 29% เท่านั้นที่สร้างกลไกการกำกับดูแลสำหรับการใช้ generative AI ใน 70% ของกรณี การตัดสินใจเกี่ยวกับการใช้เครื่องมือ AI โดยแผนกต่างๆ จะดำเนินการแบบเฉพาะกิจ ในขณะเดียวกัน ความกังวลด้านความปลอดภัยก็เพิ่มมากขึ้น 47% ของผู้ตอบแบบสอบถามเปิดให้ AI ทำการเปลี่ยนแปลงโค้ดโดยไม่ได้รับการดูแล ทีมรักษาความปลอดภัยต้องเผชิญกับความท้าทายในการจัดการกับโค้ดที่สร้างโดย AI ที่อาจมีความเสี่ยงจำนวนมาก

"เกมแมวจับหนู" ระหว่างนักพัฒนาและผู้บริหารยังคงดำเนินต่อไป และเราจะต้องรอดูว่าอนาคตของเครื่องมือเข้ารหัส AI จะดำเนินต่อไปอย่างไร

การใช้เครื่องมือเข้ารหัส AI กลายเป็นเทรนด์ แต่ความเสี่ยงด้านความปลอดภัยที่เกิดขึ้นนั้นไม่สามารถละเลยได้ บริษัทต่างๆ จำเป็นต้องสร้างกลไกการกำกับดูแลที่ดีเพื่อสร้างสมดุลระหว่างการปรับปรุงประสิทธิภาพที่เกิดจาก AI กับความเสี่ยงด้านความปลอดภัยที่อาจเกิดขึ้น เพื่อปรับตัวให้เข้ากับคลื่นเทคโนโลยีนี้ได้ดียิ่งขึ้น