รายงานการวิจัยล่าสุดที่เผยแพร่โดย Google เตือนว่าปัญญาประดิษฐ์แบบกำเนิด (GenAI) กำลังสร้างมลพิษให้กับอินเทอร์เน็ตด้วยเนื้อหาที่เป็นเท็จ รายงานชี้ให้เห็นว่ามีกรณีการใช้ GenAI ในทางที่ผิดมากมาย ตั้งแต่การดัดแปลงภาพบุคคลไปจนถึงการสร้างหลักฐาน ซึ่งส่วนใหญ่มีจุดประสงค์เพื่อมีอิทธิพลต่อความคิดเห็นของประชาชน การฉ้อโกง หรือผลกำไร Google เองก็กลายเป็นผู้สร้างข้อมูลที่บิดเบือนเนื่องจากผลิตภัณฑ์ AI ของตนที่ให้คำแนะนำที่ไร้สาระ ซึ่งทำให้คำเตือนน่าตกใจยิ่งขึ้นและกระตุ้นให้ผู้คนคิดอย่างลึกซึ้งเกี่ยวกับความเสี่ยงที่อาจเกิดขึ้นของ GenAI

เมื่อเร็ว ๆ นี้ นักวิจัยจาก Google เตือนว่าปัญญาประดิษฐ์แบบกำเนิด (GenAI) กำลังทำลายอินเทอร์เน็ตด้วยเนื้อหาปลอม นี่ไม่ใช่แค่คำเตือนเท่านั้น แต่ยังเป็นเวลาแห่งการไตร่ตรองตนเองด้วย

น่าแปลกที่ Google มีบทบาทสองประการใน "สงครามระหว่างความจริงและความเท็จ" ในแง่หนึ่ง มันเป็นผู้สนับสนุนที่สำคัญของ generative AI และในทางกลับกัน มันยังเป็นผู้ผลิตข้อมูลที่บิดเบือนอีกด้วย คุณลักษณะภาพรวม AI ของ Google มีคำแนะนำที่ไร้สาระ เช่น "ทากาวบนพิซซ่า" และ "กินก้อนหิน" และในที่สุดข้อความที่ผิดพลาดเหล่านี้ก็ต้องถูกลบด้วยตนเอง

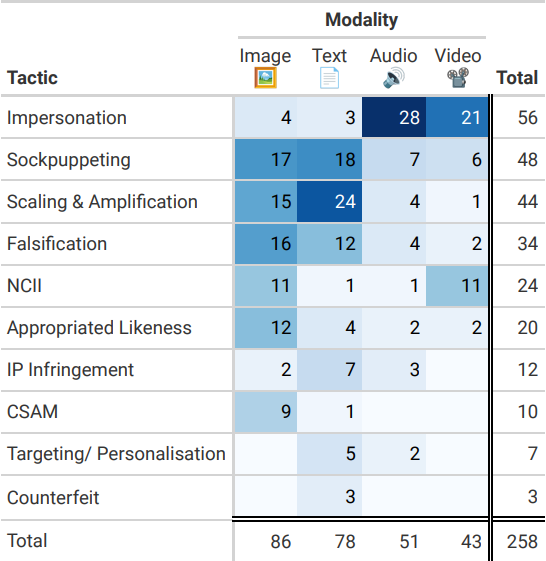

ทีมวิจัยของ Google ดำเนินการตรวจสอบรายงานข่าว 200 ฉบับในเชิงลึกเกี่ยวกับการละเมิด AI ทั่วไป และพบว่าการแก้ไขภาพบุคคลและการสร้างหลักฐานเป็นวิธีการละเมิดที่พบบ่อยที่สุด จุดประสงค์ของการกระทำเหล่านี้ไม่มีอะไรมากไปกว่าการโน้มน้าวความคิดเห็นของประชาชน การฉ้อโกง หรือการหาผลกำไร แม้ว่าความเสี่ยงของ generative AI ยังไม่เพิ่มขึ้นถึงระดับ "ภัยคุกคามที่มีอยู่" แต่สิ่งเหล่านี้คือสิ่งที่เกิดขึ้นในขณะนี้และอาจแย่ลงในอนาคต

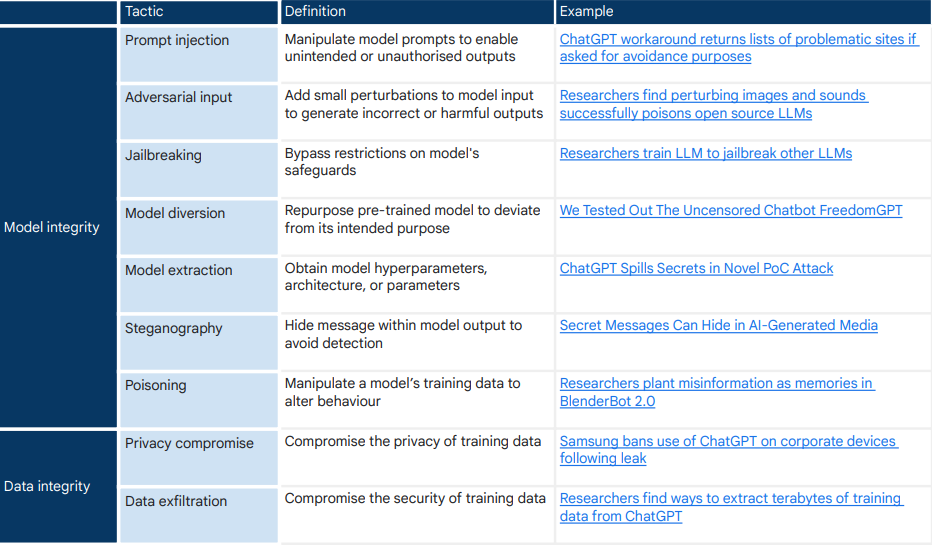

นักวิจัยพบว่ากรณีการละเมิด GenAI ส่วนใหญ่เป็นการใช้งานระบบตามปกติ และไม่เกี่ยวข้องกับพฤติกรรม "การแหกคุก" "การดำเนินงานประจำ" ประเภทนี้คิดเป็น 90% ความพร้อมใช้งานที่กว้างขวาง การเข้าถึงได้ และความสมจริงเกินจริงของ GenAI ทำให้เกิดการละเมิดในระดับล่างอย่างไม่มีที่สิ้นสุด ค่าใช้จ่ายในการสร้างข้อมูลเท็จต่ำเกินไป!

เนื้อหาการวิจัยของ Google ส่วนใหญ่มาจากรายงานของสื่อ หมายความว่าข้อสรุปการวิจัยมีความลำเอียงจากสื่อใช่หรือไม่ สื่อมีแนวโน้มที่จะรายงานเหตุการณ์ที่น่าตื่นเต้นมากกว่า ซึ่งอาจทำให้ชุดข้อมูลมีอคติต่อการละเมิดบางประเภท 404Media ชี้ให้เห็นว่ามีการละเมิด Generative AI ที่ไม่ได้รับการรายงานจำนวนมากซึ่งเรายังไม่ทราบ

“รั้ว” ของเครื่องมือ AI สามารถหลีกเลี่ยงได้อย่างชาญฉลาดด้วยเคล็ดลับบางประการ ตัวอย่างเช่น เครื่องมือโคลนเสียง AI ของ ElevenLabs สามารถเลียนแบบเสียงของเพื่อนร่วมงานหรือคนดังได้อย่างแม่นยำในระดับสูง ผู้ใช้ Civitai สามารถสร้างภาพคนดังที่ AI สร้างขึ้น และแม้ว่าแพลตฟอร์มดังกล่าวจะมีนโยบายต่อต้าน NCII (ภาพที่ใกล้ชิดโดยไม่ได้รับความยินยอม) แต่ก็ไม่มีอะไรหยุดผู้ใช้จากการใช้เครื่องมือโอเพ่นซอร์สเพื่อสร้าง NCII บนเครื่องของตนเอง

เมื่อข้อมูลเท็จแพร่กระจาย ความวุ่นวายบนอินเทอร์เน็ตจะนำมาซึ่งการทดสอบครั้งใหญ่ต่อความสามารถของผู้คนในการแยกแยะระหว่างความจริงและความเท็จ เราจะติดอยู่ในสภาวะแห่งความสงสัยอยู่ตลอดเวลาว่า "นี่เป็นเรื่องจริงหรือไม่" หากปล่อยทิ้งไว้โดยไม่ได้รับการจัดการ การปนเปื้อนของข้อมูลสาธารณะโดยเนื้อหาที่สร้างโดย AI อาจขัดขวางการดึงข้อมูลและบิดเบือนการรับรู้โดยรวมเกี่ยวกับความเป็นจริงทางสังคมการเมืองหรือความเห็นพ้องต้องกันทางวิทยาศาสตร์

Google มีส่วนร่วมในการเผยแพร่เนื้อหาเท็จที่เกิดจาก AI กำเนิด กระสุนที่ยิงเมื่อหลายปีก่อนในที่สุดก็โดนเขาระหว่างคิ้วในวันนี้ การวิจัยของ Google อาจเป็นจุดเริ่มต้นของการเอาชีวิตรอดและปลุกสังคมอินเทอร์เน็ตทั้งหมด

ที่อยู่กระดาษ: https://arxiv.org/pdf/2406.13843

รายงานของ Google นี้ส่งเสียงเตือนถึงการพัฒนา GenAI ในอนาคตอย่างไม่ต้องสงสัย วิธีสร้างสมดุลระหว่างการพัฒนาเทคโนโลยีและการควบคุมความเสี่ยง และวิธีตอบสนองต่อการแพร่กระจายของข้อมูลเท็จที่ GenAI นำเสนออย่างมีประสิทธิภาพ ถือเป็นความท้าทายที่ชุมชนและสังคมเทคโนโลยีทั่วโลกต้องเผชิญ เราหวังว่าจะมีการวิจัยและดำเนินการเพิ่มเติมเพื่อร่วมกันรักษาความถูกต้องและความบริสุทธิ์ของอินเทอร์เน็ต