Deepfakes ในฐานะปัญญาประดิษฐ์ที่พัฒนาอย่างรวดเร็วซึ่งกำลังพัฒนาอย่างรวดเร็ว กำลังก่อให้เกิดภัยคุกคามที่ร้ายแรงยิ่งขึ้นต่อเศรษฐกิจและความมั่นคงโลก ความเสียหายทางเศรษฐกิจที่เกิดจากสิ่งนี้คาดว่าจะเพิ่มขึ้นอย่างมีนัยสำคัญ โดยอุตสาหกรรมการธนาคารและบริการทางการเงินเป็นเป้าหมายหลัก บทความนี้จะวิเคราะห์แนวโน้มการพัฒนาอย่างรวดเร็วของเทคโนโลยี Deepfake ความเสี่ยงและความท้าทายที่เกิดกับองค์กรและบุคคล และสำรวจปัญหาที่องค์กรต้องเผชิญเมื่อต้องรับมือกับภัยคุกคามที่กำลังเกิดขึ้นนี้

เนื่องจากเป็นหนึ่งในรูปแบบปัญญาประดิษฐ์ที่เติบโตเร็วที่สุด การสูญเสียที่เกี่ยวข้องกับ Deepfakes คาดว่าจะเพิ่มขึ้นจาก 12.3 พันล้านดอลลาร์สหรัฐในปี 2566 เป็น 40 พันล้านดอลลาร์สหรัฐในปี 2570 หรือคิดเป็นอัตราการเติบโต 32% ต่อปี Deloitte คาดว่า Deepfake จะแพร่หลายมากขึ้นในอีกไม่กี่ปีข้างหน้า โดยธนาคารและบริการทางการเงินเป็นเป้าหมายสำคัญ

Deepfakes อยู่ในระดับแนวหน้าของการโจมตี AI ของฝ่ายตรงข้าม โดยเพิ่มขึ้น 3,000% ในปีที่แล้วเพียงปีเดียว Deepfakes คาดว่าจะเพิ่มขึ้น 50% ถึง 60% ภายในปี 2567 โดยคาดว่าจะมีเหตุการณ์ดังกล่าว 140,000-150,000 ครั้งทั่วโลกในปีนี้

แอปพลิเคชัน เครื่องมือ และแพลตฟอร์ม AI เจนเนอเรชั่นล่าสุดมอบทุกสิ่งที่จำเป็นแก่ผู้โจมตีเพื่อสร้างวิดีโอปลอม เสียงที่แอบอ้าง และเอกสารฉ้อโกงได้อย่างรวดเร็วและคุ้มค่า รายงาน Speech Intelligence และความปลอดภัยประจำปี 2024 ของ Pindrops ประมาณการว่าการฉ้อโกงแบบ Deepfake ที่กำหนดเป้าหมายไปที่ศูนย์ติดต่อมีค่าใช้จ่ายประมาณ 5 พันล้านดอลลาร์ต่อปี รายงานของพวกเขาเน้นย้ำถึงภัยคุกคามร้ายแรงที่เกิดขึ้นกับบริการทางการเงินและธนาคาร

Bloomberg รายงานเมื่อปีที่แล้วว่า “อุตสาหกรรมกระท่อมทั้งหมดได้ปรากฏตัวบนเว็บมืดเพื่อขายสแกมเมอร์ที่มีราคาตั้งแต่ 20 ดอลลาร์ไปจนถึงหลายพันดอลลาร์” เมื่อเร็ว ๆ นี้ อินโฟกราฟิกที่อิงจากรายงานการฉ้อโกงข้อมูลประจำตัวประจำปี 2023 ของ Sumsub ให้มุมมองทั่วโลกเกี่ยวกับการเติบโตอย่างรวดเร็วของการฉ้อโกง AI .

หนึ่งในสามขององค์กรไม่มีกลยุทธ์ในการจัดการกับความเสี่ยงของการโจมตีด้วย AI ของฝ่ายตรงข้าม ซึ่งมักจะเริ่มต้นด้วยการปลอมแปลงผู้บริหารหลักของตนอย่างลึกซึ้ง การวิจัยใหม่จาก Ivanti พบว่า 30% ขององค์กรไม่มีแผนที่จะระบุและป้องกันการโจมตีจาก AI ของฝ่ายตรงข้าม

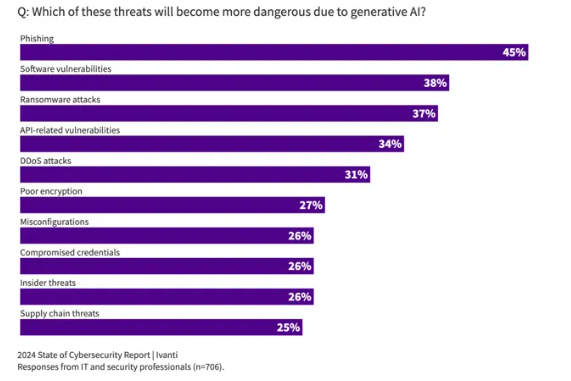

รายงานสถานะความปลอดภัยทางไซเบอร์ประจำปี 2024 ของ Ivanti พบว่า 74% ของบริษัทที่ตอบแบบสำรวจได้เห็นหลักฐานภัยคุกคามจาก AI คนส่วนใหญ่อย่างท่วมท้น (89%) เชื่อว่าภัยคุกคามจาก AI เพิ่งเริ่มต้น จากการสัมภาษณ์ CISO, CIO และผู้นำด้านไอทีส่วนใหญ่ Ivanti พบว่า 60% กังวลว่าองค์กรของตนไม่ได้เตรียมพร้อมที่จะป้องกันภัยคุกคามและการโจมตีจาก AI การใช้ Deepfakes เป็นส่วนหนึ่งของกลยุทธ์ที่จัดทำขึ้น เช่น ฟิชชิ่ง ช่องโหว่ของซอฟต์แวร์ แรนซัมแวร์ และช่องโหว่ที่เกี่ยวข้องกับ API กำลังกลายเป็นเรื่องปกติมากขึ้น ซึ่งสอดคล้องกับภัยคุกคามที่ผู้เชี่ยวชาญด้านความปลอดภัยคาดหวังว่าจะมีอันตรายมากขึ้นเนื่องจากปัญญาประดิษฐ์รุ่นใหม่

เมื่อต้องเผชิญกับการพัฒนาอย่างรวดเร็วของเทคโนโลยีการปลอมแปลงข้อมูลเชิงลึกและความเสี่ยงมหาศาลที่เกิดขึ้น บริษัทต่างๆ จำเป็นต้องใช้มาตรการรับมืออย่างแข็งขัน เสริมสร้างการป้องกันด้านความปลอดภัย และปรับปรุงการตระหนักรู้ถึงความเสี่ยงของพนักงาน เพื่อลดความสูญเสียอย่างมีประสิทธิภาพและรับประกันความปลอดภัยของตนเอง ความก้าวหน้าของเทคโนโลยียังต้องได้รับการพัฒนาควบคู่ไปกับการปรับปรุงมาตรการรักษาความปลอดภัยเพื่อป้องกันการนำเทคโนโลยีไปใช้ในทางที่ผิด