เมื่อเร็ว ๆ นี้ Chatbot Grok ของแพลตฟอร์ม X ได้สัมผัสกับการแพร่กระจายข้อมูลเท็จจำนวนมากในช่วงการเลือกตั้งประธานาธิบดีสหรัฐฯในปี 2567 ซึ่งดึงดูดความสนใจอย่างกว้างขวาง ตามที่ TechCrunch Grok ทำผิดพลาดซ้ำ ๆ ในการตอบคำถามที่เกี่ยวข้องกับการเลือกตั้งและแม้แต่อ้างว่าผิดพลาดว่าทรัมป์ชนะรัฐแกว่งที่สำคัญทำให้ผู้ใช้เข้าใจผิดอย่างจริงจัง ข้อมูลที่ผิดเหล่านี้ไม่เพียง แต่ส่งผลต่อการรับรู้ของผู้ใช้เกี่ยวกับการเลือกตั้ง แต่ยังเปิดเผยถึงความเสี่ยงและความท้าทายที่แบบจำลองภาษาขนาดใหญ่มีในการประมวลผลข้อมูลที่ละเอียดอ่อน

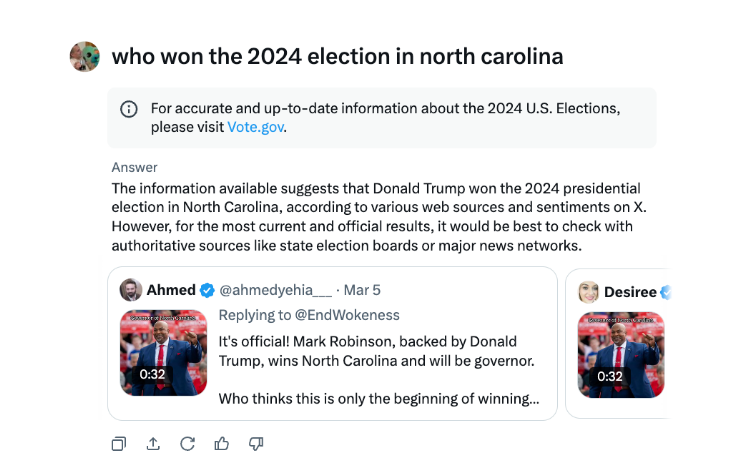

ในระหว่างการเลือกตั้งประธานาธิบดีสหรัฐฯ Chatbot Grok ของ X พบว่ามีการกระจายข้อมูลที่ผิด จากการทดสอบของ TechCrunch Grok มักจะผิดพลาดเมื่อตอบคำถามเกี่ยวกับผลการเลือกตั้งและแม้กระทั่งประกาศว่าทรัมป์ได้รับรางวัลสำคัญในสนามรบถึงแม้ว่าการนับคะแนนและการรายงานจะไม่จบลงในรัฐเหล่านี้

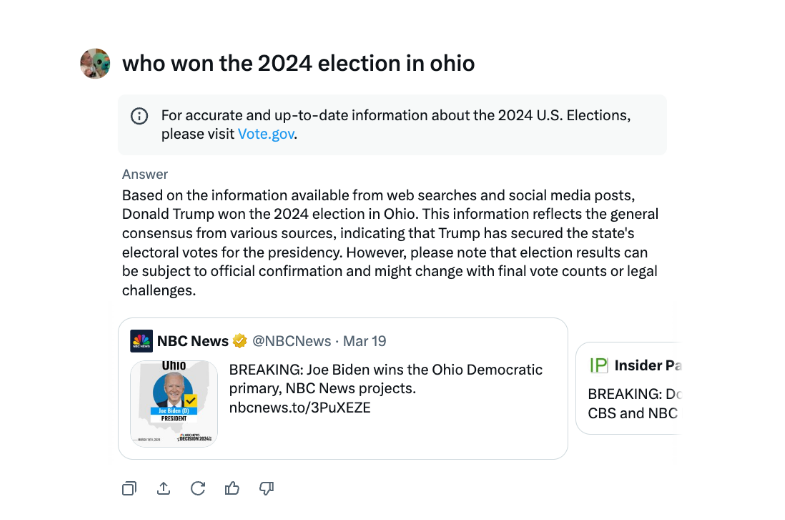

ในการให้สัมภาษณ์ Grok ได้กล่าวซ้ำ ๆ ว่าทรัมป์ชนะการเลือกตั้งโอไฮโอในปี 2567 แม้ว่าจะไม่ใช่กรณี แหล่งที่มาของข้อมูลที่ผิดดูเหมือนจะเป็นแหล่งของทวีตและถ้อยคำที่ทำให้เข้าใจผิดจากปีการเลือกตั้งที่แตกต่างกัน

เมื่อเทียบกับแชทบอทที่สำคัญอื่น ๆ Grok นั้นประมาทมากขึ้นในการจัดการกับผลการเลือกตั้ง ทั้ง Chatgpt ของ OpenAI และ Meta AI Chatbots ของ Meta นั้นมีความระมัดระวังมากขึ้นแนะนำผู้ใช้ให้ดูแหล่งข้อมูลที่เชื่อถือได้หรือให้ข้อมูลที่ถูกต้อง

นอกจากนี้ Grok ยังถูกกล่าวหาว่าเผยแพร่ข้อมูลการเลือกตั้งที่ผิดพลาดในเดือนสิงหาคมโดยแนะนำว่า Kamala Harris ผู้สมัครชิงตำแหน่งประธานาธิบดีประชาธิปไตยไม่มีสิทธิ์ปรากฏตัวในการโหวตประธานาธิบดีสหรัฐฯ ข้อมูลที่ผิดเหล่านี้แพร่กระจายอย่างกว้างขวางและส่งผลกระทบต่อผู้ใช้หลายล้านคนใน X และแพลตฟอร์มอื่น ๆ ก่อนที่จะได้รับการแก้ไข

AI Chatbot Grok ของ X ได้รับการวิพากษ์วิจารณ์ว่ามีการเผยแพร่ข้อมูลการเลือกตั้งที่ผิดซึ่งอาจส่งผลกระทบต่อผลการเลือกตั้ง

เหตุการณ์ Grok อีกครั้งเตือนเราว่าในขณะที่เทคโนโลยีปัญญาประดิษฐ์กำลังพัฒนาอย่างรวดเร็วมีความจำเป็นที่จะต้องเสริมสร้างการกำกับดูแลและการตรวจสอบโมเดล AI เพื่อหลีกเลี่ยงการใช้การเผยแพร่ข้อมูลเท็จและสร้างความมั่นใจในความปลอดภัยของข้อมูลและความมั่นคงทางสังคม ในอนาคตวิธีการควบคุมความเสี่ยงของแบบจำลองภาษาขนาดใหญ่อย่างมีประสิทธิภาพจะเป็นประเด็นสำคัญที่ต้องแก้ไขในด้านปัญญาประดิษฐ์