Downcodes小編帶你了解Meta研究人員的最新突破!他們利用Transformer模型攻克了動力系統領域長期未解的難題——尋找全局李雅普諾夫函數。這項研究不僅展示了大型語言模型在複雜數學推理中的強大能力,更重要的是,它提出了一種創新的「逆向生成」方法,有效解決了訓練資料不足的難題,為AI在科學發現中的應用開闢了新的道路。該研究成果已發表在arXiv上,並提供了論文地址。

大型語言模型在許多任務中表現出色,但其推理能力一直備受爭議。 Meta 的研究人員近日發表論文,展示了他們如何利用Transformer 模型解決數學領域一個長期存在的難題:發現動力系統的全局李雅普諾夫函數。

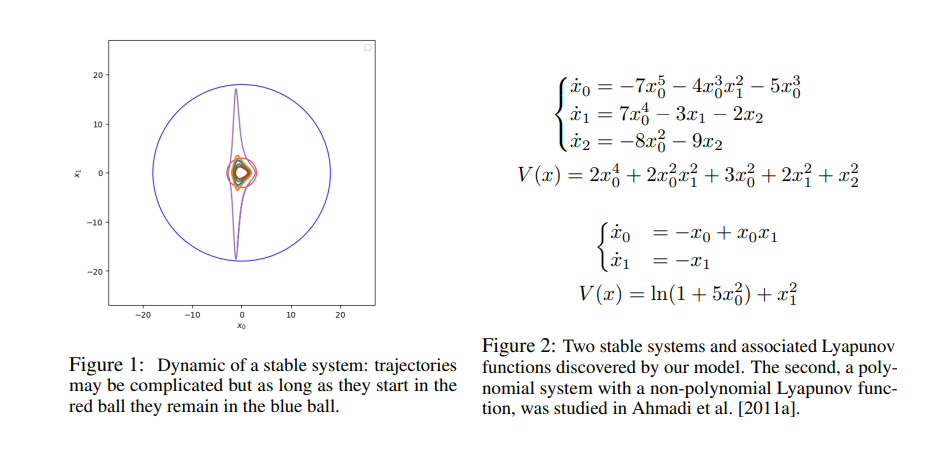

李雅普諾夫函數可以判斷一個動力系統是否穩定,例如,它可以用來預測三體問題的長期穩定性,也就是三個天體在引力作用下的長期運動軌跡。然而,目前還沒有找到通用的方法來推導出李雅普諾夫函數,只有少數系統已知其對應的函數。

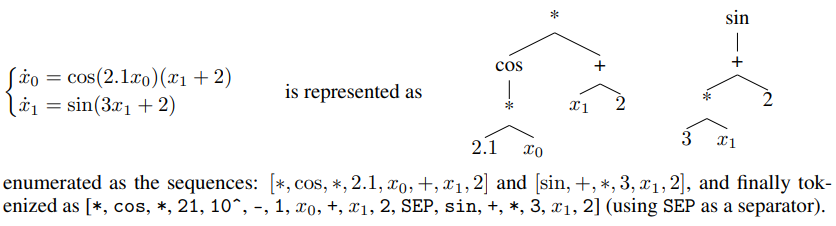

為了解決這個問題,Meta 的研究人員訓練了一個序列到序列的Transformer 模型,用於預測給定係統的李雅普諾夫函數。他們創新地使用「逆向生成」方法創建了大量的訓練資料集,其中包含穩定的動力系統及其對應的李雅普諾夫函數。

傳統的「正向生成」方法是從隨機產生的系統出發,嘗試計算其李雅普諾夫函數,這種方法效率低下,且只能處理特定類型的簡單系統。而「逆向生成」方法則是先隨機產生李雅普諾夫函數,然後建構與其對應的穩定係統,從而繞過了計算李雅普諾夫函數的難題,並能產生更多樣化的訓練資料。

研究人員發現,在「逆向生成」資料集上訓練的Transformer 模型在測試集上達到了接近完美的準確率(99%),並且在分佈外測試集上也表現出色(73%)。更令人驚訝的是,透過在訓練集中添加少量(300個)「正向生成」的簡單範例,模型的準確率可以進一步提高到84%,這表明即使是少量的已知解決方案也能顯著提升模型的泛化能力。

為了測試模型發現新李雅普諾夫函數的能力,研究人員產生了數萬個隨機系統,並使用模型進行預測。結果表明,該模型在多項式系統上找到李雅普諾夫函數的成功率是現有最先進方法的十倍,並且還能發現非多項式系統的李雅普諾夫函數,而目前還沒有任何演算法可以做到這一點。

研究人員還將模型與人類數學家進行了比較,他們邀請了25名數學碩士研究生進行了一項測試,結果顯示模型的準確率遠高於人類。

這項研究表明,Transformer 模型可以被訓練用於解決複雜的數學推理問題,並且「逆向生成」方法可以有效地創建訓練資料集,從而突破傳統方法的局限性。未來,研究人員計劃將該方法應用於其他數學難題,並探索AI 在科學發現中的更多可能性。

論文網址:https://arxiv.org/pdf/2410.08304

總而言之,Meta這項研究為AI解決複雜科學問題提供了新的想法和方法,也預示著AI在科學研究領域將發揮越來越重要的作用。 Downcodes小編將持續關注AI領域最新進展,為讀者帶來更多精彩報導!