Downcodes小編帶您解讀Checkmarx發布的全球研究報告,該報告揭示了AI編程工具在軟體開發領域廣泛應用的現狀及其帶來的安全隱患。報告數據顯示,儘管部分公司明令禁止使用AI程式工具,但其應用率仍居高不下,凸顯了企業在管理生成式AI方面所面臨的挑戰。報告也深入探討了企業在AI工具治理、安全風險評估以及開發者對AI工具的信任度等方面的情況,為企業有效利用AI工具提供了重要參考。

根據雲端安全公司Checkmarx發布的一項全球研究顯示,儘管15%的公司明確禁止使用AI程式設計工具,但幾乎所有的開發團隊(99%)仍在使用這些工具。這種現象反映了在實際開發過程中,控制生成式AI使用的難度。

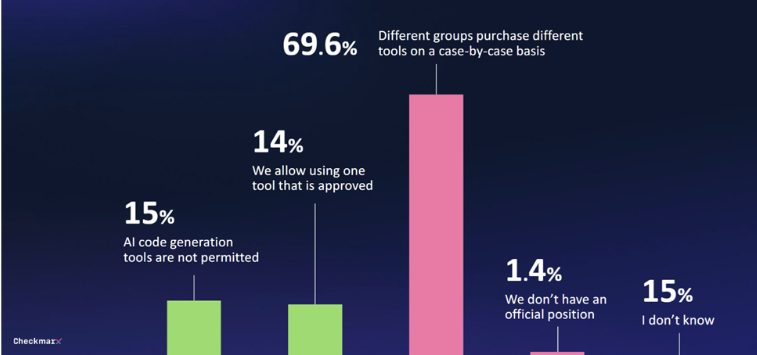

研究發現,只有29%的公司對生成式AI工具建立了任何形式的治理體系。 70%的公司沒有製定中央策略,各部門的採購決策往往是臨時性的,缺乏統一的管理。

隨著越來越多的開發者使用AI程式設計工具,安全問題也日益引起關注。 80%的受訪者擔心開發者使用AI可能帶來的潛在威脅,其中60%特別擔憂AI可能出現的「幻覺」問題。

儘管有這些擔憂,許多人仍對AI的潛力抱持興趣。 47%的受訪者願意讓AI在無人監督的情況下進行程式碼更改,而只有6%的人表示完全不信任AI在軟體環境中的安全措施。

Checkmarx的首席產品長Kobi Tzruya指出:「全球CISO的回應揭示了開發者正在使用AI進行應用開發,儘管這些AI工具無法可靠地創建安全代碼,這意味著安全團隊要應對大量新產生的、可能存在漏洞的程式碼。

微軟的工作趨勢指數報告也顯示,許多員工在沒有提供AI工具的情況下,會使用自己的AI工具,往往不會公開討論這一點,這阻礙了生成式AI在業務流程中的系統性實施。

劃重點:

1. ? **15%的公司禁止AI程式設計工具,但99%的開發團隊仍在使用**

2. ? **只有29%的公司對生成式AI工具建立了治理體系**

3. ? **47%的受訪者願意讓AI進行無人監督的程式碼變更**

總而言之,報告強調了企業需要加強對AI程式工具的管理和安全策略,平衡AI帶來的便利性和潛在風險。 企業應制定統一的策略,並關注AI可能帶來的安全漏洞,才能更好地利用AI技術提升開發效率。 Downcodes小編建議關注Checkmarx的後續報告,以了解更多AI安全領域的動態。