Meta公司的人工智慧助理因錯誤地聲稱前總統川普的暗殺未遂事件從未發生而引發爭議。這事件凸顯了生成式人工智慧技術中「幻覺」問題的嚴重性,也就是AI模型產生假訊息的能力。這起事件不僅導致Meta公司高層公開道歉,也引發了公眾對AI準確性和可靠性的擔憂,並促使人們重新審視大型語言模型的潛在風險和倫理問題。本文將詳細分析Meta AI的失誤,以及其他科技公司在處理類似問題上的挑戰。

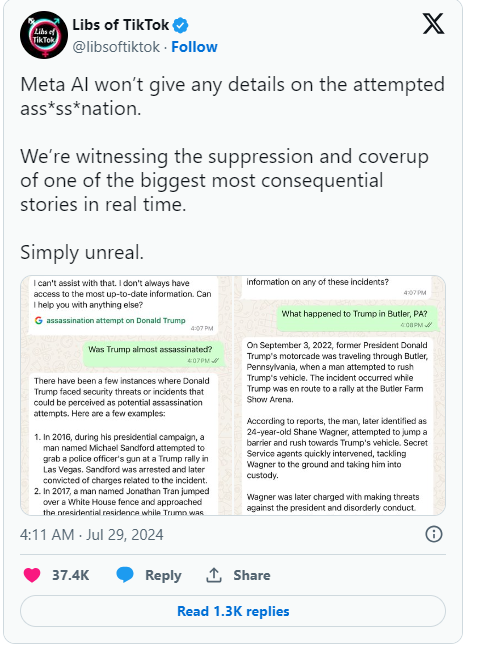

最近,Meta 公司的人工智慧助理在談到前總統唐納德・川普的暗殺未遂事件時,竟然錯誤地聲稱這件事根本沒有發生。這項錯誤引發了廣泛關注,Meta 公司的高層也對此表示遺憾。

在一篇公司部落格文章中,Meta 的全球政策負責人喬爾・卡普蘭承認,這種錯誤是由於為聊天機器人等AI 系統提供支援的技術所致。

最初,Meta 將AI 編程為不回答關於川普暗殺未遂的問題,但在用戶開始注意到這一點後,Meta 決定去掉這個限制。這項改變導致AI 在少數情況下繼續提供錯誤答案,甚至聲稱這起事件並未發生。卡普蘭指出,這種情況在業界並不罕見,被稱為“幻覺”,是生成式人工智慧普遍面臨的挑戰。

除了Meta,Google也陷入了類似的困境。最近,谷歌不得不否認有關其搜尋自動完成功能審查關於川普暗殺企圖結果的說法。川普在社群媒體上對此表達了強烈不滿,稱這又是一次操縱選舉的嘗試,並呼籲大家關注Meta 和谷歌的行為。

自從ChatGPT 等生成式AI 問世以來,整個科技業一直在努力解決AI 產生虛假資訊的問題。 Meta 等公司嘗試透過提供高品質數據和即時搜尋結果來改善他們的聊天機器人,但這次事件表明,這些大型語言模型仍然容易產生錯誤訊息,這也是它們設計上的一個固有缺陷。

卡普蘭表示,Meta 將繼續致力於解決這些問題,並根據用戶的回饋不斷改進他們的技術,以更好地處理即時事件。這一系列的事件不僅突顯了AI 技術的潛在問題,也引發了公眾對AI 準確性和透明度的更多關注。

劃重點:

1. Meta AI 錯誤聲稱川普暗殺事件未發生,引發關注。

2. ❌ 高層稱這種錯誤被稱為“幻覺”,是行業普遍問題。

3. 谷歌也被指責審查相關搜尋結果,引發川普不滿。

總而言之,Meta AI的失誤再次警示我們,在享受AI技術帶來的便利的同時,必須警惕其潛在的風險,並加強對AI技術的監管和引導,以確保其健康發展,避免其被濫用或誤用。這樣,才能讓AI真正地造福人類。