Adobe,身為創意軟體領域的巨頭,其服務條款的更新引發了巨大爭議。這項更新允許Adobe存取用戶作品,用於改進其AI模型Firefly,此舉被廣泛批評為“霸王條款”,侵犯了用戶的版權和隱私。本文將深入分析Adobe服務條款更新引發的爭議,探討背後的原因,以及科技公司與使用者之間日益緊張的關係。

Adobe,一個在創意產業中享有盛譽的名字,因其版權保護的立場而被譽為「版權衛士」。但最近,這家公司卻因為一項悄悄更新的服務條款而陷入了輿論的漩渦。

今年2月,Adobe 悄無聲息地更新了其產品服務條款,新增了一條令人矚目的內容:用戶必須同意Adobe 可以透過自動和手動的方式存取他們的作品,包括那些受到保密協議保護的內容。 Adobe 將使用這些作品來透過機器學習等技術來改善其服務和軟體。如果使用者不同意這些新條款,他們將無法使用Adobe 的軟體。

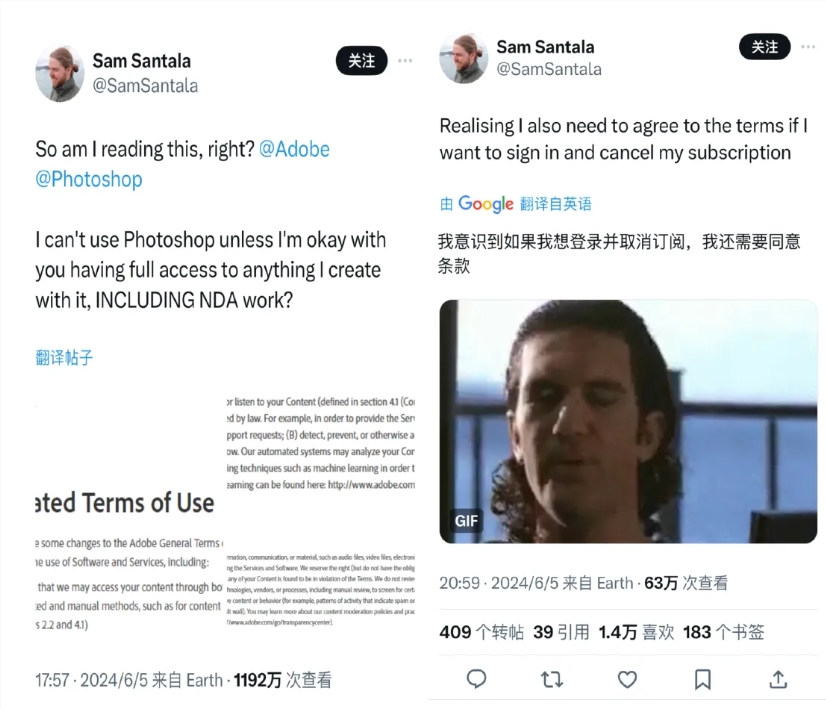

這項改變最近被曝光,激起了創意人士、數位藝術家和設計師等Adobe 的核心用戶的強烈抵制。他們認為這是一種強制授權,實質上是一種“霸王條款”,其真實目的是為了訓練Adobe 的生成式AI 模型“Firefly”。一位名叫Sam Santala 的部落客在推特上質疑這項條款,其推文的瀏覽量已經達到了千萬個等級。

許多用戶表達了他們的擔憂,他們擔心自己的隱私和版權,因此選擇停止使用Adobe 的產品。同時,Meta 公司也採取了類似的措施,更新了其隱私權政策,允許使用使用者在Meta 產品和服務上共享的資訊來訓練AI。如果用戶不同意新的隱私權政策,他們應該考慮停止使用Facebook 和Instagram 等社群媒體產品。

隨著AI 技術的快速發展,科技公司與使用者之間關於資料隱私、內容所有權和控制權的鬥爭變得越來越激烈。 Adobe 聲稱其Firefly 模型的訓練資料來自Adobe 影像庫中的數億張影像、一些公開授權的影像以及版權保護已過期的公開影像。然而,其他AI 影像產生工具,如Stability AI 的Stable Diffusion、OpenAI 的Dall-E2和Midjourney,都曾因版權問題而備受爭議。

Adobe 試圖在這一領域中採取差異化的市場定位,成為AI 軍備競賽中的“白衣騎士”,強調其模型訓練數據的合法性,並承諾對使用Adobe Firefly 生成的圖片引發的版權糾紛支付索賠。但這項策略並沒有平息所有用戶的擔憂。一些用戶,如資深設計師阿傑,戲稱自己是“Adobe 正版受害者”,認為Adobe 利用其龐大的創意生態系統來訓練AI,雖然是一個聰明的商業策略,但對用戶來說,平台與創作者之間的利益分配和使用者知情權是缺失的。

此外,海外也屢屢曝出與Adobe 相關的版權糾紛,讓用戶對Adobe 是否真的尊重創作者版權產生了疑問。例如,藝術家Brian Kesinger 發現,在未經他同意的情況下,Adobe 圖像庫中出現了打著他名義販賣的與其作品風格相似的AI 生成圖像。攝影師安塞爾亞當斯的遺產管理方也公開指控Adobe,稱其涉嫌出售已故攝影師作品的生成式人工智慧仿製品。

在輿論壓力下,Adobe 於6月19日修訂了服務條款,明確表示不會使用用戶儲存在本地或雲端的內容來訓練AI 模型。但這項澄清並未完全平息創作者的擔憂。一些海外AI 圈知名部落客指出,Adobe 的修訂版服務條款仍允許使用用戶私有雲資料訓練非生成式AI 工具的機器學習模式。儘管用戶可以選擇退出“內容分析”,但複雜的取消操作常常讓不少用戶望而卻步。

不同國家和地區對使用者資料保護的法規存在差異,這也影響了社群媒體平台在製定使用者服務條款時的策略。例如,在一般資料保護規範(GDPR)的框架下,英國和歐盟的用戶享有“反對權”,他們可以明確選擇不將其個人資料用於訓練Meta 公司的人工智慧模型。然而,美國用戶未獲得同等的知情權,根據Meta 現有的資料共享政策,美國用戶在Meta 旗下社群媒體產品上發布的內容,可能在未經明確同意的情況下已經被用於訓練AI。

數據被喻為AI 時代的“新石油”,但資源的“開採”目前仍有不少灰色地帶。一些科技公司在獲取用戶資料方面採取了模糊的做法,這引發了用戶個人資訊權利的雙重困境:數位版權歸屬和資料隱私問題,嚴重損害用戶對平台的信任。

目前,平台在確保生成式AI 不侵犯創作者權益方面尚存在較大不足,也缺乏足夠監管。一些開發者和創作者已經採取行動,推出了一系列「反AI」工具,從作品保護工具Glaze 到AI 數據投毒工具Nightshade,再到反AI 社群Cara 走紅,面對科技公司未經用戶/創作者同意便抓取相關資料訓練AI 模型,人們的怒火已經愈演愈烈。

在AI 技術快速發展的今天,如何平衡科技創新與使用者隱私安全,保障創作者權益,仍待產業進一步發展和法律監管措施持續改善。同時,使用者也需要更加警惕,了解自己的資料權利,並在必要時採取行動保護自己的創作和隱私。

Adobe事件只是AI時代數據權衡問題的冰山一角,未來,如何在技術進步和用戶權益之間找到平衡點,將成為擺在所有科技公司和監管機構面前的重要課題。只有加強監管,明確數據使用規則,才能建構一個更健康、永續發展的AI生態環境。