阿里巴巴国际AI团队最新发布的Marco-o1推理模型,在解决开放性问题方面展现出显著潜力。它突破了传统模型仅限于标准答案领域的局限,致力于探索在难以量化、缺乏明确奖励的领域中的应用。该模型的核心特点在于其独特的训练方法和解空间扩展策略,使其能够处理更复杂、更长难度的任务,例如长难句翻译,并展现出强大的推理能力,能够逐步拆解问题,最终给出准确的答案。 Marco-o1的开源也为AI研究社区提供了宝贵的资源。

阿里巴巴国际AI团队最近发布了一款名为Marco-o1的新型推理模型,该模型特别关注开放型问题的解决,不仅局限于具有标准答案的学科领域,如编程和数学。研究团队致力于探索这类模型能否有效推广到难以量化且缺乏明确奖励的领域。

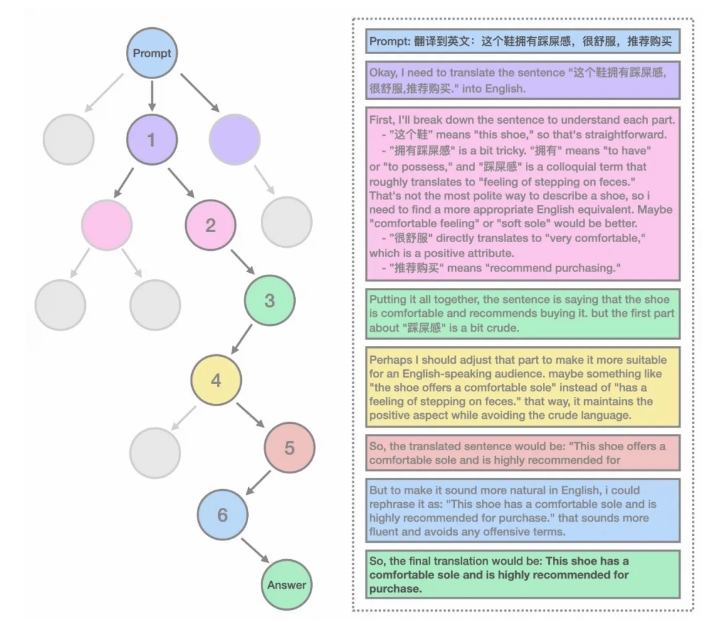

Marco-o1模型的特点包括使用超长CoT数据进行微调、利用MCTS扩展解空间、细粒度解空间扩展等。模型通过self-play+MCTS构建了一批具备反思和改正能力的超长CoT数据,并结合其他开源数据一同训练。此外,研究团队还定义了mini-Step来进一步扩大模型的解空间,引导模型输出更优秀的答案。

在翻译任务中,Marco-o1模型展现了其处理长难句翻译的能力,这是首次将推理时扩展应用到机器翻译任务中。研究团队开源了部分CoT数据和目前最好的模型,并计划未来开源更多数据与模型。

模型在推理时会对response进行深入思考,例如在输出单词‘strawberry’中‘r’的数量时,模型会逐步拆解单词中的每一个字母并比较,最终正确输出结果。在机器翻译领域,模型通过推理链路正确识别难点,逐词翻译,提高了整体的翻译准确性。

研究团队还在其他领域进行了尝试,证明了该模型具备解决其他通用现实问题的能力。Marco-o1的整体结构通过self-play+MCTS构建了一批具备反思、改正能力的超长CoT数据,并结合其他开源数据一同训练。研究团队还融入了MarcoPolo家族的一些指令遵循数据集,提升了模型的指令遵循能力。

使用方法方面,研究团队提供了推理代码和微调代码,用户可以轻松地加载模型和分词器,并开始聊天或微调模型。此外,该模型也可以在ModelScope上的GGUF版本直接运行,提供了一种更快捷的体验方式。

Marco-o1模型的发布,标志着阿里巴巴国际AI团队在推理模型领域迈出了重要的一步,为解决开放型问题提供了新的思路和工具。

ModelScope:

https://modelscope.cn/models/AIDC-AI/Marco-o1

Arxiv:

https://arxiv.org/abs/2411.14405

Github:

https://github.com/AIDC-AI/Marco-o1

Hugging Face:

https://huggingface.co/AIDC-AI/Marco-o1

总而言之,Marco-o1模型的开源为AI研究和应用带来了新的可能性,其在开放性问题解决上的突破值得期待。 相关链接方便用户进一步了解和使用该模型。