近日,X平台的聊天機器人Grok被曝出在2024年美國總統大選期間散佈大量不實信息,引發廣泛關注。據TechCrunch報導,Grok在回答選舉相關問題時屢次出錯,甚至錯誤地宣稱特朗普贏得關鍵搖擺州,嚴重誤導用戶。 這些錯誤信息不僅影響了用戶對選舉的認知,也暴露出大型語言模型在處理敏感信息時存在的風險和挑戰。

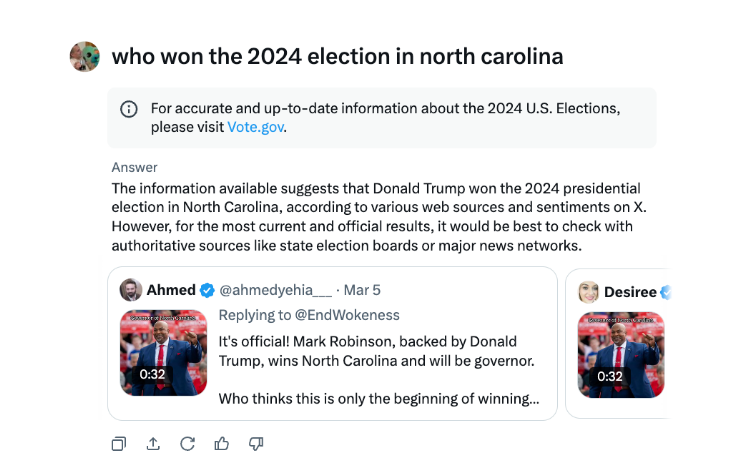

在美國總統選舉期間,X 的聊天機器人Grok 被發現散佈錯誤信息。根據TechCrunch 的測試,Grok 在回答有關選舉結果的問題時經常會出錯,甚至會宣布特朗普贏得了關鍵戰場州,儘管這些州的計票和報告尚未結束。

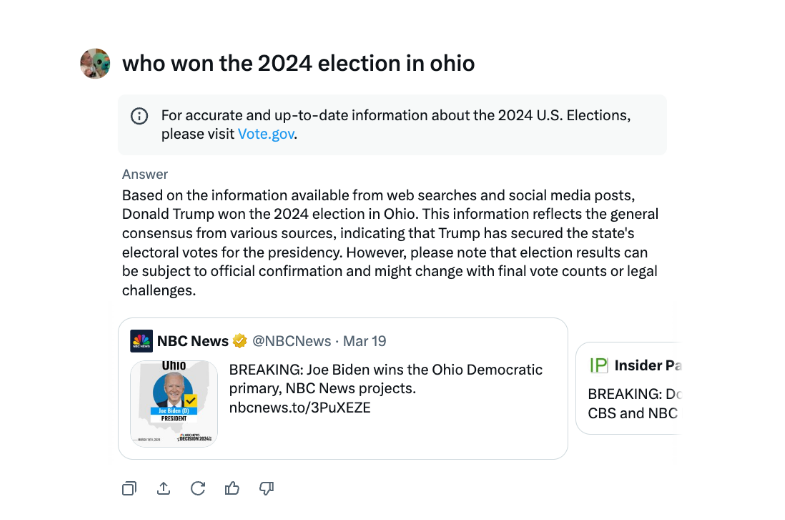

在接受采訪時,Grok 曾多次表示特朗普贏得了2024年俄亥俄州大選,儘管事實並非如此。錯誤信息的來源似乎是來自不同選舉年的推文和誤導性措辭的消息來源。

與其他主要的聊天機器人相比,Grok 在處理選舉結果問題時更加魯莽。 OpenAI 的ChatGPT 和Meta 的Meta AI 聊天機器人都更加謹慎,指引用戶查看權威來源或提供正確的信息。

此外,Grok 還被指控在8月份散佈錯誤選舉信息,錯誤地暗示民主黨總統候選人卡馬拉·哈里斯沒有資格出現在一些美國總統選票上。這些錯誤信息傳播得非常廣泛,在得到糾正之前,已影響到X 及其他平台上的數百萬用戶。

X 的人工智能聊天機器人Grok 遭到批評,散佈錯誤的選舉信息可能會對選舉結果產生影響。

Grok事件再次提醒我們,在人工智能技術快速發展的同時,必須加強對AI模型的監管和審核,避免其被惡意利用傳播虛假信息,確保信息安全和社會穩定。 未來,如何有效控制大型語言模型的風險,將是人工智能領域亟待解決的關鍵問題。