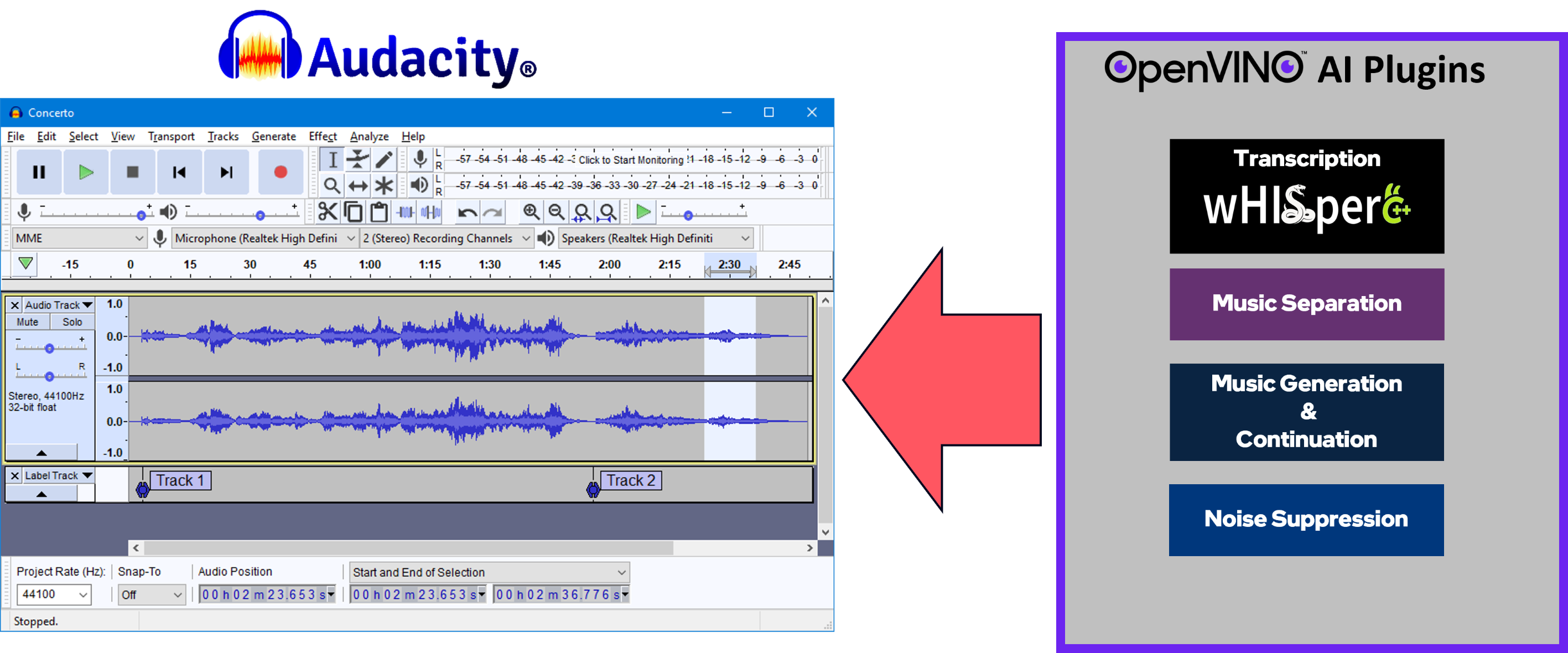

適用於 Audacity® 的一組支援 AI 的效果器、生成器和分析器。這些 AI 功能 100% 在您的 PC 上本地運行? -- 無需網路連線! OpenVINO™ 用於在使用者係統上支援的加速器(例如 CPU、GPU 和 NPU)上運行 AI 模型。

音樂分離——將單聲道或立體聲軌道分離為單獨的音軌——鼓、貝斯、人聲和其他樂器。

雜訊抑制-消除音訊取樣中的背景雜訊。

音樂生成與延續-使用 MusicGen LLM 產生音樂片段,或產生現有音樂片段的延續。

Whisper Transcription-使用 Whisper.cpp 產生一個標籤軌道,其中包含給定的口語音訊或人聲選擇的轉錄或翻譯。

請到此處尋找最新 Windows 版本的安裝套件和說明。

Windows 建置說明

Linux 建置說明

我們歡迎您在這裡提交問題

問題

錯誤報告

功能請求

任何類型的回饋-我們如何改進這個專案?

我們歡迎並重視您的貢獻,無論大小。請隨時提交拉取請求!

Audacity®開發團隊&Muse Group-感謝您的支持!

Audacity® GitHub -- https://github.com/audacity/audacity

Whisper 轉錄和翻譯分析儀使用 Whisper.cpp(附 OpenVINO™ 後端):https://github.com/ggerganov/whisper.cpp

音樂生成和延續使用來自 Meta 的 MusicGen 模型。

我們目前支援 MusicGen-Small 和 MusicGen-Small-Stereo

txt 到音樂的管道已從 python 移植到 C++,引用了 Hugging Face 轉換器專案的邏輯:https://github.com/huggingface/transformers

音樂分離效果使用 Meta 的 Demucs v4 模型 (https://github.com/facebookresearch/demucs),該模型已被移植以與 OpenVINO™ 配合使用

噪音抑制:

從這裡移植模型和管道:https://github.com/Rikorose/DeepFilterNet

我們也利用@grazder 的 fork/branch (https://github.com/grazder/DeepFilterNet/tree/torchDF-changes) 來更好地理解 Rust 實現,因此我們的一些 C++ 實作也基於torch_df_offline.py在這裡找到的。

引用:

@inproceedings{schroeter2022deepfilternet2,title = {{DeepFilterNet2}:在嵌入式設備上實現全頻帶音頻實時語音增強},作者 = {Schröter、Hendrik 和 Escalante-B.、Alberto N. 和 Rosenkranz、Tobias 和 Maier,安德烈亞斯},書名={第十七屆聲學訊號增強國際研討會(IWAENC 2022)},年= {2022},

} @inproceedings{schroeter2023deepfilternet3,title = {{DeepFilterNet}:感知動機即時語音增強},作者 = {Schröter、Hendrik 和 Rosenkranz、Tobias 和 Escalante-B.、Alberto N. 和 Maier、Andreas},booktitle={ INTERSPEECH} ,年份= {2023},

}噪音抑制-denseunet-ll:來自 OpenVINO™ 的開放模型動物園:https://github.com/openvinotoolkit/open_model_zoo

DeepFilterNet2 和 DeepFilterNet3:

OpenVINO™ 筆記本——我們從這套很棒的 Python 筆記本中學到了很多東西,並且仍在使用它來學習使用 OpenVINO™ 實施 AI 管道的最新/最佳實踐!